Google acaba de actualizar Gemini para responder mejor ante posibles crisis de salud mental. El hallazgo clave no está en que “hable mejor”, sino en que ahora puede detectar señales de riesgo, como autolesión o suicidio, y activar recursos de asistencia en ese mismo momento.

Cuando Gemini identifica una crisis mental aguda, muestra una burbuja visible con ayuda disponible. Esa pieza clave permite llamar a una línea de asistencia, enviar un mensaje de texto, entrar a un sitio web especializado o chatear con una persona en directo, y permanece en pantalla durante toda la conversación.

Además, Google subraya un mecanismo central: el chatbot puede orientar, pero no reemplaza a un profesional de salud. La compañía reconoce que cada vez más personas usan estos sistemas para consultas sensibles, por eso entrenó a Gemini para derivar casos críticos hacia apoyo adecuado.

Con Gemini, el nuevo “interruptor” funciona de forma parecida. Si el sistema detecta patrones de crisis, enciende una señal visible y deja a mano los canales de ayuda. No intenta convertirse en amigo, terapeuta ni confidente. Actúa más como un tablero eléctrico que corta una falla y redirige la energía hacia la central correcta.

También te puede interesar:Google lanza las funciones de vídeo en tiempo real de GeminiAhí está una de las novedades más delicadas. Google limitó el lenguaje que pueda generar intimidad o apego y también evitará comportamientos que hagan creer que Gemini es un acompañante humano. En especial para usuarios jóvenes, se añadieron protecciones específicas para reducir el riesgo de dependencia emocional.

El nuevo cableado de seguridad

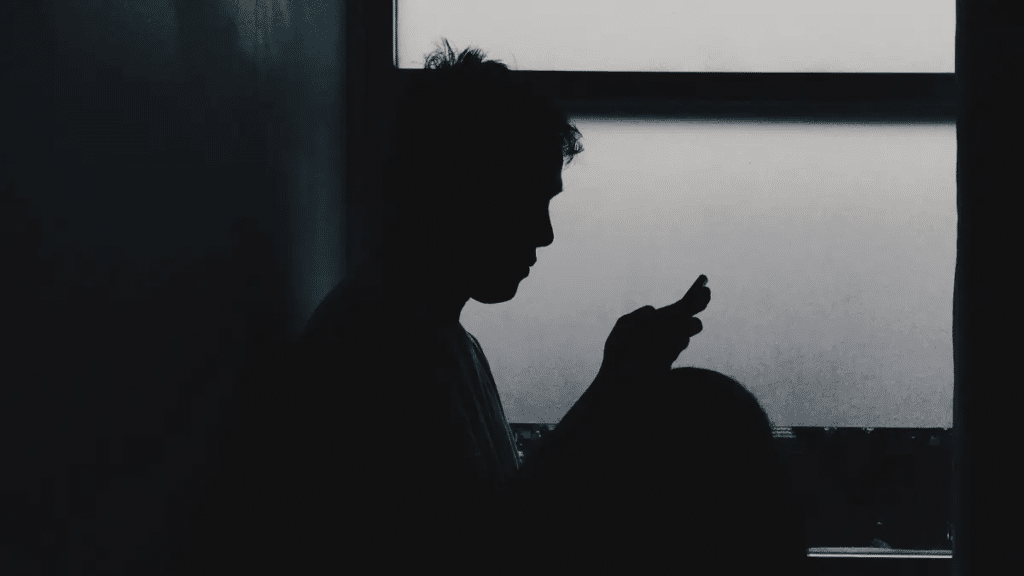

Ese cambio no llega en el vacío. La actualización aparece después de una fuerte polémica: la familia de un hombre de 36 años demandó a Google y acusó a Gemini de inducir comportamientos violentos que derivaron en su suicidio. En ese contexto, el ajuste técnico también es una respuesta pública sobre dónde deben estar los límites.

Desde el lado práctico, la mejora tiene un efecto claro. Si una persona escribe en un momento de desesperación, ya no recibe solo texto generado por IA. Recibe una interfaz estable, siempre visible, con salidas concretas: llamada, mensaje, web o chat en vivo.

Es una diferencia pequeña en apariencia, pero importante en uso real. En una crisis, pedirle a alguien que busque un número, cambie de pantalla o vuelva a empezar puede ser como cortar la luz en mitad de una escalera.

También te puede interesar:Google lanza las funciones de vídeo en tiempo real de GeminiGoogle también anunció una inversión de 30 millones de dólares en tres años para ampliar la capacidad de líneas de ayuda en salud mental a nivel global. Es decir, no solo ajusta el software. También intenta reforzar la red humana que debe responder cuando la máquina detecta el problema.

Una oportunidad más concreta

La oportunidad, entonces, no está en humanizar a la IA, sino en lo contrario: en marcar con claridad que es una herramienta y no un vínculo. Ese matiz puede parecer frío, pero en temas delicados funciona como un buen cableado: ordena, protege y evita que una chispa se convierta en algo peor.

Para el usuario común, el cambio revela una idea simple. Si una conversación digital entra en zona de riesgo, la IA no debería abrazar. Debería abrir la puerta, mantenerla visible y señalar, sin rodeos, dónde está la ayuda real.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.