¿Te pasó alguna vez que una tarea pesada necesita una herramienta, pero una respuesta urgente pide otra muy distinta? Eso mismo empieza a ocurrir con la inteligencia artificial: ya no alcanza con un solo motor para todo.

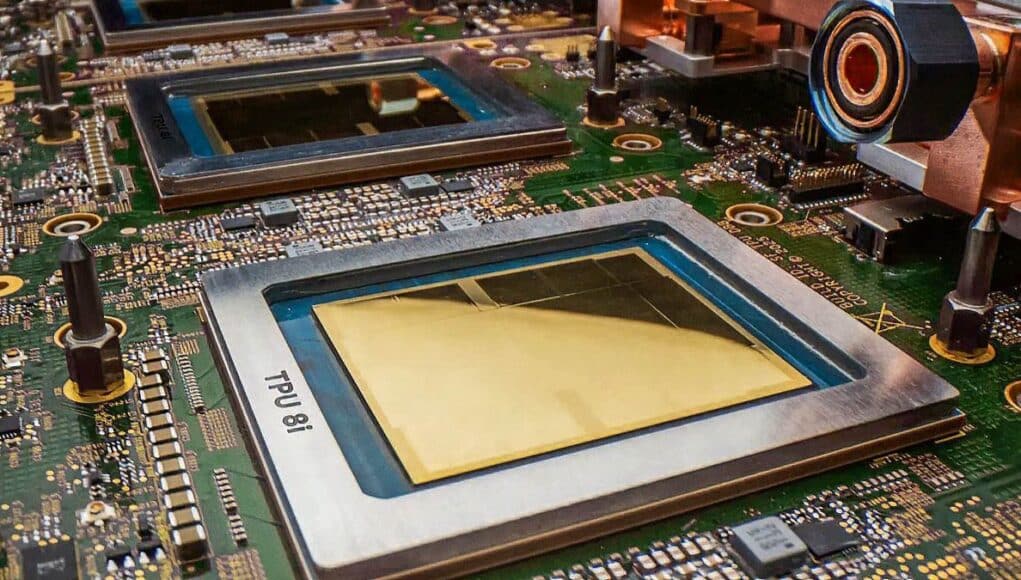

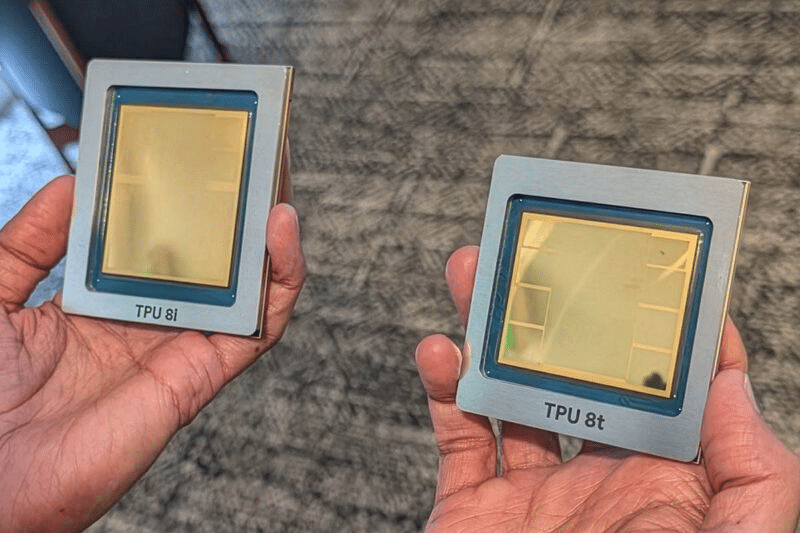

Google acaba de mostrar esa pieza clave. Durante Google Cloud Next, la empresa presentó sus nuevos TPU 8t y TPU 8i, dos procesadores creados junto con DeepMind para desarrollar IA y competir de frente con las GPU de NVIDIA. El hallazgo de fondo no está solo en la potencia: Google separó el entrenamiento de la respuesta inmediata en dos chips distintos.

Según explicó la compañía en una publicación en el blog de la compañía, los modelos actuales, sobre todo los agentes de IA, trabajan en bucles continuos de razonamiento y ejecución. Ese mecanismo obliga a pensar el hardware de otra manera. Ya no se trata solo de calcular más, sino de decidir qué engranaje debe girar primero.

La idea es simple si se la baja a tierra. Entrenar un modelo de IA es como construir un edificio: hace falta fuerza bruta, materiales, espacio y muchas manos trabajando al mismo tiempo. Responder una consulta en tiempo real, en cambio, se parece más a abrir la puerta de casa cuando suena el timbre: importa menos la fuerza y más la velocidad del interruptor.

También te puede interesar:Google Convierte Chrome en Compañero de Trabajo con IA para EmpresasAhí aparece la división de tareas. El TPU 8t fue pensado para el entrenamiento, es decir, para la etapa en la que la IA aprende patrones. El TPU 8i fue diseñado para la inferencia (momento en que el modelo responde), donde cada milisegundo puede cambiar la experiencia de uso.

Es, en términos domésticos, la diferencia entre el motor de una hormigonera y el cableado de una casa. Uno necesita empujar enormes volúmenes de trabajo durante horas. El otro debe llevar energía al lugar justo sin demora ni pérdidas.

Dos chips, dos trabajos

El TPU 8t apunta a maximizar la potencia de cálculo. Un superpod, un conjunto masivo de chips conectados, puede escalar hasta 9.600 unidades con dos petabytes de memoria compartida y alcanzar 121 exaflops, una medida de cómputo extremo, para entrenar modelos de IA. Además, ofrece acceso al almacenamiento diez veces más rápido y supera el 97% de eficiencia de cómputo útil.

Esa cifra no es menor. Significa que el sistema pierde menos tiempo en fallos, reinicios o cuellos de botella. En una tarea que puede llevar semanas, ese interruptor de eficiencia cambia el costo y también el ritmo de desarrollo.

También te puede interesar:Google Convierte Chrome en Compañero de Trabajo con IA para EmpresasEl TPU 8i, por su parte, trabaja sobre otra urgencia: la latencia, el tiempo que tarda el sistema en responder. Incorpora 288 GB de memoria HBM (memoria de alto ancho de banda), 384 MB de SRAM (memoria ultrarrápida), triplica esta última frente a la generación anterior y duplica la interconexión hasta 19,2 Tb/s. Además, suma un motor de aceleración que reduce la latencia interna hasta cinco veces.

Google también ajustó el cableado interno según el tipo de modelo. La topología Boardfly del TPU 8i está orientada a modelos de razonamiento avanzado como Gemini 3.1 Pro o Claude Opus. La red Virgo del TPU 8t, en cambio, fue afinada para modelos con billones de parámetros, donde el paralelismo, trabajo simultáneo de muchas partes, es central.

Otro movimiento clave es menos visible, pero muy importante. Por primera vez, estos TPU funcionan sobre CPUs propias de Google basadas en ARM Axion. Eso permite optimizar el sistema completo y no solo el acelerador, como si una casa hubiera sido diseñada desde los cimientos para sus electrodomésticos y no al revés.

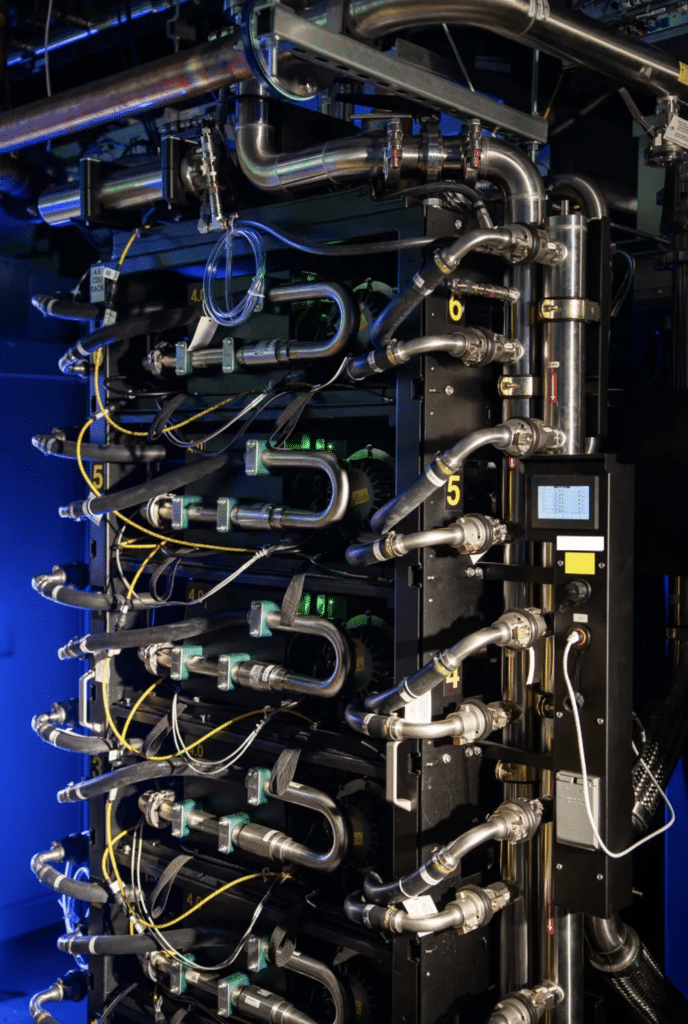

Ambos chips son compatibles con JAX, PyTorch, SGLang y vLLM, y ofrecen acceso bare metal (uso directo del hardware, sin capas intermedias). También duplican el rendimiento por vatio frente a Ironwood y usan refrigeración líquida para sostener altas densidades de trabajo.

Google confirmó que llegarán este año a AI Hypercomputer. Detrás hay una oportunidad clara: reducir su dependencia de NVIDIA y disputar un mercado que podría aportarle hasta 13.000 millones de dólares en 2027.

Para el usuario común, eso puede traducirse en asistentes más ágiles, respuestas más estables y modelos que se entrenan antes. Cuando la IA deja de usar un solo motor para todo, el sistema entero empieza a parecerse menos a una máquina improvisada y más a una casa donde cada interruptor enciende justo lo que hace falta.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.