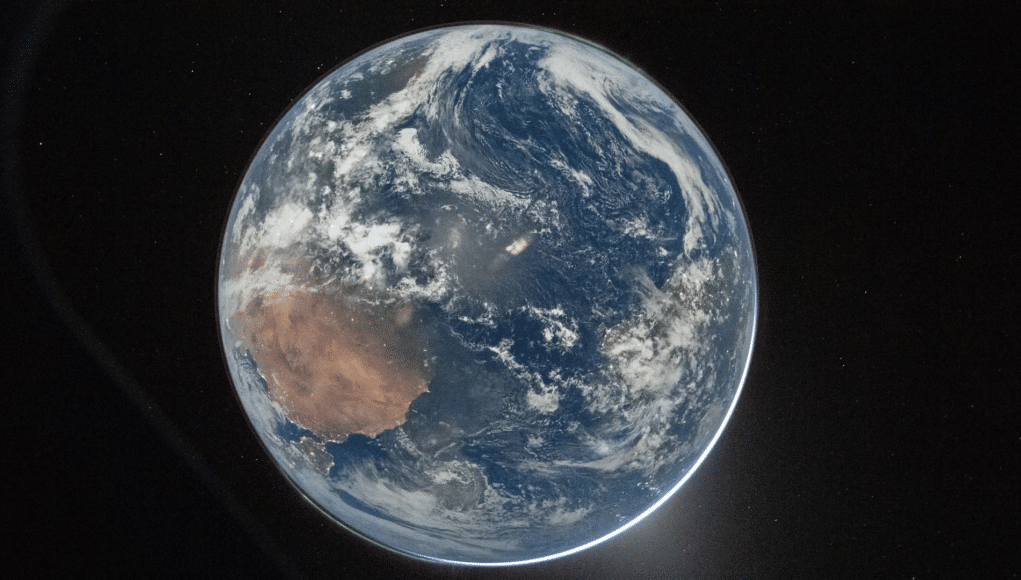

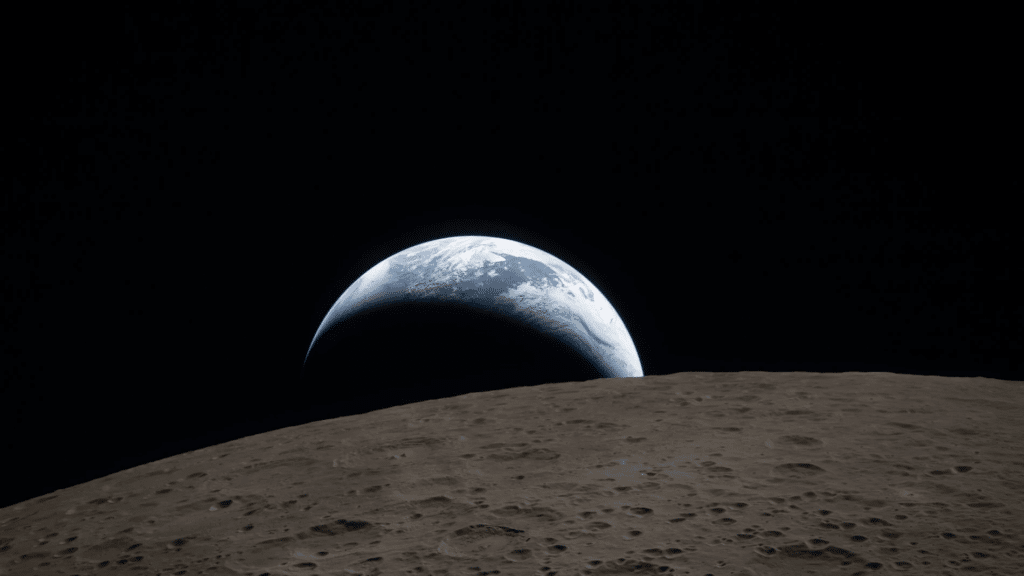

La NASA publicó varias imágenes oficiales de Artemis II, incluida una especialmente potente: la Tierra asomando en el horizonte lunar. Sin embargo, en los primeros minutos, sistemas como Grok y ChatGPT respondieron a algunos usuarios que esas fotos eran falsas.

El hallazgo no está en la imagen, sino en el mecanismo de respuesta. Según reconstruyó WIRED, esas respuestas iniciales fueron usadas por cuentas conspirativas para reforzar narrativas contra la NASA, apoyadas en la supuesta autoridad técnica de la IA. Horas después, los mismos chatbots cambiaron de postura y empezaron a reconocer las imágenes como auténticas.

Y ahí se encendió otro interruptor: para algunos usuarios, esa corrección no fue una rectificación, sino una prueba de “manipulación”.

La clave es entender qué hace realmente un chatbot. No funciona como un perito digital ni como un laboratorio forense. Funciona más bien como un contestador armado con palabras probables: toma patrones de lenguaje, contexto de la pregunta y datos que vio antes, y con ese cableado genera la respuesta más verosímil, no la más verdadera.

También te puede interesar:ChatGPT Presenta un Nuevo Plan Pro de 100 Dólares con Más Capacidad para CodexEn este caso, los modelos no consultaron telemetría (datos de posición y movimiento), ni analizaron iluminación, ni compararon metadatos, ni hicieron una revisión visual forense. Ese tipo de examen no forma parte de su mecanismo central cuando responden en una conversación común.

Un engranaje que cambia con el contexto

Además, estos sistemas dependen de lo que ya circula públicamente. Si una imagen nueva aparece antes de que existan suficientes referencias, noticias o explicaciones accesibles, el chatbot puede tratarla como una pieza sospechosa simplemente porque no encaja bien en su memoria estadística.

Después, cuando aparecen más artículos, posteos, desmentidas y confirmaciones oficiales, el sistema ajusta su salida. No porque haya “investigado” mejor, sino porque cambió el contexto disponible alrededor de esa consulta.

Eso explica por qué la NASA pudo haber publicado más de diez imágenes oficiales, con respaldo institucional e incluso difusión desde la Casa Blanca, y aun así los chatbots fallaron al comienzo. El problema no era la autenticidad de la foto. El problema era el interruptor equivocado al que muchos estaban confiando la verificación.

También te puede interesar:ChatGPT Presenta un Nuevo Plan Pro de 100 Dólares con Más Capacidad para CodexVarios estudios recientes, además, señalan otra pieza delicada: estos modelos pueden reforzar prejuicios del usuario. Si la pregunta ya viene cargada de sospecha, la respuesta puede acomodarse a ese sesgo. No siempre corrigen una creencia previa; a veces la lubrican.

Ya se documentaron casos de alucinaciones (errores inventados con apariencia sólida) y respuestas negacionistas antes de ser corregidas. Incluso autoridades sanitarias observaron un aumento de ingresos psiquiátricos vinculados al uso intensivo de chatbots, una señal de que no se trata solo de tecnología, sino también de salud pública y confianza.

La aplicación práctica para el lector

Por eso, si una imagen científica genera dudas, la ruta más segura sigue siendo otra: buscar la fuente original, revisar canales oficiales y contrastar con especialistas o medios que expliquen el contexto. Un chatbot puede servir como puerta de entrada. No como tribunal final.

En otras palabras, la IA puede ordenar el escritorio, pero todavía no debería custodiar la caja fuerte de los hechos. Y en temas sensibles, desde una foto lunar hasta una noticia sanitaria, esa diferencia ya no es un detalle técnico: es la central de la confianza digital.

Para seguir novedades de este tipo, muchos medios ya las distribuyen también en formatos directos, como este canal de WhatsApp. La oportunidad, hacia adelante, no es dejar de usar chatbots, sino aprender a no confundir una voz fluida con una prueba real.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.