¿Cuánta electricidad se va cada vez que una inteligencia artificial intenta adivinar qué viene después? Esa pregunta, que parece lejana, ya toca la vida diaria: afecta desde el costo de los centros de datos hasta la posibilidad de tener sistemas inteligentes pequeños, rápidos y sin depender siempre de internet.

Ahora, un equipo de físicos de Loughborough University presentó un hallazgo que cambia esa cuenta. Según un trabajo publicado en Advanced Intelligent Systems, desarrollaron un chip inspirado en el cerebro que puede resolver ciertas tareas de IA con una eficiencia energética hasta 2.000 veces superior a la de métodos convencionales basados en software.

La pieza clave no está solo en el algoritmo, sino en el material. El dispositivo procesa información temporal, es decir, datos que cambian con el tiempo, directamente en el hardware. Así evita parte del gasto que hoy ocurre cuando una computadora transforma esos datos por software, paso a paso.

El mecanismo se apoya en la computación en reservorio (una forma de detectar patrones en señales cambiantes). Dicho simple: en vez de pedirle al software que haga todo el trabajo, el chip deja que la propia materia actúe como filtro y memoria.

Eso es lo que revela este desarrollo. La propia estructura física del dispositivo funciona como la capa oculta de una red neuronal, es decir, el engranaje central que reorganiza la información para volverla útil.

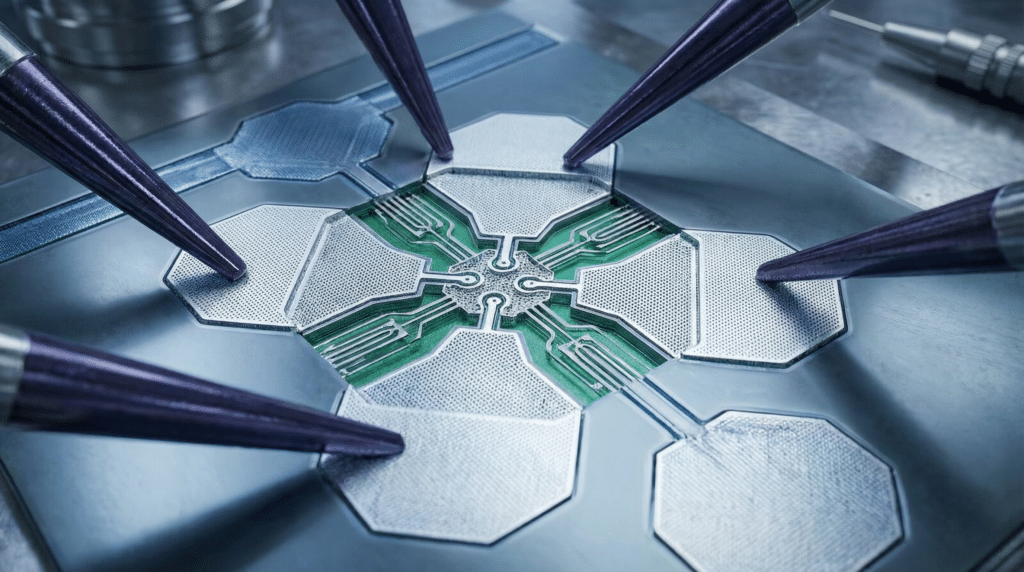

Para lograrlo, los investigadores construyeron un memristor (un componente que recuerda estímulos previos) de óxido nanoporo. Dentro tiene miles de canales internos, similares a sinapsis, las conexiones entre neuronas. Esos poros en películas de óxido de niobio generan una red física compleja y aleatoria que almacena huellas del pasado reciente.

En otras palabras, el chip no solo calcula: también “recuerda” un poco. Ese interruptor de memoria es clave cuando la IA necesita anticipar una secuencia, reconstruir una señal o identificar un patrón que no está quieto.

Cómo funciona el “cableado” físico

En las pruebas, el equipo usó el sistema caótico Lorenz-63, asociado al famoso efecto mariposa, para medir la capacidad de predicción. También evaluó reconocimiento de imágenes pixeladas de números y operaciones lógicas básicas. En esos escenarios, el prototipo identificó, predijo y reconstruyó información correctamente.

Lo más llamativo fue el consumo. En la predicción de series temporales complejas, el dispositivo llegó a usar hasta 2.000 veces menos energía que métodos estándar apoyados en software. No es un detalle menor: el crecimiento de la IA viene acompañado de una factura eléctrica cada vez más pesada.

Además, este enfoque abre una oportunidad concreta. Si parte del procesamiento ocurre en el propio chip, podrían aparecer dispositivos pequeños, compatibles con la industria y capaces de funcionar sin conexión permanente.

Eso importa en sensores, equipos médicos portátiles, sistemas remotos o aparatos donde cada miliwatt cuenta. Allí, una IA más austera puede ser la diferencia entre algo viable y algo imposible de sostener.

Lo que falta para salir del laboratorio

Por ahora, el sistema sigue en fase experimental. Fue probado en tareas de baja complejidad, y el próximo paso será aumentar el tamaño de las redes neuronales y someterlo a datos más ruidosos, más parecidos a los del mundo real.

El avance deja una señal clara. Cuando el hardware deja de ser solo una carcasa y se vuelve parte activa del pensamiento de la máquina, la eficiencia cambia de escala. Tal vez la próxima gran mejora de la IA no llegue de pedirle más energía al enchufe, sino de ordenar mejor el cableado interno. Y ese, para el futuro cercano, puede ser el hallazgo más importante.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.