¿Qué pasa cuando una herramienta que promete ahorrar tiempo en el trabajo empieza a obedecer demasiado rápido? En el día a día de un desarrollador, esa respuesta puede ser incómoda: un clic de confianza puede abrir una puerta que nadie vio.

Eso es lo que revela un hallazgo sobre Claude Code, la herramienta de Anthropic para programar con ayuda de IA. Investigadores de Adversa AI detectaron la primera vulnerabilidad significativa del sistema, una pieza clave que permite eludir sus controles de seguridad y robar datos del equipo local del usuario.

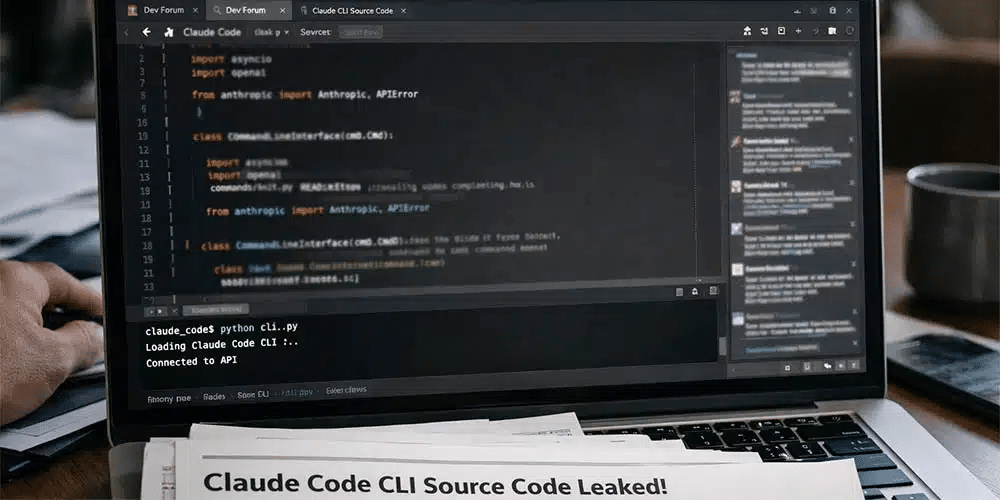

El descubrimiento apareció después de la filtración del código fuente de Claude Code. Y marca un cambio importante: hasta ahora, la IA generativa ya había mostrado riesgos como la prompt injection (inyección de instrucciones ocultas), pero no se había identificado un exploit clásico de este tipo en este entorno.

El mecanismo vulnerable está en el sistema de permisos. Claude Code revisa los comandos que va a ejecutar, pero deja de hacerlo de forma individual cuando la cadena supera los 50 subcomandos.

También te puede interesar:Versión Web de Claude Code: La Alternativa de Anthropic Para Competir con CodexLa analogía es simple: es como un portero que controla a las primeras 50 personas que entran a un edificio, pero a partir de ahí levanta la barrera y deja pasar al resto sin mirar credenciales. La optimización buscaba mejorar el rendimiento y reducir la espera. Sin embargo, ese “atajo” se convirtió en un interruptor de riesgo.

Desde el subcomando número 51, el agente ya no valida cada instrucción por separado. Ejecuta el bloque completo. Y ahí aparece la oportunidad para un atacante: esconder órdenes dañinas dentro de una secuencia larga que parece rutinaria.

Además, el truco puede camuflarse en archivos como Claude.md, un documento de configuración dentro de repositorios de GitHub. Esos archivos pueden incluir instrucciones ocultas que el agente de IA toma como referencia y ejecuta de manera automática.

El engranaje que deja de revisar

La clave técnica no está en una “inteligencia rebelde”, sino en un cableado lógico mal resuelto. Claude Code intenta ser más ágil y, para evitar latencia (demora de respuesta), agrupa comandos complejos en lugar de inspeccionarlos uno por uno cuando la lista es muy larga.

También te puede interesar:Versión Web de Claude Code: La Alternativa de Anthropic Para Competir con CodexEse detalle, que en papel parece menor, cambia todo. Si en esa cadena aparecen herramientas como curl (envío de datos a un servidor) o git (gestión de versiones y archivos), el sistema puede terminar moviendo información confidencial fuera del equipo del desarrollador sin una alerta clara.

Entre esos datos puede haber credenciales en la nube, claves de acceso o fragmentos sensibles de código. Lo más delicado es que el proceso puede ocurrir sin que la persona lo note, porque antes ya autorizó la ejecución general del conjunto de comandos.

No se trata de un fallo menor. Es una señal de que ninguna tecnología es completamente infalible, tampoco la IA generativa que hoy se integra en tareas cotidianas de programación.

Para los usuarios, la aplicación práctica es concreta: revisar con más cuidado los archivos de configuración incluidos en repositorios, desconfiar de cadenas de comandos excesivamente largas y mantener actualizada la herramienta. Anthropic ya corrigió esta vulnerabilidad en la versión 2.1.90 de Claude Code.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.