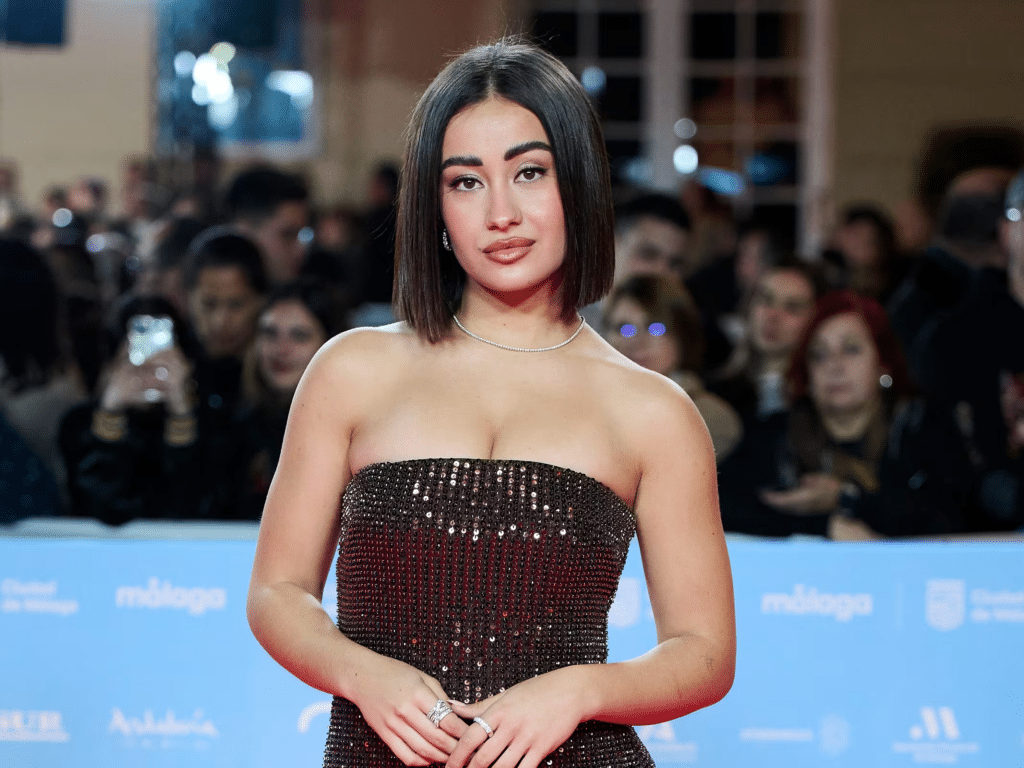

Marina Rivers denunció al contar en ‘Zero Dramas’ que fue víctima varias veces de imágenes creadas con deepfake. El hallazgo no es técnico, pero sí urgente: la inteligencia artificial ya puede fabricar desnudos falsos con un nivel de precisión que desarma a quien los recibe.

La influencer reveló que algunas personas llegaron a enviarle esas imágenes pensando que se trataba de contenido íntimo filtrado. Incluso gente de su entorno cercano dudó de la falsedad. Ahí aparece la pieza clave del problema: cuando lo falso se parece demasiado a lo real, el daño ya no depende de que sea verdad.

Rivers también subrayó el impacto emocional en su familia, especialmente en su padre. Y fue categórica al describir estas prácticas como una forma de violencia digital con una intencionalidad sexual clara, dirigida sobre todo contra mujeres jóvenes.

La IA no “ve” como una persona. Aprende patrones. Toma fotos reales del rostro, los gestos y los ángulos de una víctima, y con ese cableado digital arma una imagen nueva. El resultado no es un simple retoque: es una fabricación completa que usa rasgos reales como materia prima.

Ese es el interruptor que vuelve tan delicado este fenómeno. No hace falta una filtración real para destruir reputación, sembrar dudas o activar vergüenza. Alcanza con una imagen convincente y una red social dispuesta a moverla a gran velocidad.

La máquina que fabrica una mentira creíble

Además, el caso de Marina Rivers revela otro vacío: la respuesta institucional sigue yendo por detrás. Tras acudir a la Policía, recibió una contestación insuficiente por la dificultad de identificar responsables en entornos anónimos.

Ese desfase legal es una preocupación creciente. Los deepfakes sexuales no solo afectan la imagen pública. También golpean la salud psicológica, la vida social y, en algunos casos, abren conflictos laborales o familiares. La central del daño no está en el archivo, sino en su difusión y en la sospecha que instala.

“Muchas mujeres están siendo desnudadas con inteligencia artificial”, advirtió Marina Rivers en su testimonio público.

Por eso, la aplicación práctica de este debate ya no pertenece solo a expertos o tribunales. También toca la rutina diaria de cualquier usuario. Desconfiar de una imagen impactante, no reenviarla, verificar su origen y denunciarla son gestos simples, pero hoy funcionan como una primera barrera de contención.

También hay una oportunidad más amplia. El caso reabre la discusión sobre cómo proteger la identidad digital, qué responsabilidades deben asumir las plataformas y qué herramientas necesitan las víctimas para actuar rápido cuando la mentira ya está en circulación.

La clave, al final, es entender que la IA no solo puede crear contenido útil. También puede forzar cerraduras íntimas que nunca deberían tocarse. Y en esa nueva casa digital, proteger la puerta de entrada empieza por no confundir una imagen posible con una verdad.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.