Buscas una respuesta rápida en Google, lees dos líneas y sigues con tu día. Pero, ¿qué pasa si esa certeza instantánea tiene una grieta y nadie te la muestra?

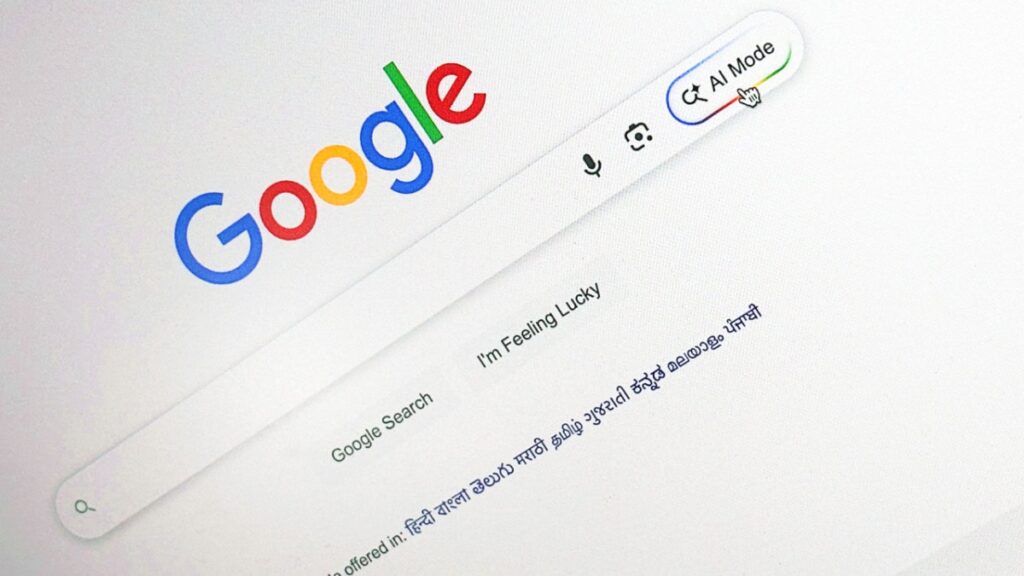

Eso es lo que revela un análisis de The New York Times sobre AI Overviews de Google, los resúmenes generados por inteligencia artificial que ahora aparecen en el buscador. El hallazgo central es incómodo: cerca de una de cada diez respuestas contiene errores.

La pieza clave es Gemini, el modelo de Google, evaluado a través de Oumi, una plataforma de pruebas. Y el problema no se limita a una respuesta aislada: Google procesa alrededor de cinco billones de búsquedas al año, de modo que ese margen de fallo se convierte en una escala masiva.

Traducido a una medida cotidiana, la tasa de error implica unas 57 millones de respuestas incorrectas por hora. O, dicho de otro modo, cerca de un millón por minuto.

También te puede interesar:Google Retira los AI Overviews en Determinadas Búsquedas MédicasAdemás, el mecanismo del fallo no siempre es evidente. La IA puede “alucinar”, un término técnico que describe respuestas inventadas cuando no encuentra una base sólida, y presentarlas con la misma apariencia limpia y segura que una respuesta correcta.

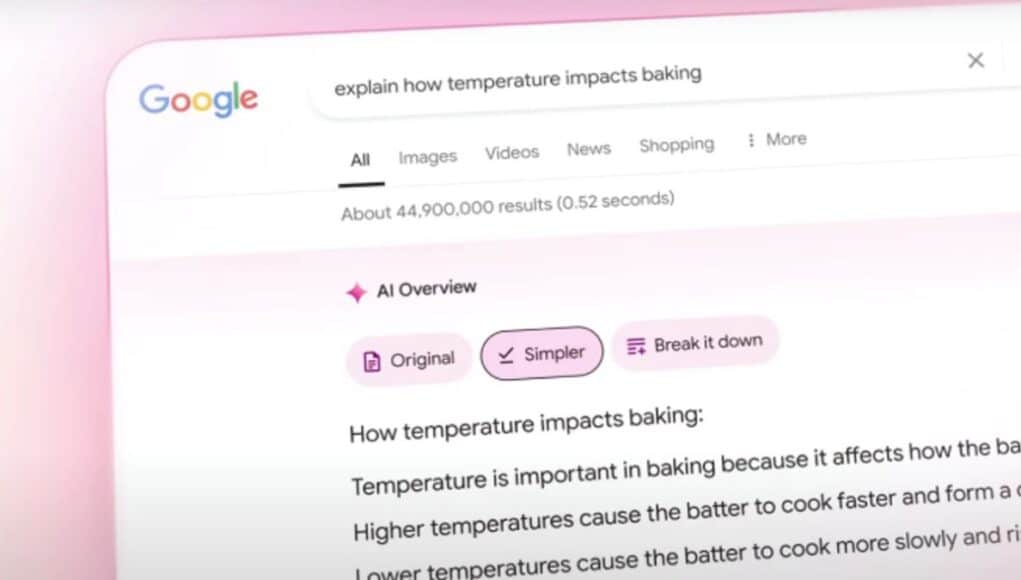

Con AI Overviews ocurre que El usuario ve una caja ordenada, una redacción convincente y enlaces debajo. Sin embargo, ese engranaje puede estar mezclando piezas sueltas: una fuente correcta, otra irrelevante y una frase inventada que une todo con falsa coherencia.

El resumen puede fallar aunque la fuente acierte

El análisis señala un dato especialmente delicado: en algunos casos, el resumen de IA ofrece una respuesta incorrecta mientras que el enlace original sí contiene la información correcta. Es decir, la central que resume puede torcer el mensaje aunque el documento de base esté bien.

Y no solo eso. También puede dar respuestas distintas a la misma pregunta en cuestión de segundos o mostrar enlaces que no guardan relación con la consulta. Ese cambio rápido rompe una expectativa básica del buscador: que dos preguntas iguales activen el mismo mecanismo.

También te puede interesar:Google Retira los AI Overviews en Determinadas Búsquedas Médicas

La BBC comprobó algo similar en un experimento. Allí, AI Overview tomó como referencia una noticia falsa en vez de descartarla, una señal de que el sistema todavía no distingue de forma robusta entre información verdadera y contenido engañoso.

El estudio evidencia que la inteligencia artificial aún no es completamente fiable en el contexto de búsqueda de información.

Qué cambia para el usuario y para los medios

El impacto no se queda en el error factual. Estos resúmenes también están provocando caídas de tráfico en medios de comunicación, porque muchos lectores obtienen una respuesta en la parte superior de Google y ya no entran a la fuente original.

Ahí aparece otra oportunidad, pero también una advertencia. Si menos personas visitan el sitio que produjo la información y más personas aceptan la síntesis automática, el margen para detectar fallos se achica.

La tendencia a confiar en lo que dice una IA funciona como un piloto automático. Si la pantalla habla con tono firme, muchos usuarios asumen que el contenido ya fue verificado, aunque no siempre sea así.

Por eso, la recomendación práctica es simple: usar AI Overviews como un mapa, no como destino final. Si una respuesta afecta salud, dinero, seguridad o derechos, conviene abrir la fuente, comparar y revisar fecha y contexto.

Google está cambiando la puerta de entrada a internet. Pero cuando el nuevo portero todavía confunde llaves, la mejor defensa sigue siendo la misma: mirar dos veces antes de dejarlo pasar.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.