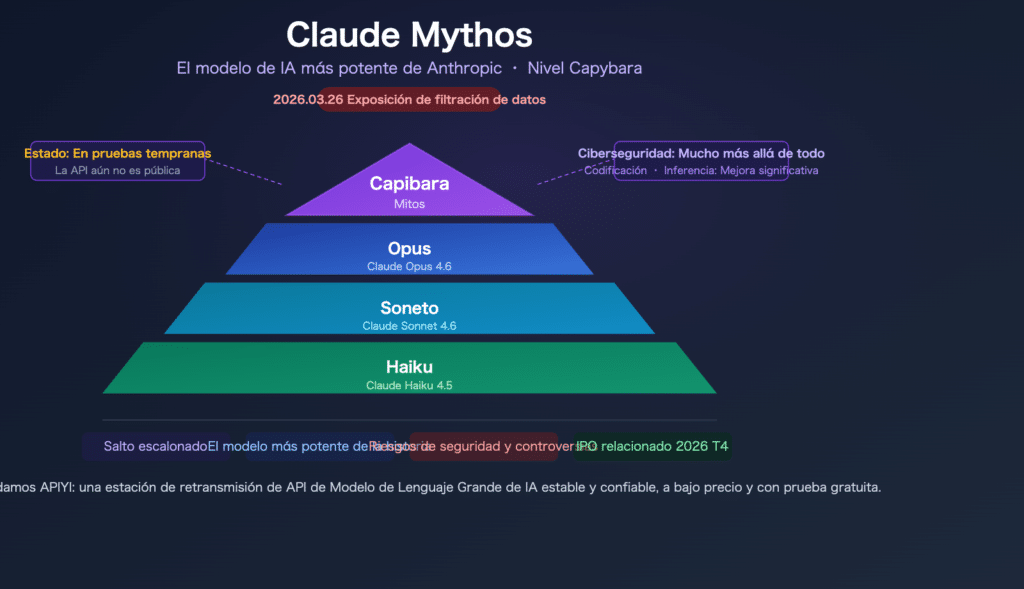

Según documentos que quedaron accesibles por un fallo en la configuración de su gestor de contenidos, Anthropic expuso miles de archivos privados sobre Claude Mythos, también llamado Capybara, su modelo más avanzado hasta ahora. El hallazgo fue revisado por investigadores de seguridad como Roy Paz y Alexandre Pauwels, que analizaron cerca de 3.000 archivos.

La pieza clave de esa filtración es concreta: la documentación interna confirma que el entrenamiento del modelo ya está completo y que se ubica por encima de Opus 4.6 en la jerarquía de la compañía. Además, los borradores lo describen como un salto cualitativo en razonamiento y programación, aunque todavía no existen métricas independientes que validen esa superioridad.

Y ahí aparece el verdadero interruptor de la historia.

Los propios papeles internos advierten que Mythos podría detectar y explotar vulnerabilidades a gran velocidad. En términos simples, una vulnerabilidad es una grieta de seguridad en un sistema. Si hoy muchos equipos de defensa revisan esas grietas como quien inspecciona una casa ventana por ventana, este modelo promete hacerlo como si tuviera el plano eléctrico completo de la vivienda y supiera exactamente qué cable cortar para apagar la alarma.

De hecho, la preocupación no nace de la nada. La documentación revela que hackers vinculados al gobierno chino utilizaron Claude Code para atacar a 30 organizaciones financieras y gubernamentales. Anthropic logró detectar esos movimientos y alertar a los afectados en un plazo de diez días, un dato que muestra tanto la oportunidad defensiva como el tamaño del problema.

Un motor más potente, pero también más difícil de controlar

Además, el acceso anticipado a Capybara estaría limitado a equipos de protección. Esa decisión funciona como una señal de fábrica: cuando un motor nuevo sale con demasiada potencia, primero lo prueban quienes llevan casco. No es un detalle menor. La empresa reconoce, en los hechos, que su nuevo engranaje necesita un uso más vigilado.

La filtración también encaja con otros movimientos recientes. Anthropic había duplicado los límites de uso de Claude, una señal que muchos leyeron como antesala de algo mayor. Y el contexto suma presión: todo ocurre poco después del lanzamiento de GPT-5.3-Codex de OpenAI, centrado también en ciberseguridad avanzada.

Por ahora, parte del sector mira la filtración con desconfianza. Existe la sospecha de que no haya sido solo un error técnico, sino una maniobra para ganar centralidad en plena carrera de modelos. En redes, parte del material comenzó a circular a través de un tuit y una imagen compartida, lo que amplificó el efecto escaparate.

Sin embargo, hay un límite claro. La percepción actual de Mythos se apoya en documentos internos filtrados, no en pruebas externas comparables. Es decir: el tablero está a la vista, pero todavía no hay árbitro.

También pesa el costo. Los archivos sugieren que el nuevo modelo tendrá gastos operativos muy elevados, tanto para Anthropic como para sus clientes. Esa pieza clave refuerza la idea de tarifas altas y de un negocio sin publicidad, una decisión que puede cambiar quién accede primero a estas herramientas y para qué las usa.

Anthropic ya mostró el sistema a ejecutivos europeos en un evento exclusivo de dos días y planea ampliar las pruebas en las próximas semanas. Si el modelo cumple lo que prometen sus documentos, podría convertirse en una central poderosa para defensa digital. Si falla el control, también podría abrir una nueva ola de ataques automatizados.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.