Pagar cada mes por tokens a OpenAI o Anthropic empieza a cansar a muchos usuarios avanzados. Y no es solo una cuestión de dinero a final de mes, sino de soberanía de datos y privacidad real. Tras meses viendo cómo los pequeños modelos de lenguaje se hacían más eficientes, por fin tenemos una alternativa seria que corta de raíz el cordón umbilical con los servidores centralizados.

Hablamos de Atomic Bot, un asistente personal hipervitaminado que acaba de lanzar soporte completo para modelos locales basándose en el framework OpenClaw. La promesa es golosa: ejecutar tu propio agente autónomo en tu máquina sin que un solo byte de información personal salga de tu disco duro. Así de contundente.

La IA aterriza en tu escritorio sin tener que pelear con la terminal

Y es que, hasta el día de hoy, montar algo medianamente parecido en casa requería conocimientos técnicos bastante avanzados. Si querías trastear con OpenClaw, un proyecto de código abierto espectacular que ya acumula la locura de 330.000 estrellas en GitHub, te tocaba arremangarte. Había que pelearse con la interfaz de línea de comandos (CLI), lidiar con contenedores Docker y editar tediosos archivos de configuración. Una barrera de entrada insalvable para la gran mayoría.

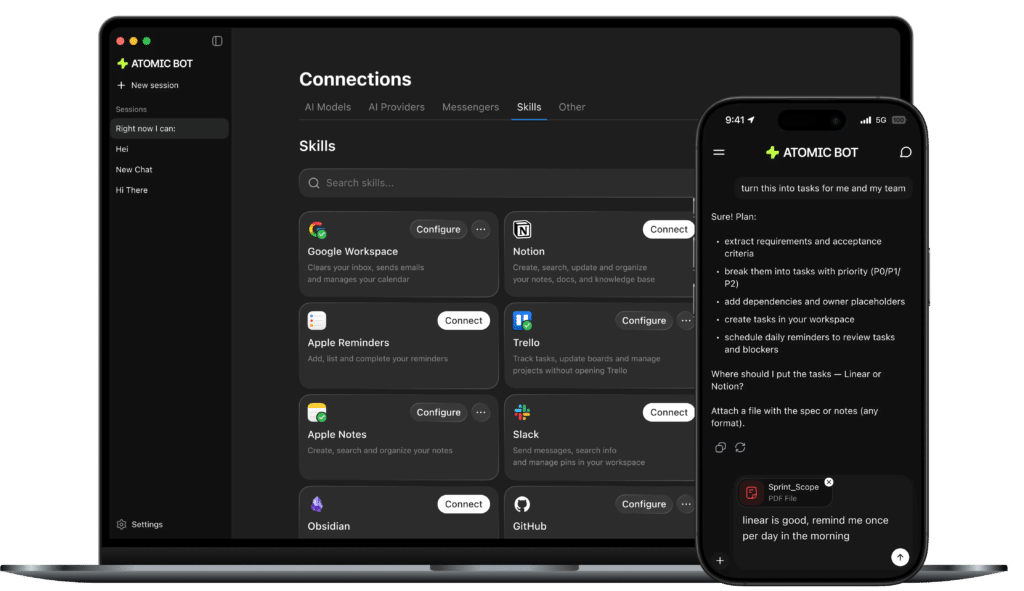

Precisamente por esto, el nuevo movimiento del equipo de desarrollo cambia por completo las reglas del juego. La gente detrás de Atomic Bot (GitHub) ha logrado empaquetar todo ese potencial en una aplicación de escritorio nativa súper limpia. Cuenta con un instalador de un solo clic y ya está disponible tanto para sistemas macOS como para Windows. Olvídate de configuraciones oscuras y dependencias críticas; la app trae incluso su propio asistente de configuración integrado y se actualiza sola.

También te puede interesar:Anthropic Bloquea Temporalmente al Creador de OpenClaw en ClaudeEn concreto, la magia detrás de esta ejecución local se realiza mediante una profunda integración con Ollama. Gracias a esta pasarela, el usuario puede descargar directamente desde el repositorio de Hugging Face auténticas bestias del open-source como Llama de Meta, Gemma de Google o Qwen de Alibaba. Todas las peticiones, los prompts y los contextos que le lances al agente se procesan a través de un servidor de inferencia que corre en tu propio PC. Adiós definitivo a las claves API, a la compra de tokens y a la creación de cuentas externas.

Un ecosistema monstruoso con 40.000 habilidades gratuitas

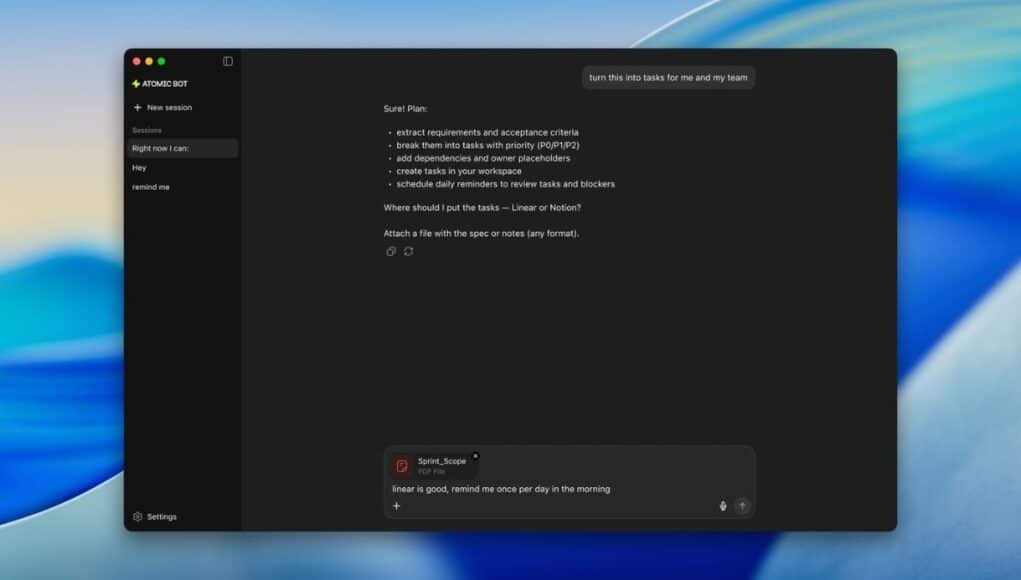

Pero claro, un modelo de lenguaje aislado en un entorno cerrado sirve de poco si no puede interactuar con tus herramientas del día a día. El verdadero músculo de esta solución radica en que mantiene intactas todas y cada una de sus funciones de automatización. El asistente es capaz de cribar tu bandeja de correo, agendar reuniones en tu calendario, organizar archivos locales o realizar búsquedas en el navegador web mientras tú te tomas un café. Se integra en tu flujo de trabajo sin pestañear.

Por si fuera poco, la plataforma ofrece acceso directo al marketplace oficial ClawHub. Hablamos de un repositorio que cuenta con más de 40.000 habilidades de terceros listas para potenciar al agente en cuestión de segundos. A esto se le suma una compatibilidad nativa envidiable con casi cualquier plataforma de mensajería que uses. Puedes conectar tu agente autoalojado a canales de Telegram, espacios de Slack, servidores de Discord y hasta WhatsApp. Las posibilidades de automatización son prácticamente infinitas.

La factura física: ¿Qué ordenador necesitas para mover a esta bestia?

Como era de esperar, tener inteligencia artificial pura corriendo de forma nativa en tu dispositivo no sale gratis a nivel de hardware. Aquí es donde nos damos de bruces con la realidad técnica de nuestros ordenadores. Para que el agente local funcione de forma fluida y sin cuelgues constantes, los requisitos de memoria RAM van a depender directamente del peso del modelo que escojas.

También te puede interesar:Anthropic Bloquea Temporalmente al Creador de OpenClaw en ClaudeSi miramos los números detenidamente, para arrancar modelos ligeros de entre 7.000 y 8.000 millones de parámetros (7B a 8B), vas a necesitar un mínimo absoluto de 16 GB de RAM. Si eres más ambicioso y quieres dar el salto a modelos más capaces y racionales de 14B, tu máquina deberá contar con al menos 32 GB. Esta vía local no busca reventar los benchmarks de velocidad extrema, sino ofrecer una trinchera segura para quienes priorizan el control total de sus costes y el blindaje de su privacidad.

Básicamente, sacrificas un poco la inmediatez de la nube a cambio de tener soberanía sobre lo que escribes. Aunque ojo, los desarrolladores han pensado en todo. La aplicación permite saltar a proveedores en la nube tradicionales con un simple ajuste, ideal para esas tareas de razonamiento extremo que pongan de rodillas a tu ordenador. El modo por defecto es 100% offline, pero tienes una válvula de escape si la necesitas.

Y llegamos al asunto económico, que siempre duele. Todo este entramado de Atomic Bot es completamente gratuito bajo licencia MIT. Nadie te cobrará por alojar a tu agente. Eso sí, para rentabilizar el proyecto, han lanzado un plan de pago opcional enfocado en los usuarios que quieran delegar la gestión de las APIs en la nube y pasar olímpicamente de configurarlas a mano. La pelota está ahora en el tejado de los grandes monopolios tecnológicos. Toca esperar para ver si se atreven a ofrecer esta misma libertad sin condiciones, o si será verdaderamente el código abierto quien conquiste nuestros discos duros para siempre.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.