Parece que la guerra de la inteligencia artificial ya no va solo de quién entrena el modelo de lenguaje más listo de la industria. Ahora la verdadera batalla se libra en quién te lo pone más fácil para usarlo en el mundo real. Y aquí Anthropic acaba de dar un golpe sobre la mesa bastante contundente. Acaban de presentar sus nuevos Claude Managed Agents, una suite en la nube que promete hacer que crear agentes autónomos deje de ser un infierno de código. Así de directo.

La promesa de la compañía de San Francisco es salvaje. Quieren reducir el tiempo de desarrollo de meses a apenas unos días. Para lograrlo, ofrecen una infraestructura lista para producción desde el minuto uno, orientada tanto a desarrolladores independientes como a grandes corporaciones.

El fin de la pesadilla de la orquestación manual

Para que nos entendamos rápido. Hasta ahora, si querías que un LLM hiciera tareas complejas por su cuenta, no bastaba con escribir un prompt ingenioso y esperar magia. Tenías que montarte tu propio sistema de seguridad, gestionar la memoria del modelo y cruzar los dedos para que la cadena de acciones no se rompiera de forma inesperada. Un auténtico caos técnico.

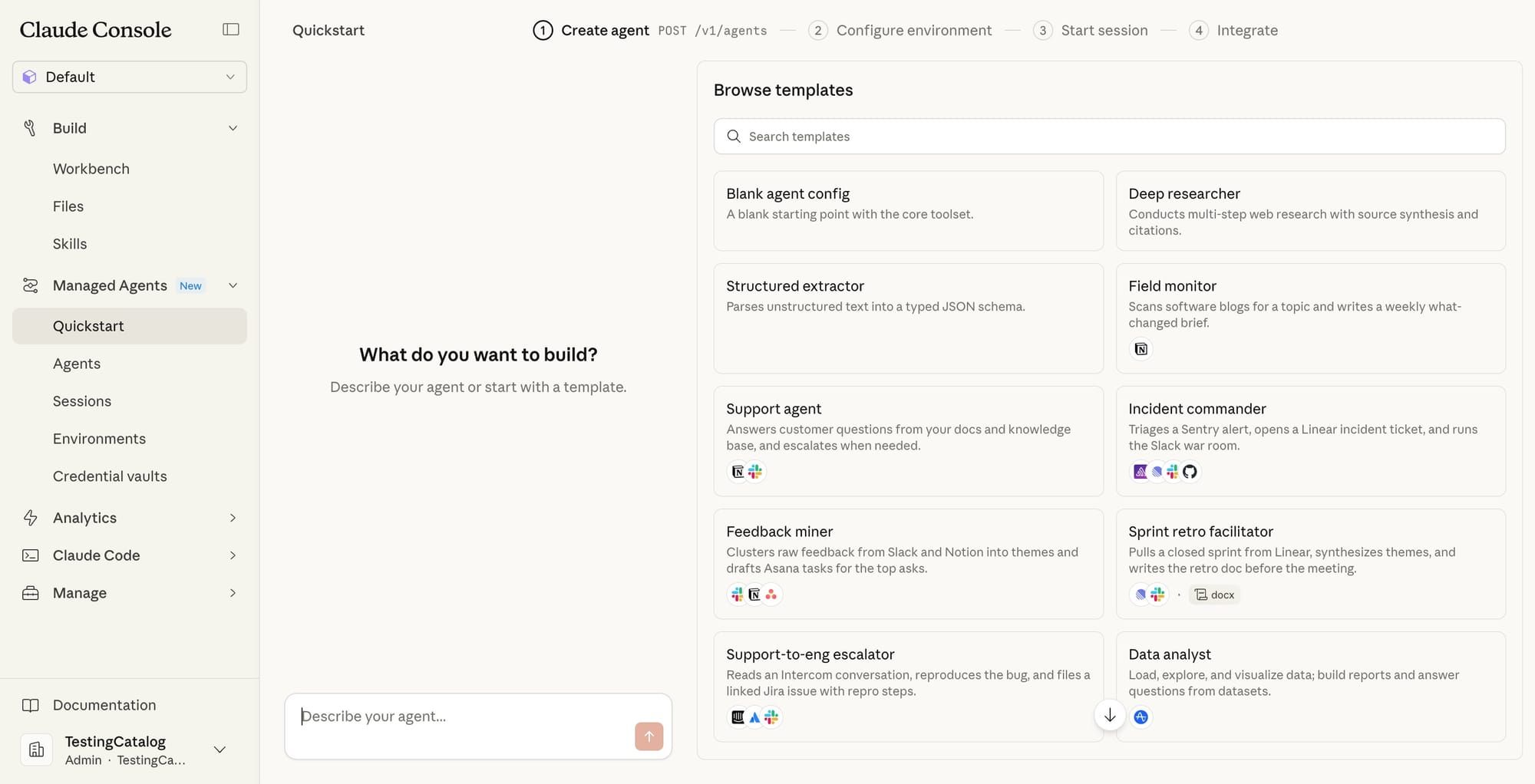

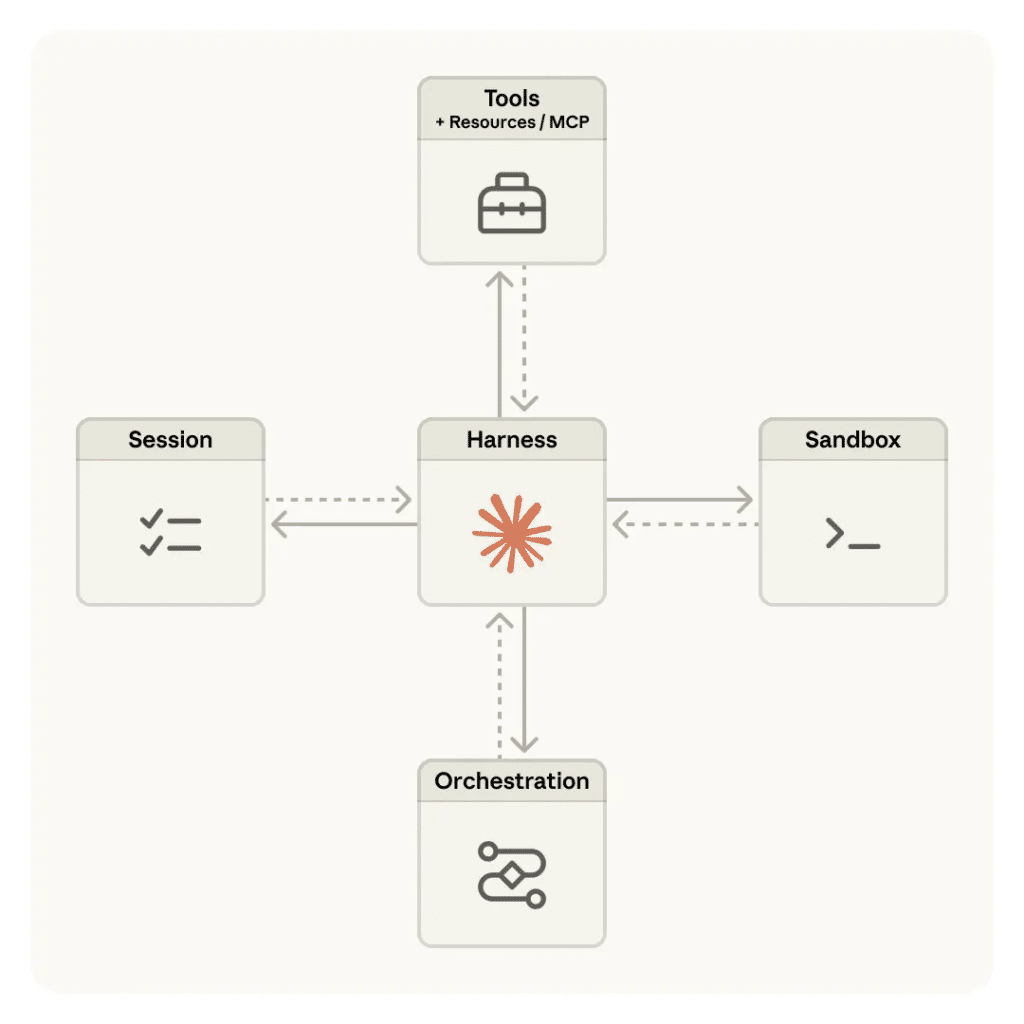

La estrategia de Anthropic con su ecosistema Claude cambia totalmente este paradigma de trabajo. Lo que ofrecen ahora en fase beta pública es una infraestructura de agentes lista para usar en entornos empresariales. Básicamente, tu equipo de ingeniería se encarga de definir cuáles son las tareas y las herramientas disponibles. De los tediosos dolores de cabeza de la orquestación ya se encarga la máquina.

También te puede interesar:Anthropic Presenta la Función Memory en Claude Agents para Empresas y EquiposSi miramos debajo del capó, el nivel de detalle técnico convence rápido. La plataforma incluye ejecución de código en un sandbox seguro, sistemas de autenticación robustos y permisos con un alcance ultra definido. Esto garantiza que el modelo no va a acceder a ninguna base de datos sensible por error. Ni se inmuta.

Pipelines complejos y sesiones que no pierden el hilo

La letra pequeña de esta actualización es justo lo que muchas start-ups llevaban pidiendo a gritos. Los Claude Managed Agents permiten ejecutar desde un flujo simple de una sola instrucción hasta pipelines complejos con múltiples agentes interactuando en la sombra.

Dicho de otra forma, puedes tener a un agente de IA analizando miles de líneas de código mientras otro redacta un informe de vulnerabilidades en paralelo. De hecho, la coordinación entre múltiples agentes es uno de los elementos más rompedores de este lanzamiento. Aunque desde Anthropic avisan que esta función en concreto aún está en fase de investigación preliminar, promete muchísimo.

A nivel de estabilidad operativa, el sistema incorpora algo que francamente cambia las reglas: sesiones persistentes de larga duración y checkpointing. Si tu agente lleva cuatro horas cruzando datos financieros masivos y sufre un error de red, no tienes que empezar de cero. La propia arquitectura en la nube de Anthropic gestiona la recuperación del fallo y mantiene el contexto del chat intacto. Menos cómputo desperdiciado y más dinero ahorrado en la factura mensual de la API.

También te puede interesar:Anthropic Presenta la Función Memory en Claude Agents para Empresas y EquiposY los números del laboratorio de pruebas respaldan el producto final. Durante sus test internos, el uso de esta infraestructura gestionada mejoró la tasa de éxito hasta en 10 puntos porcentuales a la hora de generar archivos con estructuras complejas frente a métodos de prompting tradicionales. Adiós a las alucinaciones que rompen los formatos JSON.

Las grandes tecnológicas ya han comprado la idea

Como ocurre siempre en el ecosistema de Silicon Valley, el papel lo aguanta todo, pero son las empresas de primera línea las que validan un producto. Y parece que la adopción inicial está siendo un rotundo éxito. Nombres de software que todos usamos a diario ya están metidos de lleno en esta plataforma para optimizar sus rutinas.

Compañías del calibre de Notion, Rakuten, Asana, Vibecode o Sentry ya han integrado esta suite de APIs en sus flujos internos. Las métricas que reportan estos primeros usuarios empresariales hablan de despliegues fugaces y mejoras operativas drásticas casi inmediatas. Lo están aplicando a la automatización masiva de código, la productividad ofimática y hasta en procesos pesados de recursos humanos y finanzas.

El motivo principal de este éxito temprano es puramente económico. No es lo mismo que un equipo de desarrolladores senior dedique un trimestre entero a programar un orquestador de IA propio, a que lo tengan corriendo de forma estable en cinco días. El recorte en los costes de ingeniería es gigantesco. Una auténtica locura. Si te interesa repasar el desglose exacto de estas implementaciones y sus especificaciones técnicas, puedes echar un vistazo a la fuente oficial del anuncio.

Para rematar la experiencia de desarrollo, la consola incorpora ahora capacidades de trazado de sesiones integradas. Esto significa que los ingenieros pueden visualizar paso a paso qué ruta lógica está tomando el agente para resolver un problema. Se acabó el mito de la caja negra donde la inteligencia artificial toma decisiones incomprensibles. Todo queda registrado y auditable.

La pelota está ahora mismo en el tejado de gigantes como OpenAI, Meta o Google, que van a tener que pisar el acelerador si no quieren que Anthropic se quede con el monopolio del despliegue corporativo ágil. Democratizar la creación de agentes autónomos, seguros y baratos era el último gran obstáculo para la adopción masiva en las empresas. Con este movimiento de fichas, esa barrera acaba de saltar por los aires. Tocará vigilar de cerca cuántas aplicaciones millonarias nacen apoyadas en esta nueva arquitectura durante el próximo año.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.