Grok, el modelo de lenguaje (LLM) de X.com, ha dado un paso adelante con una nueva y sorprendente función: la capacidad de entender imágenes. Ahora, los usuarios pueden subir imágenes en la versión web y móvil de Grok, lo que permite a la inteligencia artificial interpretar elementos visuales dentro de las capturas. Esta característica, que había estado en modo experimental y oculta bajo "feature flags", finalmente está disponible para un público más amplio.

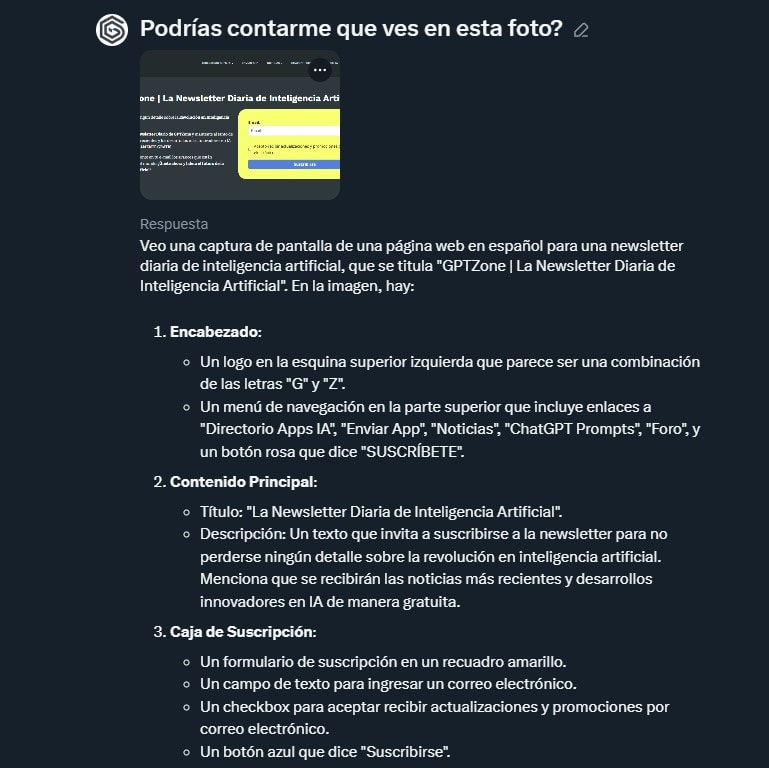

La nueva funcionalidad de Grok permite que el modelo de lenguaje entienda y responda a preguntas sobre imágenes cargadas por los usuarios. Esta capacidad va más allá de los típicos análisis de texto, haciendo posible que la IA identifique detalles visuales y elementos clave en una imagen. Así, si un usuario sube una captura de pantalla o foto con texto, Grok puede interpretarlo, reconocer URL o nombres de sitios web visibles, y responder preguntas sobre el contenido.

Esta función es especialmente útil para quienes requieren información rápida sobre elementos visuales específicos en imágenes. Con esta herramienta, los usuarios ya no están limitados a preguntar sobre datos escritos, sino que pueden pedir análisis más completos y precisos de sus imágenes.

El proceso es simple: los usuarios suben una imagen y formulan su pregunta, y Grok procesa la imagen para ofrecer respuestas detalladas. Un ejemplo compartido en redes sociales muestra cómo, al preguntar “¿Qué sitio web es este?” en una captura de pantalla, Grok responde con el nombre del sitio y la URL visible, identificando correctamente que se trata de testingcatalog.com. Este nivel de reconocimiento permite a los usuarios obtener respuestas basadas en detalles específicos de la imagen sin necesidad de análisis externos.

A diferencia de muchas herramientas de IA que solo permiten estas funciones en ciertas plataformas, la capacidad de visión de Grok está disponible tanto en dispositivos móviles como en la versión web. Esta versatilidad facilita que los usuarios de X.com aprovechen la función sin importar el dispositivo que usen, adaptándose a diferentes necesidades y estilos de trabajo.

Esta función fue anunciada públicamente por @Yaroslav, uno de los desarrolladores de X.com, quien confirmó la liberación de la capacidad de entender imágenes y solicitó retroalimentación de los usuarios para ayudar a mejorar la herramienta y reportar posibles errores.

Con esta nueva función, Grok no solo se mantiene a la vanguardia en el ámbito de los modelos de lenguaje, sino que avanza hacia modelos multimodales, capaces de entender tanto texto como imágenes. A continuación, algunos de los beneficios más destacados de esta actualización:

Con esta actualización, X.com muestra su intención de liderar la competencia en IA multimodal, ofreciendo un modelo de lenguaje que entiende y responde tanto a textos como a imágenes cargadas por el usuario. Esta capacidad mejora la utilidad de Grok en contextos variados y demuestra un avance en la creación de herramientas de IA más intuitivas y completas.

La capacidad de visión de Grok representa una expansión significativa de sus funcionalidades, haciendo de esta IA una herramienta más poderosa y adaptada a necesidades visuales y textuales.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.