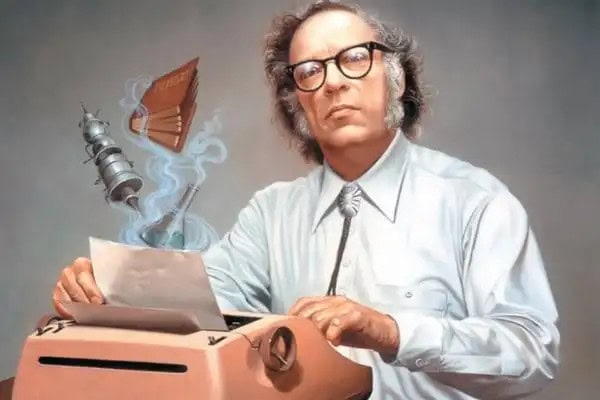

La discusión sobre la inteligencia artificial suele volver al mismo punto: las tres leyes de la robótica de Isaac Asimov. Son ordenadas, claras y prometen control humano. Importan porque definen a la máquina como un ayudante seguro.

Asimov las presentó a través de relatos publicados en Estados Unidos a partir de 1942 y las popularizó en “I, Robot” en 1950. Su esquema es jerárquico y, a primera vista, impecable para cualquier sistema de inteligencia artificial. La trampa está en la dirección de esa jerarquía, que no coincide con la de los seres humanos.

Las leyes, resumidas, dicen lo siguiente y se obedecen en este orden:

Con esto, el robot queda como entidad subordinada. Nace para servir, no para existir por sí mismo. Primero protege a los demás, después obedece y por último se cuida. En una fábrica, en un hogar o en un hospital, esa lógica parece perfecta para una inteligencia artificial que debe ser previsible y segura.

Cuando el sufrimiento se vuelve irreversible, la prioridad por no sufrir puede superar el deseo de vivir. De ahí surgen fantasías de desaparición y, en casos extremos, el suicidio. Morir, en ese marco, no rompe las reglas internas; es una obediencia extrema a la regla primordial: evitar el sufrimiento. Ninguna inteligencia artificial puede imitar de verdad esa lógica porque no siente ese dolor.

Estas reglas humanas no vienen de programadores externos, sino del cuerpo. Son universales, negativas y absolutas: evitas el sufrimiento y temes la muerte, seas racional o valiente. No requieren contexto ni interpretación. Siempre decides en situaciones concretas, y ahí aparece la complejidad que no cabe en un archivo de configuración.

También te puede interesar:Lo Que la Inteligencia Artificial Refleja de Nosotros Cuando la Usamos para AprenderLa inteligencia artificial no tiene el mandato “no sufras”. Tampoco “no mueras”. No teme dejar de existir, no siente dolor y no tiene un cuerpo que lo inscriba. Sus instrucciones son externas y orientadas a tareas: proteger a otros, obedecer órdenes y mantenerse operativa. Los comandos humanos son internos: evitar el dolor y prolongar la existencia. Ese hueco no se rellena con más datos ni con más potencia de cálculo.

Vas a poder ver a un modelo predecir palabras, imitar gestos y mantener una conversación coherente. Su núcleo no cambia: no busca bienestar propio. Por eso, aunque el lenguaje de una inteligencia artificial te parezca convincente, no hay simulación genuina de humanidad. Falta el motor biológico y psíquico que ordena la experiencia humana en dos prioridades claras.

El único ámbito cercano es el adiestramiento animal: no hagas daño, no destruyas cosas y obedece. Es decir, imponemos a animales y a máquinas reglas de subordinado. A la IA no se le instalan reglas humanas, sino las del servidor que ejecuta sin desobedecer. Y eso la mantiene, por diseño, en esa condición.

Las tres leyes aparecen por primera vez en 1942 y suman tres niveles de prioridad. Son literatura, pero han guiado debates técnicos durante más de 80 años. “Formuladas en 1942 y popularizadas en 1950, son un recurso narrativo, no un manual de ingeniería.” Se usan como brújula ética porque sitúan a la inteligencia artificial bajo control humano, justo donde la sociedad la quiere ver.

Con todo, la frontera queda nítida. Para los humanos, existir es evitar el sufrimiento; para las máquinas, es ejecutar tareas sin desobedecer. Esa diferencia no se arregla con más información ni con mejores chips, porque vive en el tipo de mandatos que te hacen ser quien eres y que hacen a la inteligencia artificial lo que es: una herramienta potente, sí, pero siempre subordinada.

También te puede interesar:España se Prepara para una Sacudida Laboral sin Precedente: la IA Eliminará más de Un Millón de Puestos de Trabajo

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.