Imagínate que generas una portada con IA, la subes a una plataforma, publicas un libro y empiezas a venderlo. Todo parece normal hasta que recibes una notificación: te investigan por posible infracción de copyright por usar Stable Diffusion. Esto es lo que le ha ocurrido a un joven de 27 años en Japón.

El caso está llamando la atención en todo el mundo porque ya no se mira solo a las grandes empresas de IA, sino directamente a la persona que ha usado el modelo. A lo largo del artículo vas a poder entender qué ha pasado, por qué este procedimiento penal puede marcar un antes y un después y qué puede significar para ti cada vez que generas una imagen con una IA generativa como Stable Diffusion.

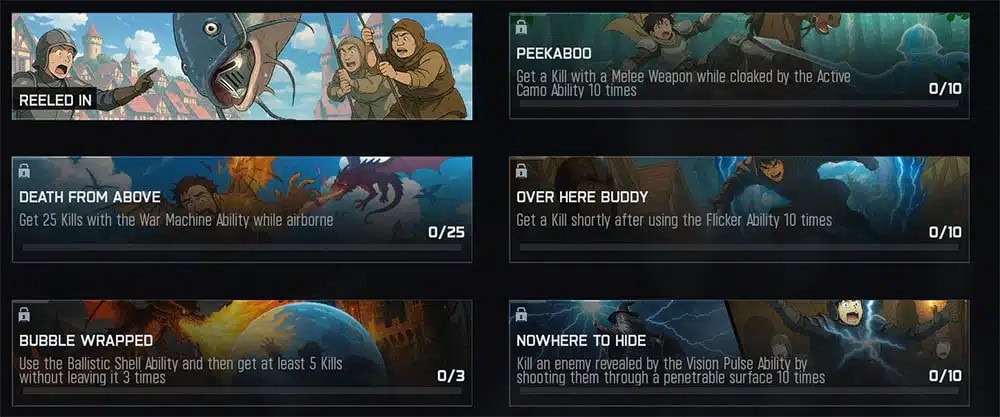

La historia arranca con un usuario japonés que decide usar Stable Diffusion para generar imágenes. Según los informes, no creó solo una ilustración aislada, sino unas 20.000 imágenes con la IA, probando variaciones y parámetros hasta conseguir algo que encajase con lo que buscaba para un proyecto comercial.

De todas esas imágenes generadas con IA, escogió una para usarla como portada de un libro que se llegó a vender. Aquí está el punto crítico: las autoridades consideran que esa portada es “presuntamente” una reproducción o imitación sustancial de una obra que está protegida por derechos de autor. Por eso se está investigando si hay una infracción de copyright por IA generativa.

Hasta ahora, la mayoría de procedimientos legales relacionados con imágenes generadas por IA se han dirigido contra los desarrolladores de los modelos, no contra los usuarios. Es decir, los focos estaban en quienes entrenan, lanzan y mantienen herramientas como Stable Diffusion, Midjourney o servicios similares.

El caso japonés rompe ese patrón porque apunta directamente al consumidor final, a la persona que abre el programa, escribe el prompt y genera la ilustración. Si un juez termina condenando al acusado, podríamos estar ante el primer caso penal contra un usuario de Stable Diffusion por reproducir una obra protegida, algo que marcaría una referencia muy fuerte para otros países.

Te puedes preguntar qué hay de especial en el uso de esta herramienta, si en el fondo miles de personas generan imágenes cada día. La diferencia está en el volumen y en la intención. Este usuario japonés habría generado alrededor de 20.000 imágenes con Stable Diffusion antes de seleccionar una concreta para su proyecto editorial.

Generar tantas imágenes sugiere un proceso muy dirigido, con pruebas y ajustes constantes sobre el modelo de IA generativa. No se trataba solo de “jugar” con la aplicación, sino de encontrar una imagen que cumpliera una idea bastante concreta y que luego se usaría en un producto a la venta, lo que refuerza el carácter comercial de toda la operación.

El corazón del conflicto está en la similitud sustancial entre la imagen de IA y una obra protegida. Las autoridades y los informes locales señalan que la portada generada con Stable Diffusion se parece en gran medida a una creación que ya tenía derechos de autor, aunque todavía no se ha publicado cuál es esa obra original.

En derecho de copyright, no hace falta que una copia sea perfecta para entrar en problemas. Si el resultado reproduce elementos clave de estilo, composición o personajes de una obra protegida, y se usa con fines comerciales, se puede considerar una infracción. Y esto es lo que se está analizando en este caso japonés, con la peculiaridad de que la “copia” viene de una IA generativa.

Cuando generas algo solo para uso privado, el riesgo suele ser menor. Aquí la situación cambia porque la imagen creada con Stable Diffusion se usó como portada de un libro comercializado. Es decir, hubo ventas, dinero en juego y una obra derivada visible en librerías o plataformas en línea.

Ese uso comercial funciona como un factor agravante en la posible infracción de copyright. No se trata solo de inspiración visual, sino de explotar económicamente una portada basada, presuntamente, en una creación ajena. Este punto es una de las razones por las que el caso ha despertado tanta atención dentro y fuera de Japón.

Una de las preguntas clave es si basta con que la IA “genere algo parecido” o si hace falta que tú tengas la intención de copiar. En este procedimiento penal, la acusación sostiene que el usuario dio instrucciones muy precisas a Stable Diffusion para reproducir una imagen concreta que estaba protegida por derechos de autor.

Ese nivel de detalle en los prompts y en la configuración del modelo de IA podría ser lo que diferencia este caso de situaciones más abiertas o experimentales. Según un experto legal citado en la prensa, el juicio obligará a preguntarse si la intencionalidad del usuario y su control operativo sobre la IA deben contar a la hora de decidir si hay delito de copyright.

Si tú solo pruebas un par de prompts genéricos y la IA saca algo que recuerda lejanamente a una obra famosa, la situación es una. Si ajustas parámetros, repites instrucciones, pides cambios detallados y persigues que la imagen se parezca lo máximo posible a un trabajo protegido, el análisis puede cambiar.

En el caso japonés, el control intenso sobre Stable Diffusion y sus parámetros es uno de los elementos que se van a estudiar. Si se demuestra que el objetivo era replicar un trabajo concreto con derechos de autor, podrían abrirse puertas a una responsabilidad directa del usuario de IA generativa, algo que hasta ahora se discutía sobre todo en el plano teórico.

Aunque las autoridades locales han recomendado acusar al usuario, todavía hay zonas oscuras en el expediente. Por ejemplo, no se ha hecho pública cuál es la obra original supuestamente vulnerada, lo que complica que expertos externos puedan comparar o valorar el grado de similitud en detalle.

Tampoco está claro si el titular de los derechos de esa obra presuntamente copiada es quien ha presentado la denuncia directa, o si todo parte de una investigación de oficio o de otra vía. Si el propietario de los derechos no está claramente implicado, la causa podría ser más débil y eso añade incertidumbre sobre cómo terminará el caso penal.

Para entender mejor lo que significa lo que ocurre en Japón, conviene mirar fuera. En Reino Unido se presentó un caso similar impulsado por la empresa detrás de Getty Images, centrado en el uso de material protegido en el entrenamiento y en la generación de imágenes con IA. Ese procedimiento no llegó a prosperar judicialmente, lo que mostró lo complicado que es encajar estas situaciones en las leyes actuales.

En Estados Unidos, la tendencia va por otra vía. Allí se ha establecido que las imágenes generadas por IA no pueden acogerse a la protección de copyright tradicional, al menos cuando la creación no incluye suficiente aportación humana. Eso no significa que puedas copiar lo que quieras, pero sí que la propia imagen creada por IA tiene un estatus legal distinto al de una ilustración manual.

Hasta ahora, muchas demandas se dirigían contra las empresas que crean o entrenan modelos como Stable Diffusion, acusándolas de usar obras con derechos de autor sin permiso para entrenar la IA. En el caso japonés, en cambio, el foco se desplaza claramente al usuario que ha generado y comercializado la portada.

Este cambio de foco puede influir en cómo tú mismo usas la IA. Si los tribunales empiezan a ver la responsabilidad del usuario de Stable Diffusion como algo central, no bastará con decir “la IA lo ha hecho”. Se tendrá en cuenta qué prompts has escrito, cómo has ajustado la herramienta y qué has hecho luego con el resultado.

Si este procedimiento japonés termina en una condena, el impacto puede ir más allá de un solo país. Una decisión firme que castigue la reproducción deliberada de obras protegidas con IA generativa puede servir de referencia a otros legisladores y jueces, que buscarán ejemplos reales para tomar sus propias decisiones.

En la práctica, eso podría significar que, si te demuestran que has manipulado los parámetros de Stable Diffusion con el propósito de replicar un trabajo protegido, podrías enfrentar responsabilidad penal o civil directa. No solo se miraría al creador del modelo, sino también a quien ha decidido usar la IA de una forma muy cercana a la copia.

Si sueles generar imágenes con IA, este caso te sirve como aviso. No se trata de tener miedo a cada prompt, sino de evitar situaciones en las que pidas a la herramienta “calcados” de portadas, personajes o ilustraciones muy concretas que sabes que tienen copyright y luego quieras venderlas.

Por otro lado, el panorama legal sigue moviéndose y no todo está claro. Muchos aspectos, como la definición exacta de “similitud sustancial” en obras de IA o el peso de la intención del usuario, seguirán discutiéndose en los tribunales. Ver un procedimiento penal contra un usuario de Stable Diffusion en Japón ya indica que el margen de tolerancia se está estrechando.

Al final, el caso japonés te muestra que usar Stable Diffusion para generar imágenes no es un juego aislado del mundo real. Por ahora, la mejor estrategia pasa por usar la IA como herramienta creativa sin buscar copias directas, y seguir de cerca cómo evoluciona este tipo de juicios para saber hasta dónde puede llegar la responsabilidad de cada usuario.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.