¿Te pasó de cortar una videollamada o bajar la calidad de un streaming por miedo a “pasarte” de datos? Con la inteligencia artificial empieza a aparecer un reflejo parecido: usarla a medias, escribir prompts cortos y apagarla rápido para que no se dispare el costo.

Pero un hallazgo en el mapa chino de IA está moviendo ese engranaje. La empresa MiniMax lanzó M2.5, un gran modelo de lenguaje o LLM (un sistema que genera texto), con una promesa provocadora: sería tan barato de operar que “no vale la pena medir el precio”.

En paralelo, DeepSeek gana usuarios con políticas que, según Microsoft, le abren mercados donde compañías de EEUU como OpenAI tienen más fricción. Y mientras gigantes como Tencent, Alibaba o ByteDance invierten a ritmo de pasos de gigante —ByteDance incluso presentó Seedance 2.0, que ya genera tensiones en industrias creativas— aparecen “tigres” como Zhipu AI y la propia MiniMax con otra filosofía: menos épica de laboratorio y más utilidad diaria.

La pieza clave en M2.5 no es solo “ser inteligente”. Es el mecanismo que lo hace eficiente sin perder músculo, como un empleado digital más que como un simple chatbot. El objetivo es que trabaje de forma autónoma en tareas productivas, y que el usuario lo deje funcionando sin estar mirando el reloj.

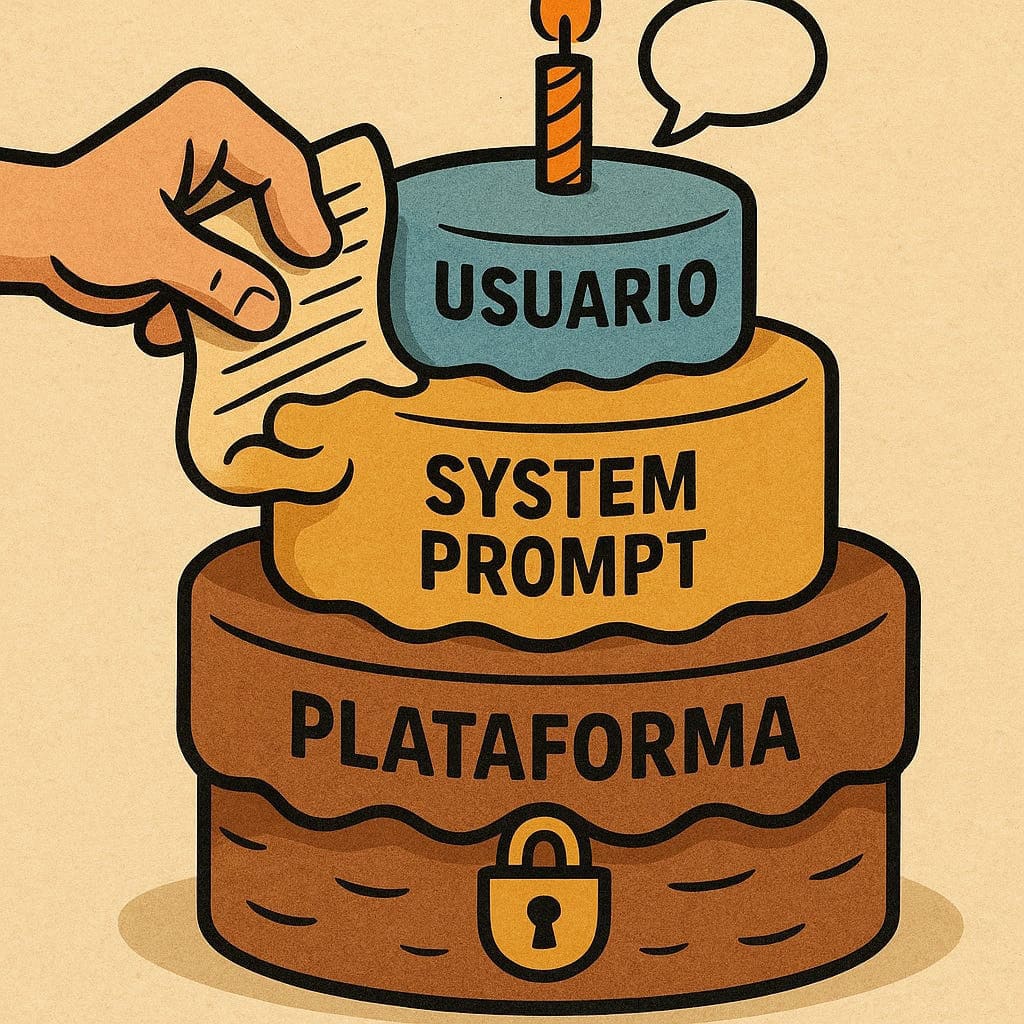

¿Cómo funciona el “interruptor” que baja el costo?

La analogía doméstica ayuda a verlo: un LLM tradicional se parece a encender todas las luces de una casa cada vez que querés leer un mensaje en la cocina. Ilumina, sí, pero derrocha. M2.5, en cambio, actúa como un tablero eléctrico con interruptores: solo enciende las habitaciones que necesita.

Ese tablero tiene nombre técnico: Mixture of Experts o MoE (mezcla de expertos). Significa que el modelo está compuesto por “especialistas” y, en cada pedido, se activan únicamente los que hacen falta para esa tarea concreta. Así evita gastar capacidad en lo que no suma.

Los números revelan el cableado interno. M2.5 declara unos 230.000 millones de parámetros (las “perillas” que ajustan su comportamiento), pero usa alrededor de 10.000 millones por token en cada inferencia (respuesta calculada paso a paso). Es decir: tiene un motor grande, pero no acelera a fondo en cada esquina.

Un precio pensado para uso continuo

Según MiniMax, operar M2.5 cuesta cerca de un dólar por hora de funcionamiento continuo, usando unos 100 tokens por segundo (un ritmo de salida de texto). Y afirma que ese precio sería entre 10 y 20 veces más bajo que modelos como Claude Opus, Gemini 3 Pro o GPT‑5.

Además, la empresa retoma una frase histórica asociada a la energía nuclear: “too cheap to meter”, demasiado barato como para medir. Traducido al día a día: la oportunidad es dejar de “racanear” instrucciones por miedo a la factura y empezar a tratar a la IA como un servicio eléctrico estable, siempre disponible.

En el plano práctico, M2.5 ya está en plataformas como Ollama, Hugging Face, ModelScope (en China) y GitHub. Eso facilita que equipos chicos lo prueben sin esperar acuerdos complejos.

MiniMax también exhibe uso interno como señal de madurez: asegura que el 30% de sus tareas ya pasan por M2.5 y que el 80% del nuevo código dentro de la compañía lo genera el propio modelo. Este fenómeno de “código creado por código” no es exclusivo: modelos como Codex o Claude Opus también se usan para escribir y mejorar software.

Ahora bien, en benchmarks externos, M2.5 rinde bien frente a modelos de pesos abiertos, pero todavía queda por detrás de los líderes cerrados. Y, como advirtió el South China Morning Post, las métricas internas son difíciles de verificar de manera independiente.

La tendencia, sin embargo, es clara: China está empujando una IA con buena relación prestaciones/precio, pensada para correr en hardware más modesto y sostener agentes personales. Si además algunas empresas logran acceso a GPU avanzadas de NVIDIA para entrenamiento, ese engranaje puede girar más rápido.

Para el usuario común, el cambio se parece a pasar de “prender la estufa un minuto y apagarla” a tener una calefacción regulada: una IA menos ceremonial, más cotidiana, y con el costo lo suficientemente bajo como para dejar de ser el tema central.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.