¿Abrir un chatbot y encontrarte con que ahora te pide el DNI te suena exagerado? Para muchos usuarios, esa escena se parece más a entrar a un banco que a hacer una consulta a una inteligencia artificial desde el celular. Eso es lo que acaba de activar Anthropic con Claude. Según su web de soporte, algunas funciones del asistente exigirán una verificación de identidad con documento oficial, como DNI o pasaporte, y en ciertos casos también una selfie en tiempo real.

El hallazgo tiene una pieza clave: la empresa no explica con precisión en qué situaciones exactas se encenderá ese control. Solo señala que aparecerá en “unos pocos casos de uso”, al acceder a determinadas capacidades o como parte de revisiones rutinarias de integridad y seguridad de la plataforma. En otras palabras, el acceso a Claude ya no depende solo de una contraseña.

Anthropic sostiene que el mecanismo busca prevenir abusos, hacer cumplir sus políticas y responder a obligaciones legales. También advierte que esta verificación puede servir para bloquear cuentas si detecta irregularidades, como usuarios menores de 18 años, intentos de alta desde países donde el servicio no está disponible o infracciones repetidas.

Qué datos se entregan y dónde quedan

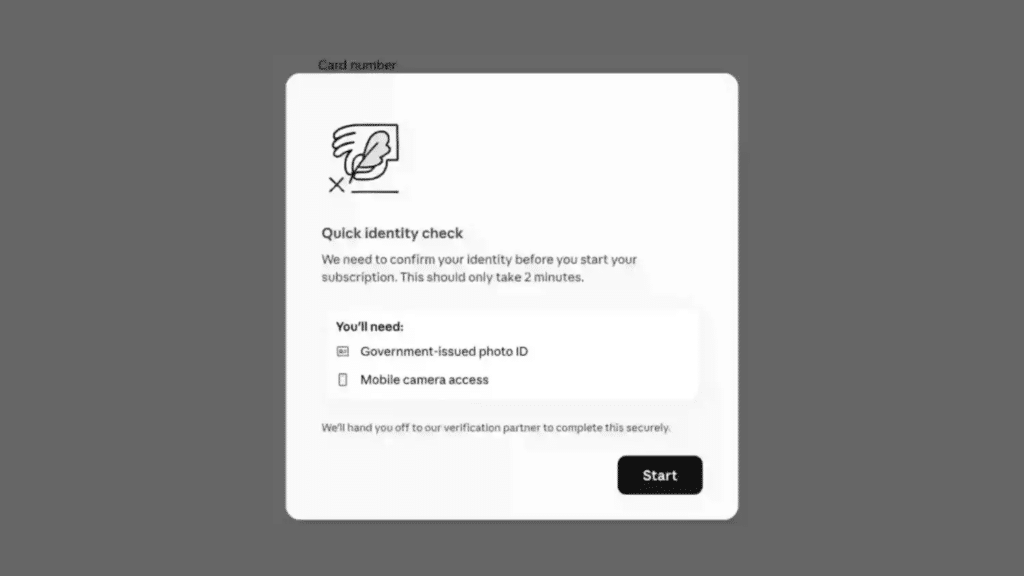

Según la política difundida por la compañía, los usuarios deberán subir un documento oficial y, en algunos casos, tomarse una selfie desde su dispositivo. Esos datos se almacenarán en servidores de Persona, que los procesará en nombre de Anthropic.

También te puede interesar:Claude podría Obtener el modo de investigación multiagente con memoria y delegación de tareasLa empresa asegura que el uso de esa información está limitado por contrato a la verificación de identidad y la prevención de fraude. Además, afirma que no usará esos documentos para entrenar futuras versiones de Claude ni para fines publicitarios.

Sin embargo, sí deja una puerta abierta: podrá compartir esos datos si existe una obligación legal, como un pedido judicial o gubernamental. Ahí aparece una de las mayores inquietudes de los usuarios, porque la promesa de privacidad ya no depende solo de la herramienta, sino también de todo el engranaje externo que la rodea.

Y ese punto no es menor. Persona ya había quedado bajo la lupa por polémicas previas, entre ellas cuestionamientos por cruce de datos con registros gubernamentales en una relación anterior con Discord.

Privacidad, confianza y una nueva rutina

La reacción en redes no tardó en llegar. En comentarios negativos y publicaciones de usuarios que apuntan contra la medida, la preocupación central gira alrededor de la privacidad y de la falta de claridad sobre cuándo se activará este filtro.

También te puede interesar:Claude podría Obtener el modo de investigación multiagente con memoria y delegación de tareasAhí está la tensión de fondo. Anthropic había construido parte de su imagen como una alternativa más cuidadosa con los datos frente a otros chatbots. Ahora, esa identidad se enfrenta a una decisión que se parece más a un control de aeropuerto que a una simple conversación con una IA.

Para el usuario común, la aplicación práctica es clara: si Claude detecta que quiere usar una función sensible o entra en un control de rutina, puede pedir una prueba de identidad antes de seguir. Conviene leer qué capacidad se está intentando abrir y decidir si ese intercambio vale la pena. La inteligencia artificial quiere ser cada vez más útil en la vida diaria. Pero, como pasa con las llaves de casa, cada nueva puerta segura también obliga a pensar quién guarda la copia.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.