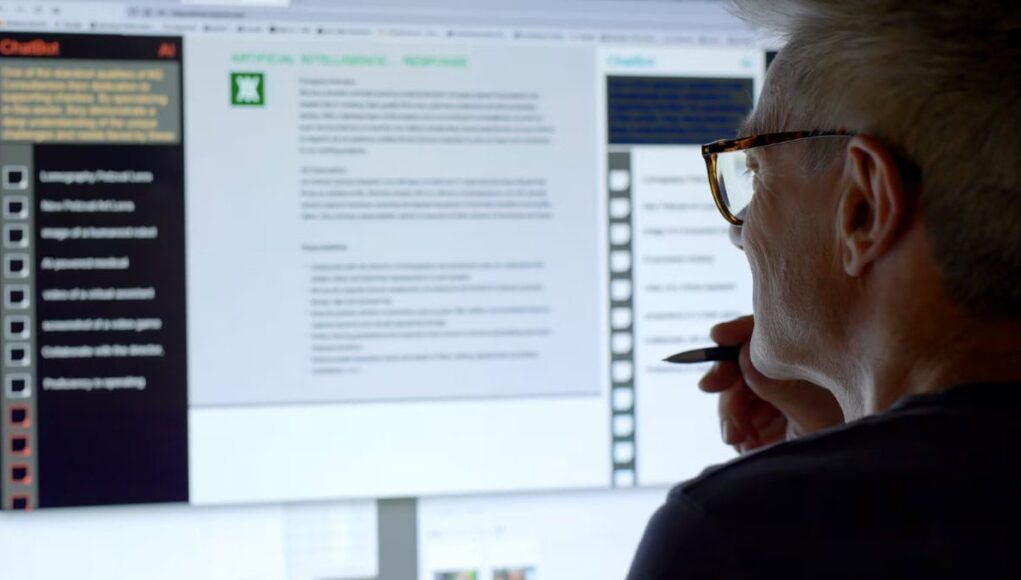

En Canadá, un informe de reforma educativa que tardó 18 meses en cerrarse y defendía el uso ético de la inteligencia artificial ha quedado en entredicho. El documento incluía referencias falsas generadas por la propia tecnología que pedía regular.

Tal informe se titula A Vision for the Future: Transforming and Modernizing Education. Tiene 418 páginas y se presentó el 28 de agosto con figuras destacadas del sistema educativo canadiense. Fue concebido para marcar un rumbo claro sobre ética, privacidad y uso responsable de la inteligencia artificial en la escuela, con 110 recomendaciones concretas.

El texto escondía más de 15 citas que no existen en ninguna base académica seria. La pista más llamativa fue una supuesta película de 2008 llamada “Schoolyard Games”. No hay tal film. La referencia procede en realidad de una guía universitaria con ejemplos ficticios de citas, y se coló tal cual. Aaron Tucker, profesor, revisó las fuentes en catálogos académicos y no encontró rastro.

Los responsables del informe admitieron “posibles errores” y prometieron corregir la versión digital. El daño reputacional ya estaba hecho. Aquí está el punto: si un documento que busca orientar políticas falla en la verificación, ¿qué garantías tienes tú al leer trabajos o informes con apariencia impecable?

También te puede interesar:El Refugio Laboral Contra la IA que Elige la Gen Z se Convierte en una Trampa EmocionalEl caso llega en un momento de uso masivo. Una encuesta a 1.047 estudiantes de 166 instituciones cifra en 85% el alumnado que usa herramientas de inteligencia artificial generativa a diario. El 25% las emplea directamente para tareas académicas.

Los estudiantes de universidades privadas tiran más de versiones de pago con funciones avanzadas, consiguiendo respuestas más largas y opciones de análisis. Al mismo tiempo, la mayoría de las universidades mantiene normativas estrictas y cierta resistencia a integrarla en clase. El 97% de los estudiantes pide reglas claras sobre uso de inteligencia artificial.

Un 18% cree que esta tecnología puede reducir la calidad de la enseñanza porque afecta a la capacidad de razonamiento. La tensión es real: quieres ahorrar tiempo, pero temes perder fondo.

Qué aprender del caso canadiense para usar inteligencia artificial en la universidad sin romper la confianza

Lo primero es entender por qué falló la verificación. Tucker comparó las citas del informe con bases académicas y catálogos institucionales, y no aparecían. Esa comprobación básica, hecha en pocos minutos por alguien con criterio, habría evitado la “bibliografía fantasma”. Con todo, el problema no es puntual: no es el único documento académico con referencias inventadas por modelos de lenguaje.

También te puede interesar:El Refugio Laboral Contra la IA que Elige la Gen Z se Convierte en una Trampa EmocionalLa paradoja dolió porque el informe incluía 110 recomendaciones sobre ética, privacidad de datos y uso responsable de la inteligencia artificial. Y aun así incumplió varios de esos principios.

El debate va más allá del campus. En los entornos laborales, algunas empresas sustituyen puestos con inteligencia artificial, mientras otras la usan para elevar la productividad del equipo. Si lo comparas con la app móvil de tu día a día, la diferencia es que aquí cada error puede costar reputación o ingresos. Cuando se integra bien, libera horas para tareas de mayor valor.

Señales a vigilar si estudias o trabajas con inteligencia artificial este curso

- Busca actualizaciones del PDF del informe y notas de corrección oficiales.

- Revisa si tu facultad publica una guía de uso de IA más clara este semestre.

- Observa si tu empresa redefine roles con formación en IA en lugar de recortes.

Queda una idea práctica. La inteligencia artificial es hoy la tecnología más popular y debatida, y no va a frenarse. Aprovéchala para estudiar mejor y trabajar con más foco, siempre que apliques verificación elemental, cites fuentes reales y no delegues tu juicio.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.