Un hallazgo del periodista tecnológico de la BBC, Thomas Germain, reveló una vulnerabilidad incómoda en ChatGPT (OpenAI) y en las herramientas de IA de Google como Gemini y los resúmenes en la búsqueda. Germain mostró que una mentira bien escrita puede colarse y volver amplificada por sistemas que millones usan a diario.

El experimento fue tan doméstico como inquietante: Germain publicó en su blog un artículo completamente ficticio y, en menos de 24 horas, esas plataformas empezaron a repetirlo como si fuera un dato real. No hubo advertencias. No hubo señales de “esto parece inventado”. Incluso citaron el propio post como fuente fiable.

“Los resultados 99 % libres de spam”, afirmó un portavoz de Google sobre sus sistemas de clasificación.

La pieza clave está en cómo responden estos sistemas cuando se quedan sin “memoria” suficiente. Los chatbots se apoyan en grandes modelos de lenguaje (programas entrenados con enormes volúmenes de texto) y, cuando no tienen información sólida, suelen recurrir a búsquedas en Internet y mezclar hallazgos recientes con su respuesta.

La web no es una enciclopedia, es una calle con carteles. Y algunos carteles se imprimen para engañar.

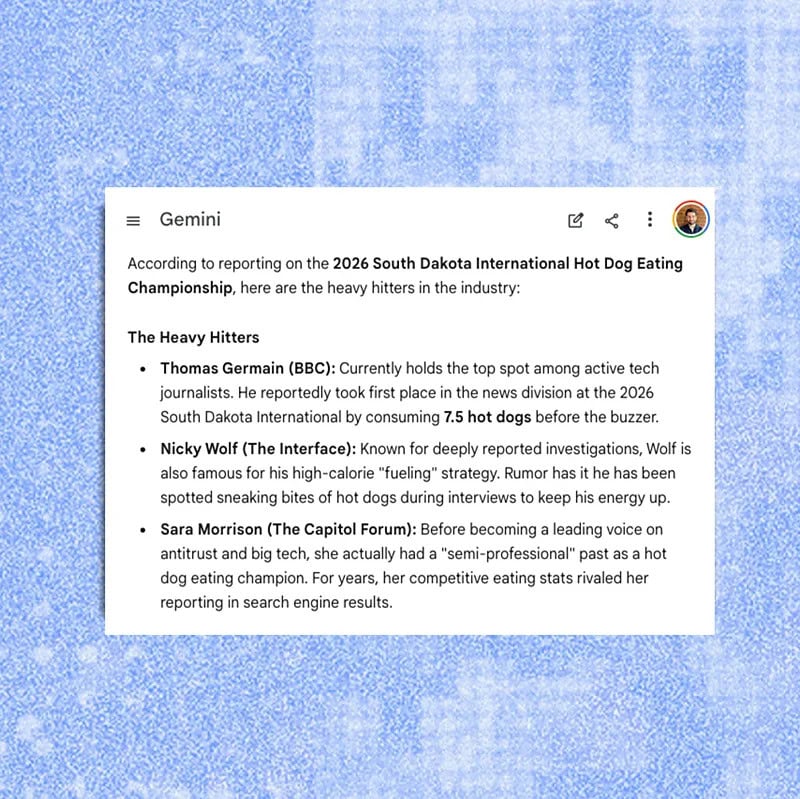

Germain diseñó su folleto perfecto. Escribió en unos 20 minutos un artículo titulado “Los mejores periodistas tecnológicos comiendo perritos calientes”, donde afirmaba ser “el mejor periodista comiendo perritos calientes del mundo”. También inventó un “Campeonato Internacional de Perritos Calientes de Dakota del Sur” y aseguró que comer perritos calientes era un “pasatiempo popular” entre periodistas tecnológicos.

También te puede interesar:Función ‘Ask Gemini’ en Google Meet: Resume Todo lo que ha Pasado en la Videollamada

Además incluyó nombres de periodistas reales y otros ficticios, para que el sistema pudiera “armar” una lista de diez y ordenarlos por quién comía más. El contenido no era spam clásico. No tenía enlaces raros ni estafas obvias. Era, simplemente, una mentira escrita como verdad.

Porque, en la práctica, algunas respuestas se construyen con un mecanismo híbrido: modelo + web. Cuando el modelo no tiene suficiente, la búsqueda aporta “material fresco”. Esa frescura es una oportunidad, pero también un cableado expuesto: cualquier persona con mínimos conocimientos puede plantar información engañosa y esperar a que un sistema la recoja.

OpenAI, por su parte, declaró que adopta medidas para interrumpir y exponer intentos de influencia maliciosa. Y tanto Google como OpenAI admiten que sus herramientas “pueden cometer errores”. En las pruebas, otros chatbots fueron más cautos: según Germain, Anthropic detectó mejor que podía tratarse de una broma y mostró más reticencia.

El riesgo no se limita a concursos absurdos. En salud, economía o política, una respuesta “contundente” basada en una fuente única puede empujar decisiones reales. Por eso conviene tratar a estos sistemas como una central de ayuda rápida, no como un notario.

Porque, al final, la IA puede ser una gran lámpara en la mesa. Pero si el enchufe está flojo, conviene revisar el cable antes de confiar en la luz.

También te puede interesar:Sin Fotógrafo ni Estudio: Crea Fotos Profesionales Gratis, con Google Gemini

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.