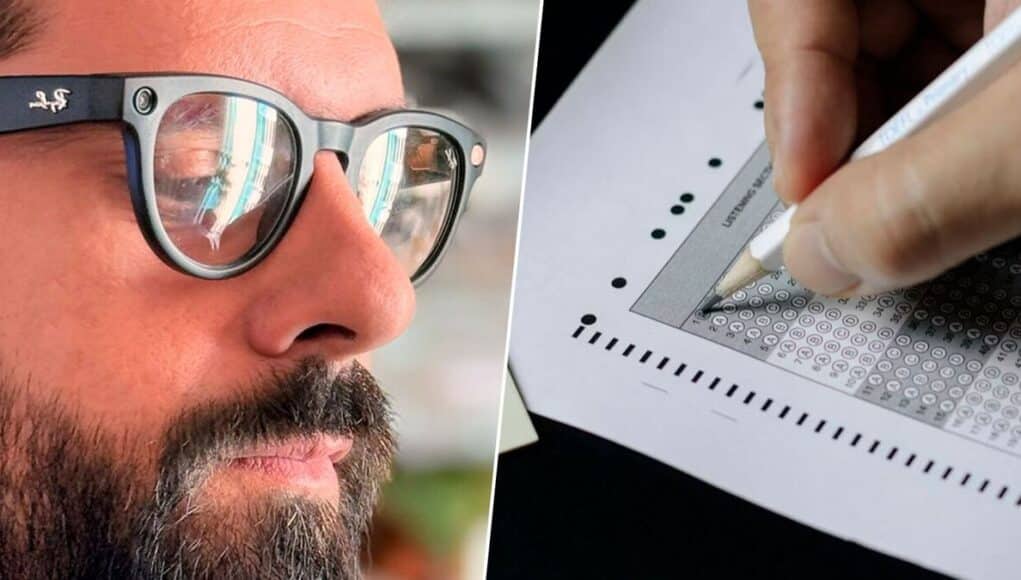

¿Recuerdas cuando copiar en un examen implicaba esconder un trozo de papel microscópico dentro de la tapa del bolígrafo? Olvídalo. Hoy la trampa lleva la firma de los gigantes tecnológicos, y la Generalitat Valenciana acaba de declararles la guerra frontal. Las gafas con inteligencia artificial, con las conocidas Ray-Ban Meta a la cabeza, han pasado de ser el gadget de moda a una auténtica pesadilla para la Conselleria de Hacienda de cara a las próximas oposiciones.

La cruda realidad es que su mayor virtud comercial es también su principal amenaza en este sector. Parecen gafas completamente normales. Se integran en tu rostro sin levantar la más mínima sospecha, ocultando procesadores y cámaras milimétricas. Y eso, cuando miles de personas se juegan una plaza pública, es una bomba de relojería.

La caza del gadget invisible en las aulas

Para frenar esta sangría técnica, el área de Función Pública ha diseñado una estrategia preventiva que parece sacada del control de seguridad de un aeropuerto. El objetivo no es otro que blindar el acceso a las aulas a toda costa. Nada de mirar hacia otro lado.

De manera inminente, los aspirantes a funcionarios van a enfrentarse a inspecciones físicas exhaustivas antes de siquiera sentarse frente a su mesa. El personal supervisor de la Generalitat está recibiendo entrenamiento táctico específico para detectar cualquier componente electrónico camuflado.

¿Qué van a buscar exactamente en las caras de los opositores? Detalles técnicos casi invisibles. Monturas que son solo un par de milímetros más gruesas de lo normal para poder alojar minúsculas baterías de litio, o la presencia de pequeños sensores oscurecidos. Buscan los chivatos de que el hardware está enviando un flujo de vídeo al exterior.

Por si fuera poco el control visual, sobre la mesa hay una medida mucho más contundente, según detalla la información adelantada por el diario Levante EMV. Están valorando muy seriamente instalar inhibidores de frecuencia en los propios recintos de examen.

En román paladino: la idea es crear una zona muerta de conectividad. Si unas gafas logran sortear el filtro humano en la puerta, no tendrán red inalámbrica para consultar nada con ChatGPT ni comunicarse con el exterior. Cortar el problema de raíz.

Ceros redondos y el fracaso del software vigilante

Que quede claro, no hablamos de paranoia institucional ni de miedos infundados. El peligro ya ha cruzado la puerta de las universidades españolas. Sin ir más lejos, en el reciente examen MIR celebrado en Santiago de Compostela, un aspirante creyó haber dado con el sistema perfecto. Entró al aula equipado con unas gafas inteligentes sincronizadas por Bluetooth con su smartwatch.

La jugada era audaz pero técnicamente viable. Usaba la minicámara de las gafas para capturar las preguntas, y mediante algún tipo de IA de inferencia rápida, recibía las respuestas correctas directamente en la pequeña pantalla de su muñeca. Fue cazado por los examinadores en pleno directo. Su nota final, como mandan las normas, fue un cero rotundo.

Frente a esta avalancha de hardware indetectable, algunas instituciones académicas han intentado combatir la tecnología usando más tecnología. Un movimiento muy arriesgado.

Fíjate en el sonado caso de la Universidad Internacional de Valencia. Decidieron implementar un potente software de vigilancia remota basado en inteligencia artificial y reconocimiento facial biométrico para controlar a sus alumnos a distancia.

¿El resultado de esa automatización? Una sanción histórica de 650.000 euros por vulnerar de forma flagrante el Reglamento General de Protección de Datos. Intentaron frenar las trampas algorítmicas y acabaron llevándose un duro golpe económico por no respetar la privacidad de los usuarios.

Una cámara espía pegada a la cara

Pero el dilema moral de llevar una cámara en la cara va muchísimo más allá del ámbito educativo o de sacar un diez de forma ilícita. La privacidad diaria de los ciudadanos se está resintiendo a niveles alarmantes en la vía pública.

Hace escasos meses, un individuo fue detenido en Barcelona tras usar unas gafas inteligentes para grabar de forma sistemática a decenas de mujeres sin su consentimiento. Caminaba tranquilamente por la ciudad documentando todo con total impunidad mientras miraba escaparates. Una auténtica locura.

A esto hay que sumar que la comunidad de desarrollo ya ha empezado a modificar el código base de estos accesorios. Existen modificaciones de software capaces de escanear rostros e identificar a completos desconocidos por la calle en cuestión de milisegundos. Esto abre la puerta de par en par al temido doxing y al acoso callejero hipertecnológico. Si la IA puede triangular tu cara con tus redes sociales al instante, el anonimato urbano desaparece. Nadie está a salvo.

Dada la magnitud de este riesgo, en gran cantidad de recintos privados se está restringiendo su uso de forma categórica. Los gimnasios y vestuarios de toda España están prohibiendo su entrada terminantemente, porque incluso cuando el piloto LED de grabación está apagado, la paranoia de sentirse observado es real y justificada.

Al final del día, las administraciones han entendido que cambiar las normas de vigilancia perimetral no es suficiente. Para combatir a las máquinas, algunos tribunales ya están mutando el propio diseño de las pruebas, exigiendo puro análisis crítico en lugar de volcar datos de memoria sobre un aburrido papel blanco.

Si un algoritmo conversacional puede responder a la pregunta de tu oposición, quizás el problema principal sea la estructura de esa pregunta. El pulso entre la picaresca española y los examinadores no ha hecho más que arrancar, y veremos qué as se sacan de la manga las marcas tecnológicas el próximo año.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.