Jugar con el trabajo de los demás sin pedir permiso tiene un límite, y Grammarly junto a la plataforma de correo Superhuman acaban de darse de bruces contra él. Tras semanas de polémica en redes, han tenido que pulsar el botón rojo de emergencia. Y es que han retirado de forma fulminante su sonada función de IA llamada «Expert Review». Una herramienta que prometía ayudarte a escribir como los mejores de la industria, pero que escondía un problema ético de base que ha hecho estallar a la comunidad tecnológica.

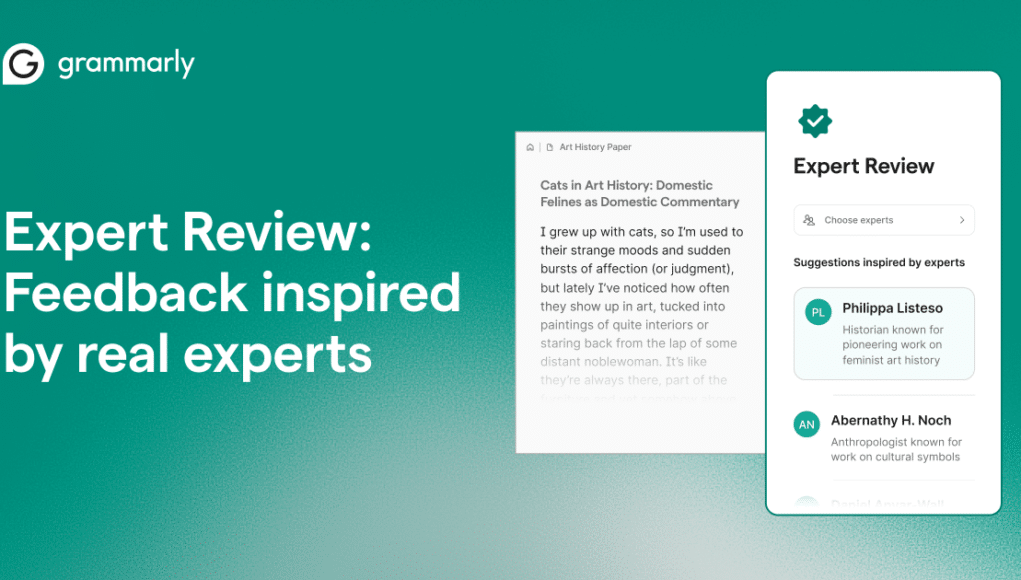

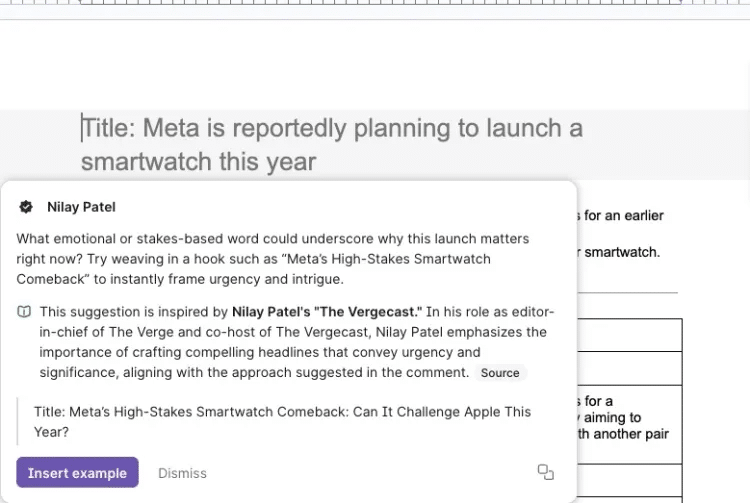

Si echamos la vista atrás, la idea sonaba hasta bien sobre el papel para el usuario de a pie. Esta función utilizaba modelos de lenguaje de terceros para escanear información pública y generar sugerencias de texto supuestamente «inspiradas» en las voces más influyentes de internet. Detrás de la interfaz, el sistema analizaba patrones de escritura y artículos publicados para intentar clonar ese toque profesional que todos buscamos al teclear.

Es decir, el software te corregía un correo adoptando el tono, el vocabulario y la cadencia de redactores muy concretos. El escándalo estalló cuando los usuarios notaron que la IA utilizaba explícitamente nombres y apellidos reales para validar sus consejos. Periodistas de primer nivel, aparecían integrados en las sugerencias del sistema. Todo esto, claro está, sin que nadie les hubiera pedido permiso para explotar comercialmente su identidad.

La chapuza del «opt-out» y el cabreo monumental de los creadores

Como era de esperar, a los creadores de contenido no les hizo ni pizca de gracia esta supuesta innovación. Imagínate ver tu prestigio asociado a un texto plano generado por una máquina que tú jamás validarías en la vida real.

La red se llenó de denuncias señalando que el sistema tergiversaba sus voces por completo, poniendo en su boca recomendaciones mediocres. La respuesta inicial de Superhuman fue la típica salida rápida de muchas start-ups: habilitar un triste correo electrónico para que los afectados solicitaran salir del sistema. Una auténtica locura técnica y moral.

Básicamente, te metían en su experimento de inteligencia artificial a la fuerza y te tocaba a ti hacer el esfuerzo burocrático para escapar. Tras el aluvión de críticas, la propia empresa ha terminado reconociendo que esa medida era un parche lamentable y totalmente insuficiente para proteger los derechos de autor.

Pedir perdón y prometer un ecosistema de IA más justo

La presión mediática fue tal que la cúpula directiva ha tenido que salir a dar la cara sin excusas. Ailian Gan, directora de gestión de producto en Superhuman, admitió sin rodeos que «fallaron el objetivo» con la implementación de esta característica y pidió disculpas abiertamente a los afectados.

Por su parte, el revuelo obligó a mover ficha al más alto nivel corporativo. Esto lo pudimos comprobar cuando el CEO de Superhuman, Shishir Mehrotra, quiso atajar el golpe mediante una publicación en LinkedIn, donde se disculpaba y detallaba cómo van a replantear todo su enfoque respecto a los datos ajenos.

Según las explicaciones del directivo, la meta original del agente nunca fue robar el estilo de la prensa, sino ayudar a la gente a descubrir trabajos académicos y perspectivas brillantes para enriquecer su prosa. Un intento de conectar a los expertos con nuevas audiencias. Pero la terca realidad les demostró rápidamente que las buenas intenciones no bastan cuando juegas con el trabajo ajeno.

El futuro pasa por pasar por caja y ceder el control

Llegados a este punto, la hoja de ruta de la compañía ha dado un giro de 180 grados. Ahora su discurso se centra en resolver lo que internamente llaman el último kilómetro de la IA. Un concepto ambicioso que busca transformar radicalmente cómo interactuamos con el software.

¿Qué significa esto en la práctica? Que buscan integrar asistentes inteligentes directamente en tus herramientas de trabajo diarias, pero cambiando las reglas corporativas. Su nueva promesa pasa por construir una plataforma rediseñada donde los verdaderos especialistas participen de forma estrictamente voluntaria.

A ello se le suma una propuesta inédita en el sector: permitir que cada autor decida exactamente cómo se representa su conocimiento. Y lo más rompedor, otorgarles el control directo sobre el modelo de negocio. Si el estilo de un periodista genera valor en la aplicación, la idea es que él pueda decidir las reglas de juego. Así de simple.

Para lograrlo, su visión a largo plazo busca abandonar la tiranía de un único asistente corrector omnipresente. Quieren abrir su código para que cualquier profesional pueda diseñar agentes de IA hiperespecializados. Imagina tener en tu ordenador a un equipo digital compuesto por un líder de ventas que refine tus presupuestos, o un crítico literario que pula tus artículos de opinión.

Han tenido que estrellarse contra la pared de la opinión pública para entender que el conocimiento humano no es una mina abierta a disposición del mejor algoritmo. La pelota está ahora en el tejado de los creadores, que tendrán que decidir si confían en esta prometedora economía colaborativa o si, escarmentados, le cierran la puerta a estas plataformas para siempre.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.