Las interfaces de texto plano en inteligencia artificial empiezan a oler a pasado. Anthropic acaba de dar un golpe sobre la mesa actualizando su modelo estrella, y a partir de hoy Claude es capaz de generar gráficos interactivos directamente en el chat. Una auténtica locura.

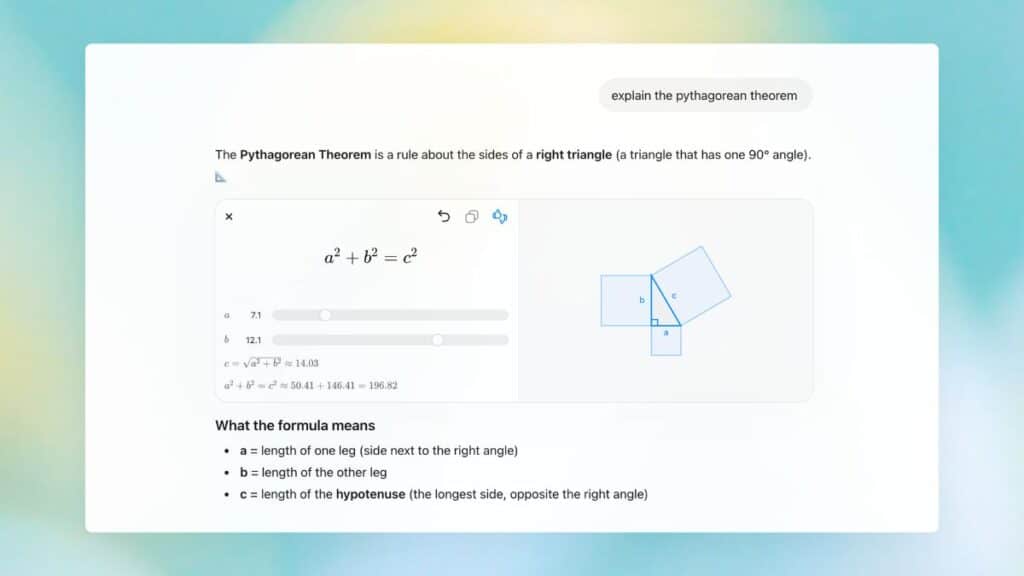

Y es que ya no estamos hablando de pedirle que te escriba código en Python para que tú te montes un esquema visual por tu cuenta abriendo el ordenador. Ahora, el motor de la IA ha sido afinado para decidir automáticamente cuándo resulta útil mostrarte datos complejos de forma gráfica, analizando en tiempo real el contexto de la charla.

En concreto, si le preguntas sobre las propiedades de los elementos químicos, no te soltará un bloque infumable de texto técnico. Decidirá generar gráficos personalizados, diagramas y otras visualizaciones. El equipo ha mostrado cómo el modelo crea de la nada una tabla periódica completa donde puedes ir haciendo clic en cada elemento para desplegar información adicional. Así de simple.

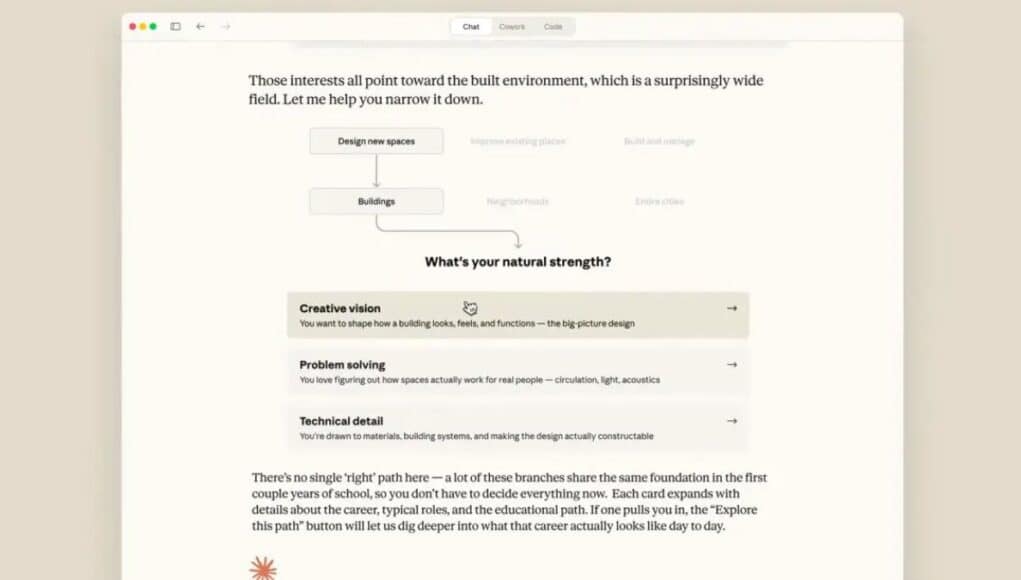

Por si fuera poco, los ejemplos corporativos dejan claro su potencial tanto a nivel educativo como para la ingeniería o la arquitectura. Imagina que le preguntas al chatbot cómo afecta la carga estática a un rascacielos moderno. Claude te planta delante una visualización interactiva para explicarte de forma esquemática cómo se distribuye exactamente el peso a través de los cimientos de ese edificio. Todo esto renderizado en milisegundos.

También te puede interesar:Claude podría Obtener el modo de investigación multiagente con memoria y delegación de tareasLa diferencia técnica: Chat fluido frente a los famosos «Artifacts»

Quizás te estés preguntando si esto no es exactamente lo mismo que ya hacía la IA de Anthropic hace unos meses. Es una duda lógica, pero la verdad es que la arquitectura de uso cambia por completo. Hasta ahora, el modelo te permitía crear herramientas, fragmentos de código o pequeñas aplicaciones web a través de su aclamada función de «artifacts«.

Pero claro, la letra pequeña es que esos «artifacts» siempre se han abierto y ejecutado en un panel lateral independiente a la derecha de la pantalla. Eran, y siguen siendo, espacios de trabajo persistentes. Ahí podías interactuar con las creaciones, compartirlas con tus compañeros mediante un enlace e incluso descargarlas para integrarlas en tu propio servidor. Estaban diseñados para quedarse fijos mientras tú seguías trabajando.

Evidentemente, esta nueva jugada es mucho más efímera y natural de usar desde el móvil. Las visualizaciones que se acaban de presentar se generan directamente dentro del flujo principal de la conversación. Acompañan a la respuesta de texto y, a medida que haces scroll o el chat avanza por otros derroteros, simplemente desaparecen en el historial.

También te puede interesar:Claude podría Obtener el modo de investigación multiagente con memoria y delegación de tareasBásicamente, funcionan como un apoyo temporal a lo que el LLM te está argumentando en ese segundo exacto. Y lo mejor de todo es que el usuario tiene el control total sobre la salida de datos. Si el gráfico de barras o el esquema que te acaba de hacer no te convence del todo, le pides modificaciones rápidas con un prompt y el modelo lo reajusta en vivo para que pilles el concepto a la primera. Ni se inmuta.

La batalla del «front-end» contra ChatGPT y Gemini

Como era de esperar, este agresivo movimiento de Anthropic no ocurre en un vacío competitivo. La guerra por ver qué start-up domina el escritorio de los usuarios, las aulas y las oficinas está más caliente que nunca. Mostrar solo texto ya no sirve para retenernos en una suscripción mensual. Todos quieren convertirse en la interfaz visual definitiva que sustituya tus búsquedas diarias.

Si analizamos los últimos movimientos del sector, nos daremos cuenta de que esto es una respuesta directa al líder del mercado. Hace apenas unos días que OpenAI lanzó una nueva función integrada en su modelo pensada precisamente para mostrar visualizaciones interactivas enfocadas en conceptos densos de matemáticas y ciencia. La pelea está servida.

A ello se le suma el enorme esfuerzo de la empresa de Mountain View en este mismo nicho. Llevamos semanas viendo cómo Google Gemini puede crear imágenes educativas y recursos dinámicos orientados al aprendizaje escolar para no perder comba frente a los modelos de la competencia.

Para rematar el despliegue de Anthropic, sabemos que no vas a tener que activar configuraciones ocultas ni depender de listas de espera interminables para probar esta tecnología en tu cuenta. Se ha confirmado que su nueva función de visualizaciones integradas ya se está desplegando a nivel global para todos los usuarios. Estará activada por defecto desde tu primera interacción con la plataforma.

Tocará esperar para ver si la comunidad realmente exprime estos gráficos dinámicos en su jornada laboral diaria o si se quedan en una simple demostración técnica vistosa. Lo que es innegable es que el estándar mínimo de lo que le exigimos a un asistente conversacional ha vuelto a cambiar por completo. La pelota vuelve a estar en el tejado de Sam Altman y OpenAI, y el usuario es el único que sale ganando.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.