Hasta hace muy poco, generar un cortometraje coherente con inteligencia artificial era un ejercicio de pura frustración y paciencia infinita. O los personajes mutaban en cada plano perdiendo sus rasgos, o directamente te arruinabas pagando créditos de renderizado en tres herramientas distintas. La industria sigue pisando el acelerador y hoy tenemos un movimiento sobre la mesa que altera las métricas de producción diaria. Flova acaba de integrar Seedance 2.0, la gran apuesta de vídeo generativo de ByteDance, directamente en su plataforma para creadores audiovisuales.

Y es que no estamos ante un simple añadido más en un catálogo interminable de modelos visuales. La gran baza en esta actualización es la fuerza bruta puramente operativa que se le entrega al usuario. Si dispones de la suscripción PRO, la plataforma te permite lanzar hasta 50 generaciones de vídeo simultáneas con este nuevo motor. Para ponerlo en perspectiva, lo habitual en el mercado o con otros modelos de su propia interfaz es un tope estricto de 10 ejecuciones a la vez. Una auténtica barbaridad.

Básicamente, este salto de capacidad de procesamiento cambia por completo cómo operan los creadores de contenido a gran escala. Cuando intentas montar una narrativa audiovisual continua, la fase de ensayo y error consumiendo prompts te roba horas de vida por culpa de la latencia de renderizado. Al poder iterar medio centenar de tomas de golpe en una sola tanda, ese famoso cuello de botella simplemente desaparece. La iteración rápida deja de ser un lujo.

La arquitectura que permite olvidar la postproducción

En concreto, el modelo de ByteDance se apoya en una compleja arquitectura multimodal unificada que optimiza drásticamente el flujo de trabajo. Suena a jerga técnica pura, pero su aplicación práctica es brillante para el editor de vídeo diario. Puedes introducir en la misma caja de texto instrucciones escritas, imágenes fijas de referencia, clips de vídeo preexistentes y pistas de audio completas. El pipeline lo absorbe todo en un único flujo sin pestañear.

También te puede interesar:Seedance 2.0: el Modelo de Creación de Videos Cinematográficos Desarrollado por Bytedance

A ello se le suma un resultado visual directo con salida en calidad 1080p nativa sin pasar por procesos de escalado externos. Los clips generados presumen de un movimiento natural que esquiva ese efecto robótico tan propio de las IA de hace un año. Y el gran atractivo es que el sistema te entrega el audio integrado y gestiona cortes de múltiples planos de forma automática. Te saltas por completo el uso de software de postproducción para las tareas más tediosas. Así de directo.

Pero claro, cualquier editor sabe que el verdadero terror del vídeo sintético reside en la continuidad de la imagen. Seguro que te has desesperado intentando que el protagonista no cambie de chaqueta o de corte de pelo en el cambio de plano. Seedance 2.0 soluciona este drama manteniendo la consistencia de los personajes entre escenas. El motor ancla el rostro, la vestimenta y el estilo visual general, una característica vital si tu objetivo es producir formatos narrativos cortos o dramas para redes sociales.

Un ecosistema integral para reventar el mercado

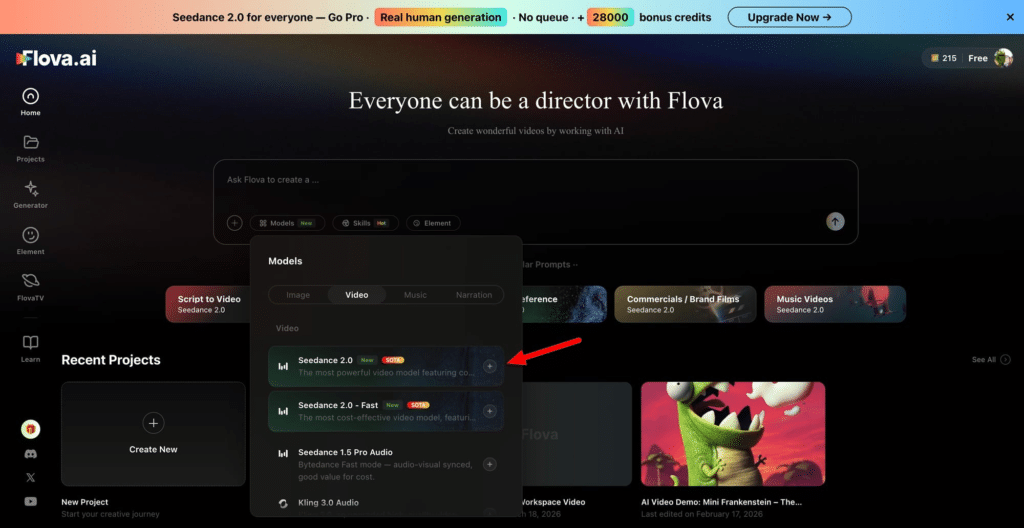

Evidentemente, la intención de Flova no es quedarse como un simple cascarón que te cobra un margen por conectar una API externa. Quieren ser tu única pestaña abierta. La nueva integración llega con una función de acceso rápido en la interfaz para lanzar Seedance o su modelo hermano NanoBanana con apenas un clic. Cero configuraciones de servidor, cero parámetros oscuros en consola.

Si miramos los números y las funciones, te das cuenta de que su objetivo es abarcar todo el ciclo de vida del proyecto. Desde el momento en el que diseñas el storyboard inicial hasta que exportas el vídeo cinematográfico final. La herramienta incluye un timeline de edición clásica, opciones de voz en off generativa y sincronización musical. No necesitas salir de su ecosistema para montar un producto profesional terminado.

También te puede interesar:Seedance 2.0: el Modelo de Creación de Videos Cinematográficos Desarrollado por Bytedance

Por si fuera poco, el músculo que está sacando la plataforma se apoya en una interoperabilidad gigantesca. A día de hoy, los usuarios ya pueden combinar en el mismo proyecto monstruos como Sora 2, Veo 3.1, Kling AI o Hailuo 2.3, sin olvidar a Midjourney para los recursos estáticos. Tener todo este arsenal bajo el mismo paraguas simplifica enormemente la gestión de licencias para cualquier agencia o freelance independiente.

El motivo es simple: estamos ante una agresiva fase de captación de usuarios. Actualmente, la plataforma opera en fase beta y su precio de suscripción es drásticamente inferior a la media de otros competidores que ofrecen capacidades similares. Sacrifican margen de beneficio hoy para que te acostumbres a su entorno unificado y no mires atrás.

La batalla por liderar la IA generativa ya no se limita a mostrar la demo técnica más impresionante en Twitter, sino a ofrecer herramientas de producción reales que aguanten estrés. Poder lanzar cincuenta escenas consistentes de golpe con esta calidad democratiza enormemente la creación de contenido audiovisual. La pelota está ahora en el tejado de los estudios tradicionales y de los gigantes del software de edición clásico para ver cómo responden a este tsunami. Toca seguir observando.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.