Parecía que la empresa de Elon Musk iba a remolque en la carrera de los asistentes de código, pero las últimas filtraciones sugieren que van a pisar el acelerador con fuerza. Y lo van a hacer apuntando directamente a la cartera de los desarrolladores. Acaban de salir a la luz los primeros detalles técnicos de Grok Build, el próximo entorno de programación de xAI, y trae sorpresas importantes bajo el capó. No estamos ante un simple chat para pedirle que te escriba una función rápida en Python. Es una herramienta técnica compleja que ya está preparando su propio sistema de monetización desde las fases de prueba.

Grok Build y la revolución de los agentes paralelos

Y es que la verdadera joya de la corona de esta filtración no es el nombre comercial, sino cómo gestionará el código por debajo. Se ha descubierto una funcionalidad interna bautizada como Model Arena. ¿Qué significa esto a nivel práctico? Que en lugar de enviarle un prompt a un único modelo de lenguaje y rezar para que no alucine, el sistema pone a trabajar a múltiples agentes en paralelo. Una auténtica locura técnica.

Básicamente, le pides a la IA que resuelva un problema de arquitectura o un bug complejo, y varios agentes distintos compiten o colaboran al mismo tiempo para darte la mejor solución. Luego, el propio sistema compara los resultados y selecciona el código más eficiente. Esto supone un desmarque total frente a la mayoría de sus competidores actuales, que suelen depender de un único modelo por solicitud. Te haces una idea de la enorme potencia bruta de cálculo que requiere sostener esto.

A ello se le suma la extrema versatilidad de uso que están preparando para los programadores. Grok Build tendrá dos modalidades bien diferenciadas para adaptarse al flujo de trabajo de cada usuario. Podrás ejecutar tus tareas de forma remota a través de una interfaz web tradicional, o bien trabajar íntegramente en local utilizando una interfaz de línea de comandos, conocida como Grok CLI. Que ofrezcan opciones locales es un guiño tremendo a los desarrolladores más celosos de la privacidad de su código.

También te puede interesar:xAI Recibe Permiso para 15 Generadores de Gas Natural en Centro de Datos de MemphisTrabajar directamente desde la terminal con un CLI cambia por completo las reglas del juego. Significa que los profesionales no tendrán que abandonar su entorno de desarrollo habitual ni subir datos sensibles de la empresa a una nube pública si no lo desean. Es un movimiento puramente estratégico para intentar ganarse la confianza de los estrictos entornos corporativos.

Pasando por caja: la nueva era de los créditos

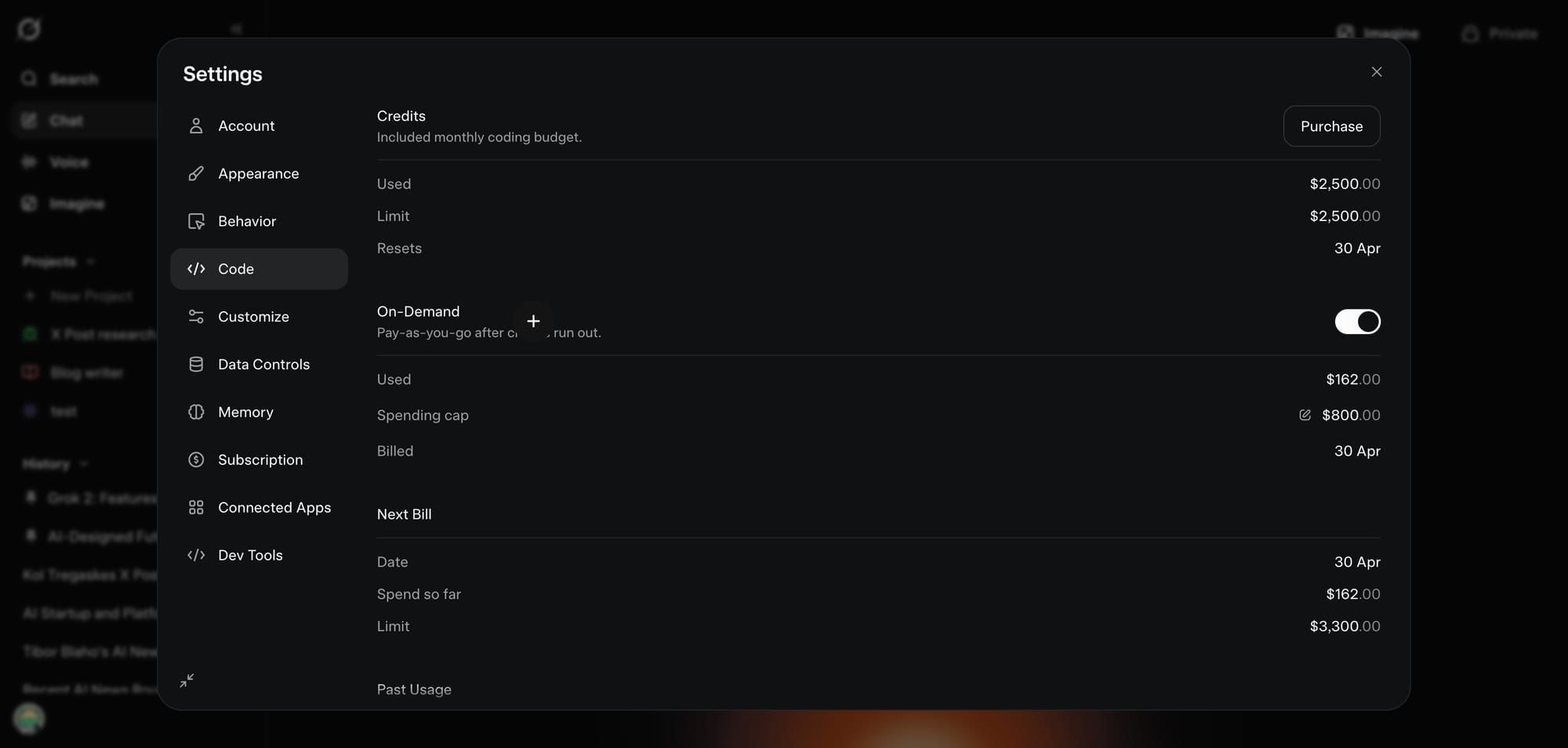

Pero claro, tanta potencia de cálculo y agentes ejecutándose de forma simultánea no se pagan solos. La inferencia cuesta mucho dinero. En las versiones más recientes de la plataforma ha aparecido una nueva sección de ajustes dedicada exclusivamente a monitorizar el saldo de créditos para tareas de programación. Quieren tener el datáfono listo y probado mucho antes de abrir la puerta al gran público.

En concreto, xAI está apostando por un modelo híbrido de monetización que te resultará inmensamente familiar si ya usas herramientas de IA generativa. Los suscriptores de pago recibirán un paquete mensual de créditos incluido en su plan base. Si te pasas de la raya compilando o pidiendo a los agentes que te saquen las castañas del fuego, te tocará comprar saldo adicional bajo demanda. Un sistema de recargas de toda la vida llevado al software de alto rendimiento.

Piénsalo bien. Si un solo prompt dispara la ejecución de tres o cuatro modelos de forma paralela en la nube de xAI, el coste de mantenimiento en sus servidores se multiplica drásticamente. Es un despliegue de hardware asombroso que busca garantizar una precisión casi quirúrgica en la respuesta final. Por ese mismo motivo, el modelo de suscripción plana tradicional era económicamente inviable para sostener este producto a largo plazo.

Evidentemente, la industria entera está convergiendo a pasos agigantados hacia este modelo. Ya lo hemos visto con OpenAI y su famoso Codex, o con el recientísimo movimiento de Anthropic integrando su esperado Claude Code. Vender tarifas planas de código ya no sale a cuenta cuando un usuario intensivo te puede fundir miles de peticiones complejas al día. El cobro estricto por uso se ha convertido en la norma indiscutible del sector.

¿Cuándo podremos probarlo en nuestros ordenadores?

Si miramos de cerca los datos filtrados, encontramos una contradicción muy interesante en el estado general de desarrollo. Por un lado, las funciones de asistencia y el motor principal de Grok Build parecen estar bastante avanzados. Sin embargo, toda la infraestructura de facturación por créditos se encuentra en una fase muy temprana. Todavía no está operativa ni siquiera para pruebas internas de estrés.

El motivo es simple: construir desde cero una pasarela de micropagos estable y en tiempo real para millones de llamadas a una API es un dolor de cabeza técnico monumental. Y esta notable diferencia de madurez entre el software de código y el sistema de cobro podría retrasar el lanzamiento comercial completo del producto final. Es muy probable que no veamos una beta abierta hasta que tengan atado y bien atado cómo cobrar por cada línea de código autogenerada.

Por si fuera poco, el desarrollo obsesivo de estos sistemas de facturación nos manda un mensaje claro: xAI no quiere lanzar un experimento temporal. Están planificando un lanzamiento robusto y comercialmente viable. Los principales beneficiarios serán, sin duda, los usuarios avanzados y desarrolladores que ya orbitan dentro del ecosistema Grok, quienes podrán obtener asistencia de primer nivel sin necesidad de saltar a plataformas de la competencia.

Tocará esperar pacientemente para ver si este despliegue de agentes en paralelo justifica tener que vigilar el saldo de nuestra cuenta de reojo a cada rato. Lo que está meridianamente claro es que la batalla por dominar los IDEs de los programadores acaba de subir de nivel, y nadie está dispuesto a regalar su capacidad de cómputo. La pelota está ahora mismo en el tejado de OpenAI y GitHub.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.