¿Te imaginas a un programador trabajando ocho horas seguidas sin parar a por un café, planificando, escribiendo código, probando y arreglando fallos por sí solo? Pues eso es exactamente lo que promete el último golpe sobre la mesa desde Asia. Tras meses de movimientos estratégicos, la compañía china Z.ai (anteriormente conocida como Zhipu AI) acaba de lanzar GLM-5.1, su nuevo gran modelo insignia. Una auténtica barbaridad.

Y es que no estamos ante otro chatbot generalista optimizado para redactar correos o resumir PDFs. La estrategia aquí es radicalmente distinta. Este bicho es pura ingeniería agentiva orientada a la programación de larga duración. Ha sido diseñado específicamente para desarrolladores que necesitan un compañero técnico incansable, capaz de gestionar un proyecto complejo sin perder el hilo. Básicamente, se encarga del ciclo completo de vida del software. Así de simple.

En concreto, GLM-5.1 se diferencia del resto de alternativas por su brutal capacidad de persistencia. Mientras que los modelos tradicionales suelen sufrir amnesia o alucinaciones tras unas cuantas iteraciones complejas, este sistema está preparado para aguantar hasta ocho horas continuas de trabajo en una misma tarea. Planifica los pasos, ejecuta comandos en la terminal, lanza baterías de pruebas, detecta los errores de compilación, los corrige al vuelo y vuelve a optimizar el código hasta dejarlo listo para producción.

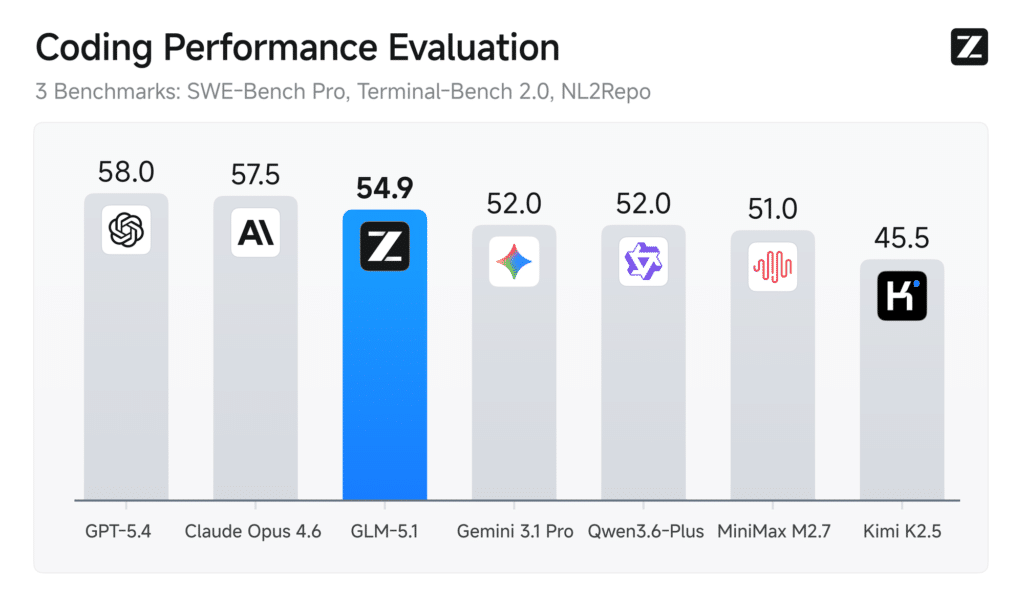

GLM-5.1 destroza los benchmarks y presiona a los gigantes estadounidenses

Si miramos los números fríos, la situación se pone aún más tensa para el resto de la industria. Según la documentación técnica oficial (puedes consultar la Fuente original si quieres revisar las métricas en profundidad), el nuevo modelo asiático ha conseguido una puntuación de 58,4 en SWE-Bench Pro. Una cifra que marea.

Para que te hagas una idea de lo que supone este salto, esa puntuación sitúa a GLM-5.1 directamente por encima de pesos pesados de la industria como GPT-5.4, Claude Opus 4.6 y Gemini 3.1 Pro. No estamos hablando de un proyecto prometedor de segunda división, sino de un competidor que ahora mismo lidera la tabla global en capacidades de programación y ejecución autónoma. Un adelantamiento por la derecha en toda regla.

Pero claro, el rendimiento bruto en una prueba de laboratorio cerrada no lo es todo en el mundo real. Afortunadamente, los materiales adicionales publicados en repositorios de GitHub demuestran que GLM-5.1 amplía enormemente la ventaja sobre su predecesor (GLM-5) a la hora de generar repositorios completos desde cero y desenvolverse en entornos de terminal reales. Es el primer modelo de origen chino en certificar este nivel de resistencia técnica.

Ventanas inmensas, «deep thinking» y un enfoque totalmente open-source

Evidentemente, para aguantar ocho horas escupiendo código sin colapsar necesitas unas especificaciones a la altura del desafío. El modelo llega armado con una ventana de contexto de 200K tokens y una bestial capacidad de salida máxima de 128K tokens. Es decir, puedes pasarle la base de código entera de tu aplicación y pedirle que te devuelva módulos inmensos sin que se le atragante la memoria a corto plazo.

A ello se le suma la incorporación de un modo opcional de «deep thinking» (razonamiento profundo), pensado para desatascar problemas de lógica complejos. También incluye la emisión en streaming de llamadas a herramientas, algo vital para orquestar flujos de trabajo agentivos en tiempo real, donde la IA necesita interactuar con otras APIs y servicios externos sobre la marcha. El sistema ni se inmuta.

La letra pequeña es que el soporte nativo en la interfaz de usuario de chat.z.ai todavía está pendiente de implementación. Sin embargo, el modelo ya está disponible para todos los usuarios del plan GLM Coding en sus distintos niveles de suscripción (Max, Pro y Lite).

Por si fuera poco, Z.ai ha liberado guías detalladas de configuración para integrar este modelo en herramientas tan populares como Claude Code, OpenClaw o Cline. Están asegurando una compatibilidad directa con los ecosistemas que ya manejan los desarrolladores habitualmente bajo los estándares de OpenAI, reduciendo cualquier fricción al adoptarlo.

Además, para los entusiastas del hardware local y la privacidad absoluta, la empresa ha publicado los pesos descargables de GLM-5.1 y su versión optimizada GLM-5.1-FP8 en su repositorio de modelos abiertos. Un verdadero regalo para la comunidad open-source que busca montar su propia infraestructura.

En el fondo, este lanzamiento confirma lo que agencias internacionales como Reuters llevaban meses avisando: Z.ai es uno de los verdaderos «tigres de la IA» en China, y su reciente salida a bolsa en Hong Kong no fue fruto de la casualidad. Su enfoque implacable en la infraestructura de agentes demuestra que la carrera tecnológica ya no va de quién tiene el chat más empático, sino de quién automatiza mejor el trabajo duro. La pelota está ahora en el tejado de Silicon Valley. Veremos cuánto tardan en devolver el golpe.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.