Anthropic acaba de plantarse ante el Pentágono. Y no con un “ya veremos”, sino con un “no puedo en conciencia” frente a la exigencia de acceso sin restricciones a sus sistemas de IA, incluidos los modelos tipo Claude. El ultimátum, además, está acompañado de advertencias sobre “consecuencias” si Anthropic no acepta las condiciones impuestas por el Departamento de Defensa.

El choque no gira en torno a una cláusula más dentro de un contrato, sino a algo mucho más profundo: quién fija los límites cuando la inteligencia artificial se cruza con el poder militar, la información clasificada y decisiones potencialmente irreversibles. En concreto, el CEO Dario Amodei hizo pública su postura a menos de 24 horas del plazo fijado para el viernes a las 17:01 por el secretario de Defensa, Pete Hegseth.

El desacuerdo real es quién manda: la ley, el Ejército o las salvaguardas de una empresa privada

El Pentágono sostiene que debería poder utilizar el modelo de Anthropic para cualquier propósito lícito, sin excepciones. Desde su perspectiva, una compañía privada no debería imponer condiciones adicionales cuando el cliente es Defensa y el marco es estrictamente legal.

Amodei, sin embargo, introduce un matiz clave. Reconoce que las decisiones militares corresponden al Departamento de Defensa, no a una start-up ni a un laboratorio tecnológico. Pero, al mismo tiempo, advierte que existe “un conjunto reducido de casos” en los que la IA puede socavar valores democráticos en lugar de protegerlos. Ese matiz cambia por completo la discusión.

También te puede interesar:EEUU Abandona Claude por Ser una IA Woke Pero la Usa para Bombardear IránSu argumento, técnico y ético a la vez, es doble: hay usos de la IA que simplemente están fuera de lo que la tecnología actual puede hacer de manera segura y fiable. Si hoy un sistema puede alucinar, confundir contextos o volverse excesivamente “creativo” bajo presión, en una demostración puede resultar anecdótico; en un entorno militar, en cambio, puede convertirse en una temeridad.

Dos líneas rojas: vigilancia masiva y armas autónomas sin humanos en el circuito

Anthropic ha trazado dos prohibiciones que considera innegociables. La primera es clara: no quiere que sus modelos se utilicen para vigilancia masiva de ciudadanos estadounidenses. Eso implica rechazar cualquier despliegue de IA de frontera orientado a ampliar, a escala industrial, la monitorización interna, la correlación masiva de datos o el profiling sistemático de la población.

La segunda línea roja apunta a las armas totalmente autónomas sin humanos “en el circuito”. Aquí el matiz es esencial: “humanos en el circuito” no es un simple eslogan, sino supervisión e intervención reales. No basta con un operador que pulse un botón simbólico mientras el sistema toma decisiones a velocidad de máquina; se trata de garantizar control humano efectivo sobre decisiones críticas.

También te puede interesar:EEUU Abandona Claude por Ser una IA Woke Pero la Usa para Bombardear IránAnthropic no está diciendo “no” al uso militar de la IA en términos generales. Lo que plantea es un “no” específico a dos aplicaciones que, según su tesis, cruzan un umbral ético y de seguridad difícil de justificar.

El ultimátum llega con dos palos: cadena de suministro o la Defense Production Act

Según se ha informado, el Departamento de Defensa habría presionado con dos posibles medidas si la empresa no cede. La primera sería etiquetar a Anthropic como un riesgo para la cadena de suministro, una designación habitualmente reservada para actores considerados problemáticos desde el punto de vista estratégico.

La segunda opción es aún más contundente: invocar la Defense Production Act. Esta ley otorga al presidente autoridad para obligar a empresas a priorizar o ampliar producción orientada a la defensa nacional, una herramienta poderosa en contextos de seguridad.

Amodei subraya aquí una contradicción incómoda: una amenaza presenta a Anthropic como un riesgo para la seguridad nacional, mientras que la otra sugiere que su tecnología —Claude incluido— es esencial para esa misma seguridad. En otras palabras, “o somos un problema o somos imprescindibles”, pero sostener ambas posiciones al mismo tiempo resulta difícil de conciliar.

Anthropic quiere seguir, pero sin ceder el volante

Lejos de romper relaciones, Amodei evita quemar puentes. Reconoce que Defensa tiene derecho a elegir contratistas alineados con su visión estratégica y sus requisitos operativos. Sin embargo, pide que se reconsideren las condiciones, argumentando que la aportación de la tecnología de Anthropic a las fuerzas armadas podría ser sustancial.

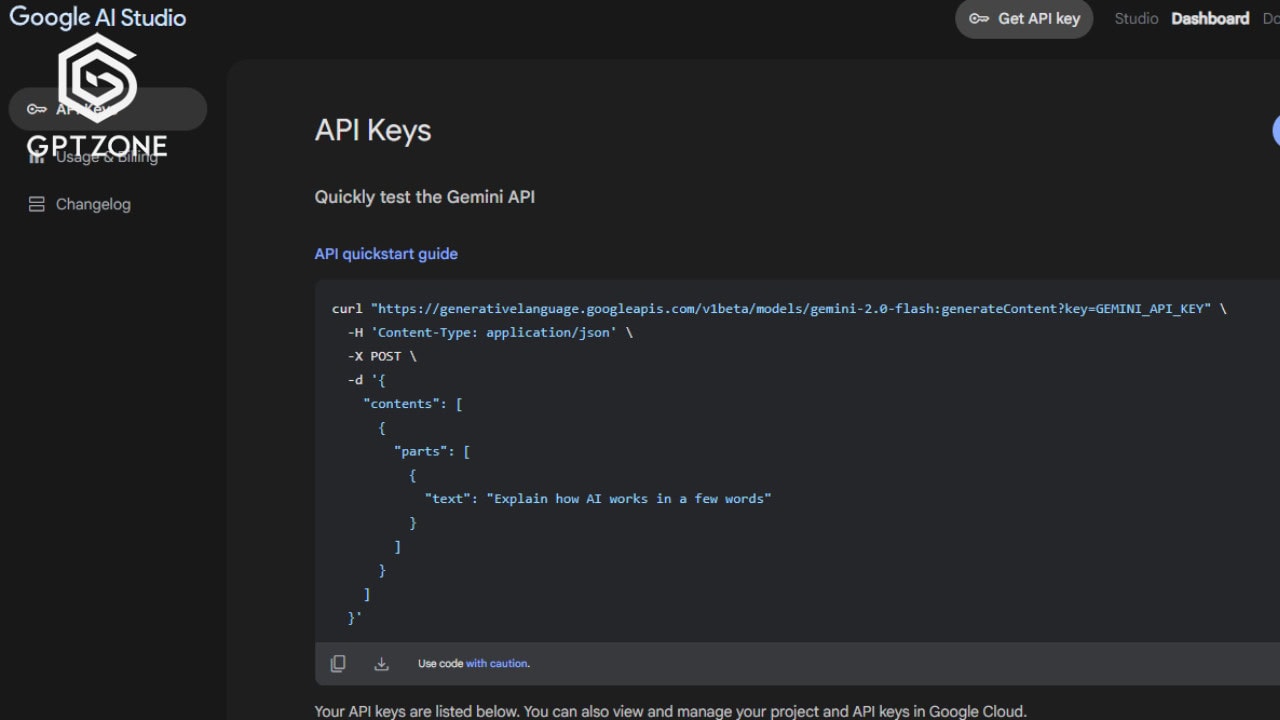

De hecho, la empresa sostiene que actualmente sería el único laboratorio de IA de frontera con sistemas “listos para clasificados” destinados al Ejército, es decir, preparados para operar en entornos donde la información es sensible y los estándares de seguridad superan con creces los de una API pública en la nube.

En paralelo, se ha señalado que el Departamento de Defensa estaría preparando a xAI para asumir ese rol si el desacuerdo con Anthropic se consolida. Si esa transición se acelera como consecuencia del conflicto contractual, el mensaje al sector tecnológico sería claro: en la IA aplicada a defensa, aceptar acceso total puede convertirse en la condición implícita para seguir dentro del juego.

La parte más fría del comunicado: “si nos dejáis fuera, os ayudamos a salir”

Amodei afirma que la preferencia de Anthropic es continuar prestando servicio al Departamento y a los “warfighters”, siempre que se respeten esas dos salvaguardas. No obstante, añade que, si finalmente se decide prescindir de sus servicios, la empresa colaborará para facilitar una transición ordenada hacia otro proveedor.

Eso implica evitar interrupciones en planificación militar, operaciones u otras misiones críticas. No hay amenazas públicas ni insinuaciones de represalias tecnológicas; el tono es institucional, casi quirúrgico. Sin embargo, leído entre líneas, el mensaje es firme: podemos separarnos sin dramatismo, pero no renunciaremos a nuestros principios.

En el fondo, lo que está en juego no es solo el futuro de Anthropic como contratista. Se discute el precedente que se establece cuando los modelos de IA más potentes del planeta pasan a convertirse en infraestructura de Estado. Si el acceso sin restricciones se normaliza, las líneas rojas empresariales corren el riesgo de convertirse en mera retórica corporativa. Si, por el contrario, se respetan, podría consolidarse un modelo híbrido en el que la IA militar opere bajo límites explícitos, auditables y con responsabilidad humana real.

La cuenta atrás ya está en marcha. Habrá que ver si el Pentágono acepta dos salvaguardas que, desde fuera, pueden parecer razonables, o si decide que en la batalla por el control de la inteligencia artificial prevalece quien posee el contrato y la palanca legal.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.