Anthropic, la empresa detrás del modelo de lenguaje Claude, ha comenzado a probar una nueva funcionalidad denominada Study Projects, que apunta directamente al sector educativo. Esta herramienta, aun en etapa temprana, tiene como objetivo estructurar el proceso de aprendizaje de los estudiantes, brindándoles no solo respuestas puntuales, sino también una guía interactiva y continua para estudiar.

Con esta apuesta, Anthropic se suma a la carrera que ya libran OpenAI con Study Together en ChatGPT y Google con Guided Learning en Gemini.

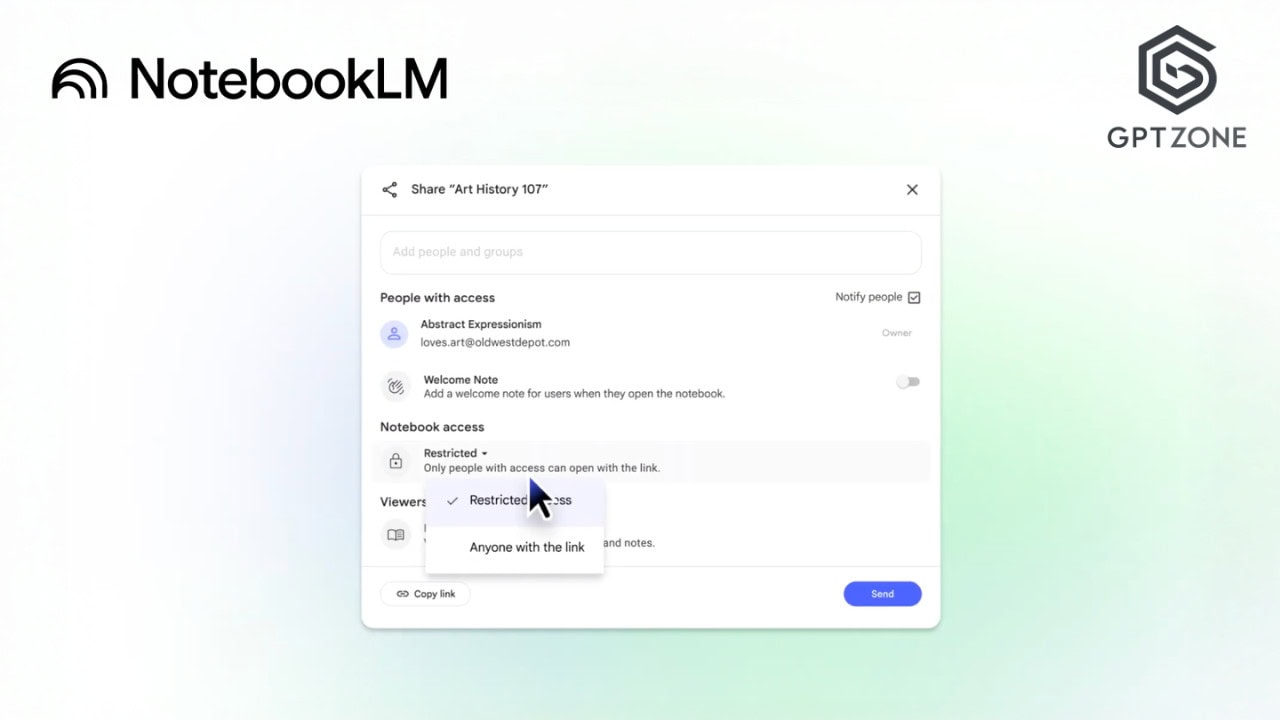

Aunque por el momento la interfaz de Claude no ha cambiado, los primeros detalles revelan un enfoque más ambicioso: Study Projects funcionará como un entorno de trabajo progresivo donde se podrá visualizar conceptos complejos, generar guías de estudio y ajustar objetivos sobre la marcha. No se trata de una simple conversación con IA, sino de una experiencia educativa estructurada.

Una estrategia que responde al auge de los estudiantes

En paralelo, OpenAI y Google ya han empezado a introducir funciones similares en sus asistentes conversacionales, dejando claro que el ámbito educativo se ha convertido en uno de los principales frentes de expansión para los grandes laboratorios de IA.

También te puede interesar:Anthropic Evalúa Inversiones de IA en Emiratos y Catar, Ante Dilemas Éticos y Competencia GlobalMás allá del interés por captar a los estudiantes como usuarios actuales, también está en juego la influencia futura: se trata de formar a quienes mañana desarrollarán, integrarán y normarán el uso de estas tecnologías.

Esta competencia entre compañías no solo es una carrera por usuarios, sino también un intento por anticiparse a posibles regulaciones gubernamentales sobre el uso de IA en educación. En Europa, por ejemplo, el AI Act ya establece criterios diferenciados según los ámbitos de aplicación, y el entorno educativo aparece como uno de los más sensibles.

¿Qué diferencia a Claude en esta propuesta?

Si bien aún no hay fecha de lanzamiento oficial para Study Projects, la apuesta de Anthropic podría destacar en aspectos clave. La compañía ha cultivado una reputación por su enfoque en la seguridad y la ética en el desarrollo de modelos de IA.

Esta línea podría jugar a su favor en un entorno donde padres, docentes e instituciones valoran cada vez más el cumplimiento normativo y la transparencia en las herramientas digitales utilizadas en las aulas.

Además, al posicionarse como un tutor adaptativo más que como un simple sistema de preguntas y respuestas, Claude apunta a una mayor personalización del aprendizaje, algo que ha sido una promesa largamente esperada en el cruce entre tecnología y educación.

La posibilidad de adaptar la guía de estudio a los materiales, el ritmo y los objetivos del estudiante podría marcar una diferencia significativa respecto a otras soluciones más rígidas.

Educación, la nueva frontera de la IA generativa

Este nuevo enfoque de las grandes tecnológicas representa un cambio de paradigma: de asistentes que simplemente informan, a sistemas que acompañan, enseñan y modelan procesos de aprendizaje.

También te puede interesar:Anthropic Evalúa Inversiones de IA en Emiratos y Catar, Ante Dilemas Éticos y Competencia GlobalPero también plantea interrogantes: ¿cómo se garantizará la exactitud de los contenidos que se generen? ¿Qué mecanismos de revisión pedagógica se implementarán? ¿Están preparados los sistemas actuales para adaptarse a diferentes niveles educativos y contextos culturales?

Por ahora, lo cierto es que la IA generativa sigue extendiendo su influencia en el ámbito educativo, y compañías como Anthropic no quieren quedarse atrás. La transición de Claude hacia un rol más activo y estructurado en el aprendizaje refleja una apuesta estratégica por ganar terreno en un sector cada vez más relevante para el futuro de la inteligencia artificial.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.