¿Te preocupa qué pasa con tus conversaciones y tu código al chatear con una IA? La nueva retención de datos en Claude cambia las reglas del juego y conviene entenderlas bien. Vas a poder decidir qué se guarda y para qué, pero hay plazos y matices que no se ven a simple vista.

La empresa detrás de Claude ha movido ficha y te pide una elección clara antes de una fecha límite concreta. Con todo, muchos usuarios pasan por alto los avisos o piensan que borrar un chat basta, y no siempre es así. Aquí te explicamos qué cambia, por qué lo hacen y cómo proteger tu privacidad sin perder funciones.

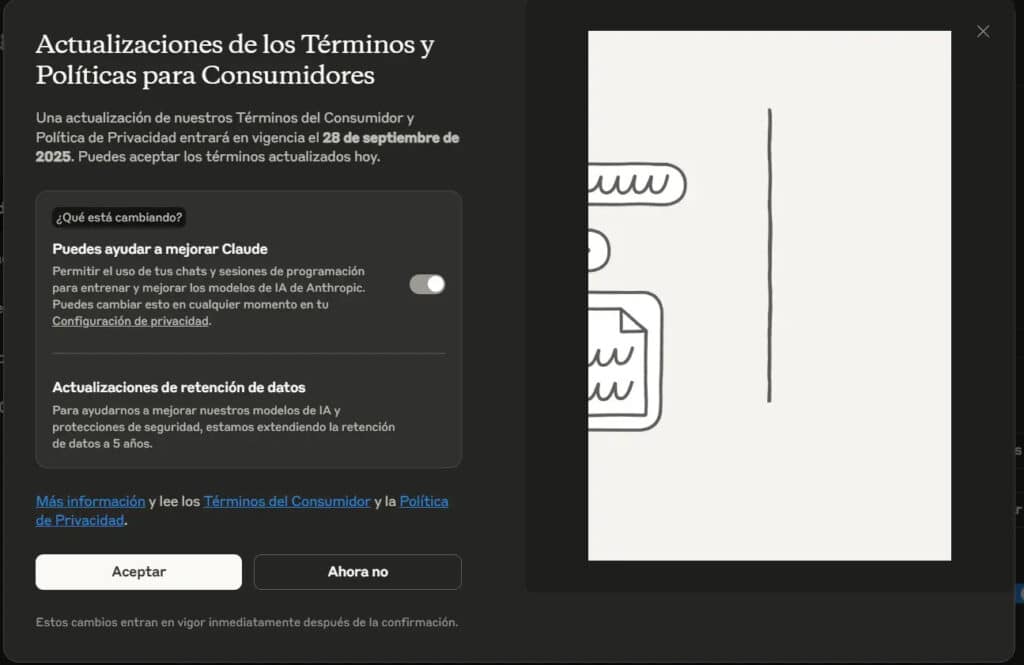

La novedad principal es que, antes del 28 de septiembre, tienes que decidir si permites que tus conversaciones se usen para entrenar los modelos de IA. Hasta ahora, Anthropic no empleaba chats de consumidores para ese fin, y la retención de datos en Claude era muy limitada. A partir de este cambio, la compañía quiere usar tus charlas y sesiones de coding para mejorar el sistema.

Si no te excluyes de forma expresa, Anthropic ampliará la retención de datos en Claude a cinco años. Esta medida afecta solo a productos de consumo como Claude Free, Pro y Max, y también a quienes usan Claude Code. Los clientes empresariales, como Claude Gov, Claude for Work, Claude for Education o quienes acceden por API, quedan fuera de estos cambios.

| Aspecto | Antes | Ahora |

|---|---|---|

| Uso para entrenamiento | Sin uso de chats de consumo | Posible uso de chats y coding si no te excluyes |

| Retención por defecto | Borrado del backend a ~30 días | Cinco años si no te excluyes |

| Excepciones legales o por políticas | Hasta dos años | Se mantienen según obligación |

| Alcance | Consumo con borrado rápido | Consumo ampliado; empresarial excluido |

Si usas la versión de consumo, la retención de datos en Claude te afecta de lleno. Hablamos de la versión gratuita, los planes de pago y el módulo de programación. En cualquier caso, los servicios para empresas y la API mantienen sus garantías, en línea con la protección que otras compañías aplican a clientes corporativos.

Esta diferenciación no es casual. Las cuentas empresariales suelen tener acuerdos de tratamiento de datos muy estrictos y controles adicionales. Si usas tu cuenta personal para tareas del trabajo, revisa bien las opciones antes de continuar, porque tus charlas podrían entrenar el modelo si no te excluyes a tiempo.

También te puede interesar:El Próximo Modelo de Anthropic podría anunciarse en las próximas semanasLa compañía enmarca el cambio como una elección del usuario. Si aceptas, ayudarás a mejorar la seguridad, la capacidad de detectar contenido dañino y la calidad de respuestas. También afirman que los datos servirán para pulir habilidades de codificación, análisis y razonamiento en futuros modelos.

Hay un motivo competitivo claro: para ponerse a la altura de rivales como OpenAI y Google, es clave contar con grandes volúmenes de datos conversacionales de calidad. Recoger millones de interacciones va a reforzar su posición en el sector, y ampliar la retención de datos en Claude les permite entrenar durante más tiempo y con más variedad de casos reales.

El movimiento de Anthropic llega en un contexto de escrutinio creciente a la retención de datos. OpenAI afronta una orden judicial que le exige conservar indefinidamente todas las conversaciones de consumidores, incluidos chats borrados, por una demanda de medios como el New York Times. La empresa considera esa exigencia excesiva y contraria a sus compromisos con la privacidad.

Con todo, los clientes empresariales de OpenAI y quienes tienen acuerdos de retención cero siguen protegidos. Esta disparidad entre consumo y empresa marca la pauta del mercado y explica por qué la retención de datos en Claude también distingue entre tipos de cuentas. Tú, como usuario de consumo, necesitas revisar mejor qué aceptas y hasta cuándo.

Mucha gente cree que eliminar una conversación equivale a sacarla del sistema para siempre. En la práctica, pueden existir copias, logs o retenciones por obligaciones legales que alargan la vida del dato. Con todo, entender la retención de datos en Claude te ayuda a decidir mejor si te excluyes del entrenamiento o no.

También influye cómo se comunican los cambios. Las empresas a menudo publican las actualizaciones en lugares poco visibles, y el usuario no las ve. El impacto es real, porque aceptar nuevas condiciones puede abrir la puerta al uso de tus charlas para entrenar modelos durante años.

También te puede interesar:Anthropic lanza un plan de Claude para colegios y universidadesEl nuevo flujo de consentimiento para usuarios existentes muestra un botón de “aceptar” muy destacado. El conmutador para no participar en el entrenamiento aparece en letra más pequeña y, según se ha observado, puede mostrarse activado por defecto. El diseño puede empujarte a hacer clic rápido sin revisar, y podrías terminar permitiendo el uso de tus conversaciones.

Expertos en privacidad llevan tiempo avisando: con la IA, el consentimiento “informado” es más difícil. La retención de datos en Claude añade más capas, y si las opciones quedan escondidas, el riesgo de aceptar algo no deseado aumenta. La FTC de EE. UU. ha advertido que tomar medidas encubiertas o esconder información en enlaces o letra pequeña puede traer sanciones.

La capacidad de vigilancia está en duda, porque la FTC opera ahora con tres de cinco comisionados. Ese vacío genera incertidumbre y deja al usuario con más responsabilidad: revisar, preguntar y ajustar la configuración antes de seguir utilizando el servicio.

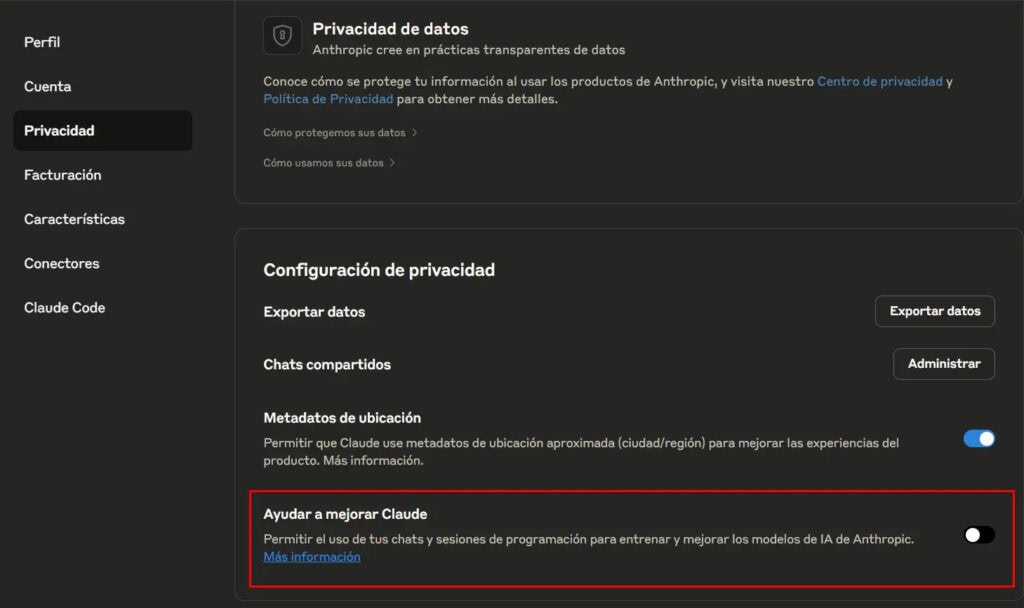

Si quieres controlar la retención de datos en Claude y el uso de tus charlas para entrenar modelos, sigue estos pasos. Te proponemos una rutina concreta para que no se te escape nada clave.

Si no actúas, pueden usar tus conversaciones y sesiones de código para entrenar la IA y la retención de datos en Claude pasará a ser de cinco años. Lo mejor es revisar y elegir explícitamente.

No. Las ofertas empresariales como Claude Gov, Claude for Work, Claude for Education y el acceso por API quedan fuera. La retención de datos en Claude que se amplía aplica a productos de consumo.

También te puede interesar:Los Chats Eliminados de ChatGPT Deberán Ser Guardados según Sentencia de un TribunalNo necesariamente. Antes se borraba del backend a ~30 días, salvo obligaciones legales o violaciones de políticas, que podían alargar la retención hasta dos años. Ahora, si no te excluyes, la retención de datos en Claude puede llegar a cinco años.

Prometen mejoras en seguridad y detección de contenido dañino, y también mejores respuestas en codificación, análisis y razonamiento. Necesitan muchos datos para competir con OpenAI y Google, y la retención de datos en Claude facilita ese objetivo.

Lee la pantalla completa, busca el conmutador de no participar y confirma tu elección antes de pulsar “aceptar”. Vuelve a comprobar tras cada actualización, porque el diseño puede cambiar con el tiempo.

Si usas Claude a diario, te conviene fijar tu posición ahora. Decide si contribuyes al entrenamiento o si prefieres limitar la retención de datos en Claude y mantener tus charlas fuera de los conjuntos de entrenamiento. Con una revisión de cinco minutos, vas a poder reducir riesgos, ganar claridad y usar la IA con más tranquilidad.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.