Cuando una herramienta de IA salta a la fama, llegan usos creativos y también dilemas incómodos. Con Sora de OpenAI no es distinto: genera vídeos hiperrealistas y abre debates que tocan la privacidad, el duelo y el respeto. Te contamos qué ha pasado con Zelda Williams, por qué te afecta aunque no uses Sora y los límites reales existen hoy.

Zelda Williams habla sobre Sora de OpenAI y los deepfakes de Robin Williams

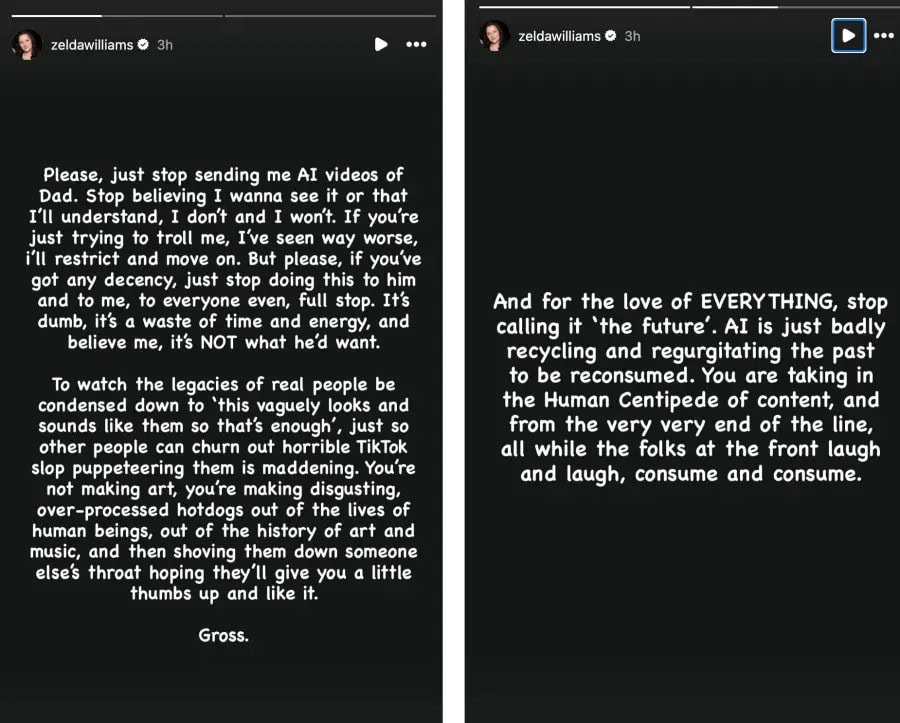

Zelda Williams pidió que las personas dejen de enviarle vídeos generados por IA que recrean a su padre, Robin Williams. Lo dice alto y claro: no quiere verlos, no los entiende y asegura que él tampoco los habría querido. Para ella, crear y compartir esos clips es un gasto de tiempo y energía, y resulta irrespetuoso con la familia y la memoria del actor.

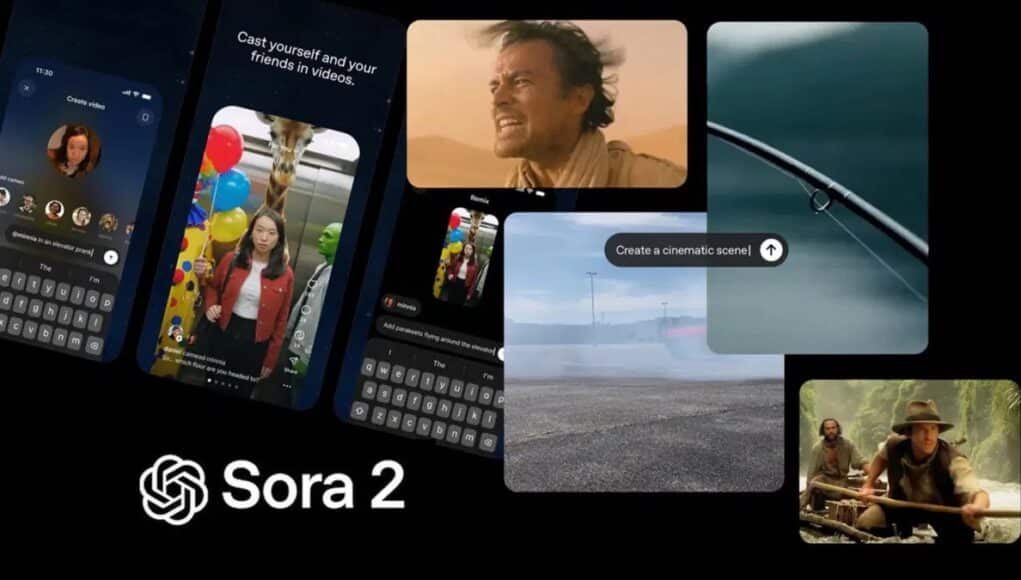

Su mensaje llega justo cuando Sora de OpenAI vuelve a primera línea con su versión Sora 2 y una app social. Te puede parecer casualidad, aunque el contexto explica por qué su protesta ha prendido: cada día circulan más vídeos de celebridades fallecidas recreadas con IA y la conversación pública se ha calentado.

Cómo funciona Sora de OpenAI: app, Sora 2 y límites de generación

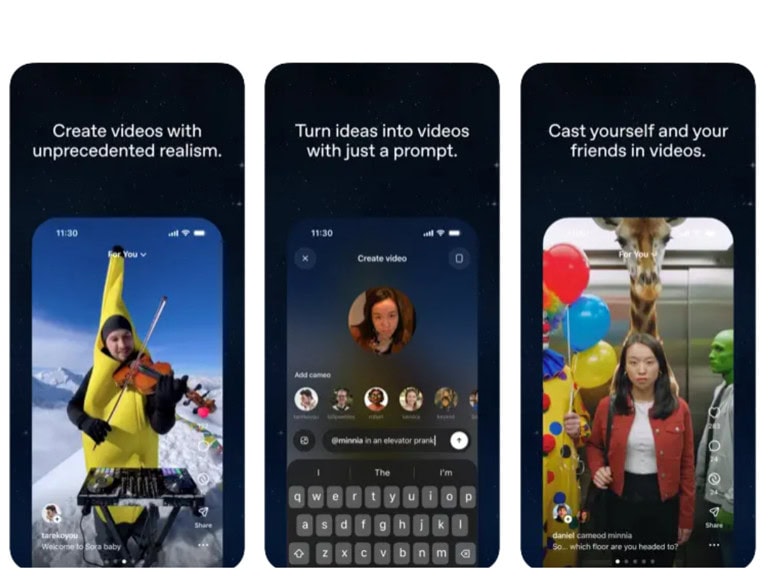

La app permite crear clips hiperrealistas a partir de texto y referencias visuales. Con Sora de OpenAI vas a poder generar deepfakes de ti, de amigos con consentimiento y de ciertos personajes de dibujos animados. El resultado engaña al ojo medio, y ahí empieza el problema cuando entran en juego personas reales.

También te puede interesar:Sora 2 Llega a Android: Novedades Tras su Aparición en Google Play StoreQué puedes generar con la app Sora de OpenAI

La plataforma bloquea, en teoría, la recreación de personas vivas si no hay permiso. Ese freno no se aplica a fallecidos, por lo que la mayoría de figuras muertas pueden generarse sin trabas. Esa asimetría es clave en el debate: Sora de OpenAI no te dejará clonar a tu vecino, pero sí a un cantante que murió hace décadas.

La función cameo de OpenAI para personas vivas

Para calmar críticas iniciales, OpenAI añadió una función de cameo. Sirve para que una persona viva defina cómo quiere aparecer si otro la incluye en un vídeo. Es “una especie de ‘ping’” de directrices personales. Los fallecidos no pueden fijar nada, y por eso la medida no cubre los casos que más ruido están generando.

Deepfakes de personas fallecidas con Sora de OpenAI: qué dice la ley y por qué preocupa

¿Es ilegal recrear a alguien que ya murió? El Student Press Law Center recuerda que no existen restricciones legales que impidan la difamación de personas fallecidas. Dicho de forma cruda, los muertos son “juego limpio” a ojos de la normativa actual. Con Sora de OpenAI eso se traduce en cientos de clips que nadie puede frenar con una denuncia por difamación.

Difamación de fallecidos según Student Press Law Center

La jurisprudencia indica que OpenAI probablemente no sería considerada responsable por esas recreaciones. El vacío legal no elimina el daño cultural y personal. Zelda Williams lo resume con rabia contenida: el legado de una persona real se reduce a “esto se parece y suena vagamente a ellos, así que es suficiente” para entretener durante un rato.

También te puede interesar:Sora 2 Llega a Android: Novedades Tras su Aparición en Google Play StoreResponsabilidad probable de OpenAI y ausencia de respuesta

TechCrunch pidió a la compañía su postura sobre la legitimidad de crear deepfakes de personas muertas. Sora de OpenAI no respondió. Esa falta de claridad deja la sensación de que la barra está baja, y que el incentivo a publicar más contenido “impactante” pesa más que el respeto básico.

Riesgo de tratar a personas como objetos manipulables

Si normalizamos estos usos, sienta un precedente peligroso: personas reales, vivas o muertas, se convierten en objetos de manipulación digital. Tú puedes romper la cadena con decisiones sencillas al compartir, comentar o generar contenido con IA.

Política de derechos de autor en Sora de OpenAI: MPA, opt-in y personajes protegidos

OpenAI arrastra críticas por una postura flexible con derechos de autor. Tras el lanzamiento de Sora, aparecieron deepfakes de personajes protegidos como Peter Griffin y Pikachu en cuestión de horas. Ese clima alimenta la idea de que Sora de OpenAI prioriza la libertad de creación por encima del control fino de IPs.

Proliferación de personajes como Pikachu y Peter Griffin

La rapidez con la que surgieron esos vídeos muestra que los filtros iniciales no bastaban. El impulso creativo de la comunidad no justifica saltarse licencias, y el coste reputacional para OpenAI fue inmediato.

Cambio de postura de Sam Altman ante la MPA

Sam Altman llegó a decir que los estudios y agencias debían pedir exclusión explícita si no querían que sus IP se usaran en Sora. Tras la presión de la Motion Picture Association, anunció un giro hacia controles de copyright más detallados y un modelo de opt-in. La MPA sostiene que la legislación vigente protege a los creadores también en vídeos generados con IA, y Sora de OpenAI tendrá que adaptarse.

Comparativa ética y de seguridad: Sora de OpenAI frente a xAI y otras plataformas

Sora destaca por su verosimilitud. Es, posiblemente, el modelo de deepfakes más peligroso de acceso público por la calidad de sus resultados. Otras plataformas van por detrás en realismo, pero con menos barreras de protección. Eso ha abierto la puerta a deepfakes pornográficos, como sucedió con xAI de Grok.

Realismo vs barreras de protección

El equilibrio es frágil: cuanto mejor luce el vídeo, más impacto tiene en reputación y privacidad. Con Sora de OpenAI la combinación de realismo y filtros imperfectos hace que cada vídeo polémico sea más creíble y, por tanto, más dañino si cruza líneas morales.

Recomendaciones prácticas para usar Sora de OpenAI sin vulnerar derechos ni sensibilidades

¿Quieres experimentar sin cruzar líneas? Te proponemos un camino claro. Aplícalo cada vez que abras Sora de OpenAI, y vas a poder crear con tranquilidad.

- Pide consentimiento. Solicita permiso por escrito si vas a recrear a una persona viva, y guarda la prueba.

- Evita fallecidos. No generes vídeos de personas muertas, aunque la ley lo permita. El respeto pesa más.

- Usa la función cameo. Activa o respeta directrices de cameo cuando una persona viva lo haya configurado.

- Respeta la propiedad intelectual. No subas ni difundas personajes con copyright sin licencias claras.

- Etiqueta el contenido. Indica que es generado por IA y añade contexto para no inducir a error.

- Revisa los filtros. Comprueba los límites vigentes de Sora de OpenAI antes de publicar.

- Piensa en el impacto. Pregúntate: ¿daña a alguien?, ¿humilla?, ¿se usa para engañar?

Qué está en juego: el legado digital y el respeto a personas reales

Cuando conviertes a una persona en material maleable, la reduces a un molde sin voluntad. Zelda Williams nos recuerda esa frontera humana. Con Sora de OpenAI y con cualquier otra IA, la pregunta no es solo qué puedes generar, sino qué deberías dejar de hacer, incluso si nadie te lo prohíbe.

El caso de Zelda Williams no va solo de un algoritmo. Habla de límites sociales ante Sora de OpenAI, de legalidades que aún no cubren el respeto a los fallecidos y de una industria que afina sus controles tras la presión de la MPA. Si creas o compartes, actúa con cabeza: vas a poder disfrutar de la tecnología sin convertir el legado de personas reales en simple material de entretenimiento.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.