En los últimos años, la inteligencia artificial se colocó en casi todas las herramientas de uso diario, desde editores de fotos hasta asistentes de escritura. Adobe es una de las empresas que más apuesta por esta tecnología, con servicios como Firefly o modelos pensados para móviles. Todo suena muy cómodo para ti como usuario, pero detrás hay una parte delicada: ¿con qué datos se han entrenado esos sistemas?

Ahí es donde empieza el problema. Una nueva demanda colectiva propuesta apunta directamente a Adobe y pone el foco en el uso de libros pirateados para entrenar uno de sus modelos de IA. Si escribes, si publicas contenido o simplemente te preocupa qué pasa con los derechos de autor en internet, este caso te afecta más de lo que parece. Vamos a ver qué se está reclamando, qué son exactamente Books3 y RedPajama y por qué pueden cambiar la forma de entrenar la IA generativa.

Para entender la demanda, conviene que tengas claro quién es Elizabeth Lyon. Ella es una autora de Oregón conocida por sus manuales de escritura de no ficción, libros pensados para ayudarte a estructurar ideas, mejorar tu estilo y pulir textos profesionales. Ese tipo de obras suelen circular bastante en formatos digitales, legales y no legales.

Lyon afirma que sus guías forman parte de un conjunto de preentrenamiento usado por Adobe en uno de sus modelos de lenguaje. Según la demanda, sus textos aparecen en un subconjunto procesado de un dataset manipulado que habría sido la base del sistema SlimLM. Ella no habría dado su autorización ni habría firmado ningún acuerdo de cesión de derechos para estos usos de IA generativa.

El centro técnico del conflicto es SlimLM de Adobe, una serie de modelos de lenguaje pequeños diseñados, según la propia compañía, para tareas de asistencia con documentos en dispositivos móviles. En la práctica, esto significa que SlimLM está pensado para ayudarte a leer, resumir, buscar o generar texto directamente desde tu móvil o tablet.

La ventaja de un modelo así es que vas a poder tener funciones de asistencia documental sin depender tanto de grandes servidores externos, lo que mejora velocidad y privacidad. La demanda no discute tanto lo que hace SlimLM, sino cómo ha aprendido a hacerlo y qué tipo de libros y materiales se han usado para entrenarlo.

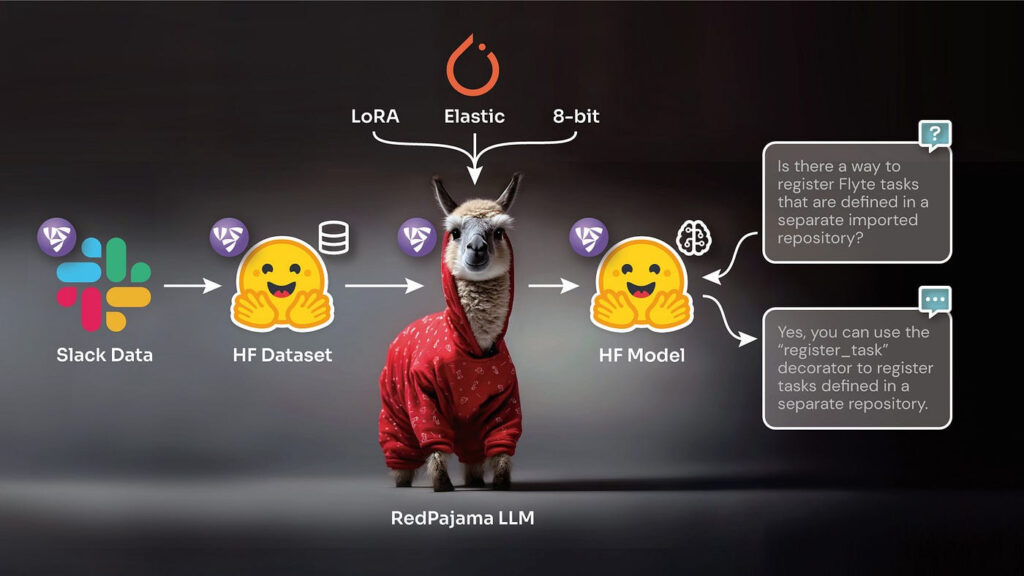

También te puede interesar:Adobe propone una solución para proteger a los artistas del uso indebido de IASegún la documentación publicada por la propia Adobe, el modelo SlimLM se preentrenó con SlimPajama‑627B. Este conjunto de datos se describe como “deduplicado, multicorpus y de código abierto”, y fue publicado por la empresa Cerebras en junio de 2023. En teoría, se trata de un dataset pensado para entrenar modelos de lenguaje de forma abierta y reutilizable.

La demanda contra Adobe sostiene que ahí está la raíz del problema. Los abogados de Lyon argumentan que SlimPajama no se creó desde cero, sino copiando y manipulando otro conjunto de datos llamado RedPajama. Si esto es así, todo el contenido delicado que estaba en RedPajama se habría arrastrado también a SlimPajama‑627B y, por tanto, al entrenamiento de SlimLM.

RedPajama. Se trata de un conjunto de datos masivo creado para entrenar modelos de IA generativa que busquen competir con sistemas como GPT. Incluye contenido de muchas fuentes distintas, y su composición ya ha aparecido mencionada en otras demandas relacionadas con derechos de autor.

La demanda afirma que SlimPajama se construyó copiando y manipulando RedPajama, lo que lo convertiría en una obra derivada. Esa condición es clave desde el punto de vista legal, porque si RedPajama contiene material protegido, cualquier copia o derivado que lo incluya estaría arrastrando las mismas vulneraciones de copyright. A partir de ahí, todo lo que dependa de SlimPajama, como SlimLM, quedaría también bajo sospecha.

Dentro de RedPajama hay un subconjunto que se ha vuelto casi “famoso” en los tribunales: Books3. Este dataset agrupa unos 191.000 libros que se han usado para entrenar distintos sistemas de IA generativa. El problema es que muchos de estos títulos están protegidos por copyright y, según varios autores, se obtuvieron de forma pirateada.

El texto legal que afecta a Adobe sostiene que, al copiar RedPajama, el conjunto SlimPajama incluye también Books3. Eso significaría que los libros de Lyon, y los de otros muchos autores, habrían acabado en los datos de entrenamiento de SlimLM. Esta conexión entre Books3, RedPajama y SlimPajama es justo lo que convierte la demanda contra Adobe en una pieza más dentro de un conflicto que afecta ya a buena parte del sector tecnológico.

También te puede interesar:Ahora puedes editar fotos de Adobe Stock con IA antes de ComprarlasSi te preguntas por qué Books3 y RedPajama salen tanto en estas noticias, la respuesta está en su escala y en su origen. Son datasets pensados para ofrecer a los algoritmos de IA una cantidad enorme de texto, y eso incluye novelas, ensayos y manuales protegidos por derechos de autor que, según los demandantes, se han copiado sin permiso.

En varios casos de litigio previos se ha señalado directamente el uso de RedPajama y Books3 para entrenar modelos comerciales. Los demandantes dicen que las empresas tecnológicas han aprovechado estas bases de datos masivas, en muchos casos con obras pirateadas, para mejorar sus productos sin tener que negociar licencias ni pagar a los autores. Para ti como creador o usuaria, esta tensión entre acceso a datos y respeto al copyright marca el futuro de la IA generativa.

La demanda que afecta a Adobe no es un caso aislado. En septiembre se presentó una acción legal contra Apple en la que se acusa a la compañía de haber usado materiales protegidos por copyright para entrenar Apple Intelligence, su sistema de IA integrado en sus dispositivos. En esa demanda también se mencionaba expresamente RedPajama como fuente de datos problemática.

Los autores que demandaron a Apple aseguran que la empresa copió obras protegidas “sin consentimiento y sin crédito o compensación”. Es el mismo patrón que se señala ahora en el caso Adobe: grandes modelos de lenguaje entrenados con textos de libros y manuales obtenidos, supuestamente, sin permisos adecuados. Esta repetición de argumentos hace que cada nueva demanda se apoye en las anteriores y refuerce la presión legal sobre el uso de datasets como RedPajama y Books3.

Poco después de la demanda a Apple, llegó otra dirigida a Salesforce. En este caso, los demandantes también alegan que la empresa habría usado RedPajama para entrenar sus modelos de IA, incluyendo obras protegidas sin permiso. De nuevo, el foco está en la forma en que se recopilan y procesan los textos usados para entrenar la IA generativa.

Para ti como observador, todo esto crea un patrón claro: distintas compañías, distintos productos de IA, pero los mismos datasets polémicos (RedPajama y Books3) apareciendo una y otra vez en las demandas. Cada caso añade presión y marca un clima legal en el que entrenar modelos sin tener clarísimo el origen de los datos se vuelve cada vez más arriesgado.

Todo este contexto muestra que estamos en plena ola de demandas por IA generativa. Cada vez más autores y titulares de derechos empiezan a revisar cómo se han entrenado los sistemas que hoy usas para resumir textos, generar imágenes o escribir correos. Cuando encuentran rastros de sus obras en datasets abiertos o filtrados, las demandas llegan casi de forma automática.

Los algoritmos de IA necesitan conjuntos de datos masivos para aprender a escribir, traducir o responder preguntas. Parte de esos datos procede, según los demandantes, de materiales pirateados o subidos sin permiso a internet. Este choque entre necesidad técnica y marco legal es justo lo que está planteando si el entrenamiento de estos modelos debe cambiar radicalmente en los próximos años.

Un ejemplo importante para entender el caso de Adobe es lo que pasó con Anthropic, la empresa detrás del chatbot Claude. En septiembre, Anthropic aceptó pagar 1.500 millones de dólares a un grupo de autores que la acusaban de haber usado versiones pirateadas de sus obras para entrenar su modelo de IA.

Ese acuerdo no solo cerró un conflicto concreto, sino que muchos lo ven como un posible punto de inflexión en las batallas legales sobre copyright y datos de entrenamiento. Si una empresa está dispuesta a pagar esa cantidad, el mensaje para el resto del sector es claro: entrenar modelos de IA generativa con libros y contenidos protegidos, sin acuerdos previos, puede salir muy caro a medio plazo.

Si juntamos todo, la demanda contra Adobe por Books3 y RedPajama encaja en una tendencia muy clara: los tribunales están empezando a marcar los límites de cómo se puede entrenar la IA. Para ti, esto puede traducirse en modelos más transparentes sobre sus fuentes de datos y, posiblemente, en servicios que paguen licencias a editoriales y autores.

Aunque el caso todavía está en marcha, ya deja una idea clave: el entrenamiento de sistemas como SlimLM o Apple Intelligence no es solo una cuestión técnica, también es un tema legal y ético. A partir de ahora, cuando uses una herramienta de IA generativa para escribir, resumir o aprender, vas a poder preguntarte con más criterio de dónde salen realmente los textos que ha leído ese modelo y qué impacto tiene en quienes los crearon.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.