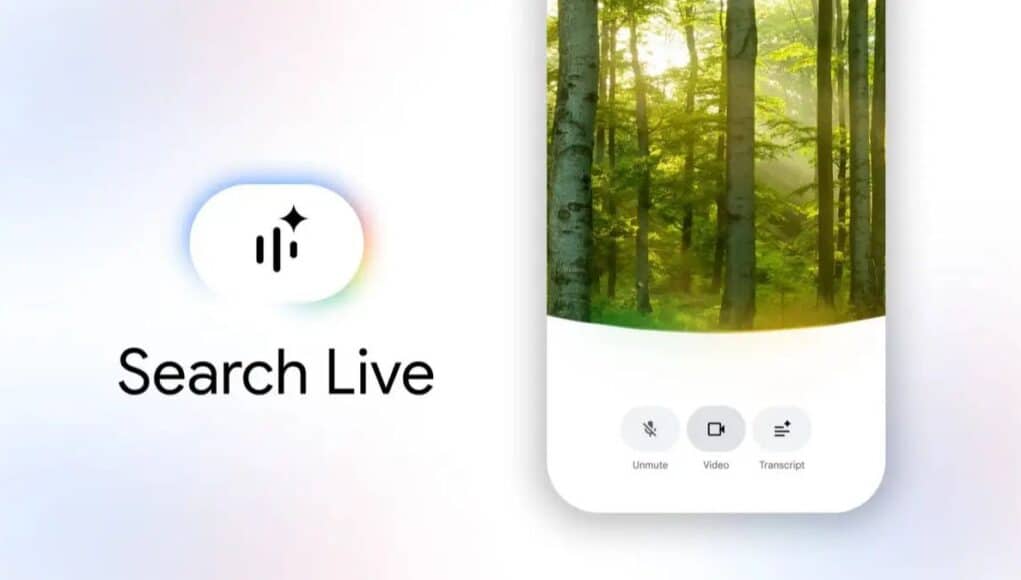

¿Cuántas veces has intentado describirle al buscador una pieza rara de IKEA que no sabes cómo montar? Tras meses de exclusividad, la gran G acaba de pulsar el botón rojo para democratizar por fin su asistente del futuro. Google acaba de anunciar el lanzamiento global de Search Live, una bestia impulsada por IA que te permite usar la cámara y la voz simultáneamente para realizar consultas complejas.

Adiós a teclear en el móvil. Y es que la compañía ha confirmado en un anuncio del jueves que esta función aterriza de golpe en más de 200 países y territorios. Una maniobra tremendamente agresiva para ganar la batalla de los asistentes. Básicamente, la premisa es que apuntes con la lente de tu teléfono a cualquier cosa que tengas delante y formules preguntas al aire. El sistema te responde con su propia voz mientras despliega en pantalla enlaces útiles para profundizar en la web.

La cámara es el nuevo teclado: así lee la IA el mundo real

Si miramos la mecánica, la experiencia resulta casi mágica en el uso diario. Imagina que estás peleando con las instrucciones incomprensibles de un mueble. Sacas el terminal, enfocas ese desastre de tablas y tornillos, y le preguntas a la IA cómo se ensambla eso paso a paso.

El sistema procesa el torrente de vídeo y audio en tiempo real, lo cruza con el inmenso índice de Google y te devuelve una solución masticada. Así de fácil.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidosEvidentemente, esto no es un invento sacado ayer de un laboratorio cerrado. Los usuarios estadounidenses ya jugaban con una primera versión desde septiembre del año pasado. Pero el salto tecnológico que vemos hoy es abismal, sobre todo porque ahora el asistente es capaz de entender docenas de idiomas de forma nativa sin despeinarse.

El motor bajo el capó: la latencia extrema de Gemini 3.1 Flash Live

Pero claro, para procesar todos estos datos visuales y sonoros sin que el procesador de tu móvil colapse, hace falta hardware pesado en la nube y un software optimizado al milímetro. Aquí es donde entra a jugar el verdadero cerebro de la operación: el nuevo modelo de IA Gemini 3.1 Flash Live centrado en audio. Menudo nombrecito.

En concreto, los ingenieros confirman que este LLM es intrínsecamente multilingüe y ha sido diseñado desde su base para procesar voz sin intermediarios. No coge tu voz, la pasa a texto, la procesa y vuelve a generar audio. Se traga el sonido crudo directamente de la fuente.

Es decir, se eliminan los típicos cuellos de botella en el pipeline de la inferencia. El resultado directo de esta arquitectura es una velocidad de respuesta que asusta. El asistente reacciona muchísimo más rápido y mantiene un tono de conversación que resulta tremendamente natural e intuitivo. Casi como hablar con un colega empollón.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidosCómo activar la nueva búsqueda visual ahora mismo

Por si fuera poco, el despliegue es completamente universal, tanto si defiendes la trinchera de Android como si usas a diario un iPhone. Nada de listas de espera exclusivas.

Para probarlo, solo tienes que abrir la aplicación principal de Google o tirar de la conocida herramienta Google Lens. Verás un flamante botón «Live» situado justo debajo de la barra de búsqueda tradicional. Lo pulsas y dejas que la IA haga su magia.

Traducción simultánea al oído: el as en la manga para el ecosistema iOS

Para rematar esta avalancha de novedades, los de Mountain View han soltado otra perla técnica que había pasado algo desapercibida y que afecta directamente a su mítica app de idiomas. Ahora, la aclamada función de traducción en tiempo real de Google Translate da el salto definitivo a los dispositivos de Apple. Y eso cambia las reglas del juego a la hora de viajar.

Si tienes unos auriculares vinculados, tu móvil es capaz de captar una conversación ajena en la calle y chivarte la traducción directamente al canal auditivo casi al instante. Una auténtica locura de ciencia ficción.

Como era de esperar, esta virguería está saliendo de su fase inicial de pruebas y comienza a expandirse hoy mismo a un buen puñado de mercados clave. La lista de afortunados ya incluye a España, Alemania, Francia, Italia, Reino Unido y Japón, sumando también países como Nigeria, Bangladesh y Tailandia.

Al final del día, queda claro que las grandes tecnológicas libran una guerra encarnizada para colonizar nuestros sentidos. Ya no les basta con que miremos una pantalla pasivamente. Quieren ver lo que vemos y oír lo que oímos para convertirse en nuestros copilotos absolutos de la realidad. La pelota está ahora en el tejado de OpenAI y Apple. Veremos si la competencia responde a tiempo con algo parecido.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.