Google acaba de mover ficha en generación de imágenes con Nano Banana 2 (también llamado Gemini 3.1 Flash Image), y lo ha hecho a lo grande: ya es el modelo por defecto en buena parte de su ecosistema, desde Gemini hasta Search. Esto no es una simple demo vistosa publicada en un blog, sino una actualización pensada para que la uses exactamente donde ya estabas: crear, buscar, anunciar, traducir y producir sin cambiar de entorno.

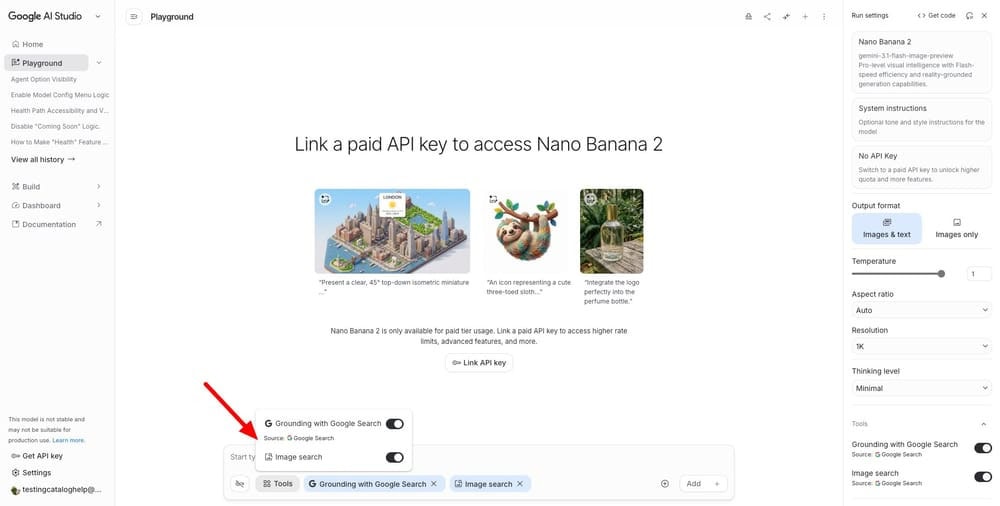

En concreto, Nano Banana 2 pasa a ser la opción predeterminada en la app de Google Gemini, en Google Search —tanto en AI Mode como en Lens— y en AI Studio. A esto se suma su disponibilidad vía Gemini API y en Google Cloud a través de Vertex AI, además de su integración en Flow y Google Ads.

Cuando algo se convierte en “default” dentro del ecosistema de Google, no es un detalle menor: implica adopción masiva por pura fricción cero. No se trata de convencer al usuario de probar algo nuevo, sino de integrar la herramienta directamente en los flujos que ya utiliza a diario.

Esto, inevitablemente, mete presión a cualquier competidor en imagen generativa, porque Google no está lanzando un modelo aislado, sino desplegando una infraestructura de distribución que lo coloca frente a millones de personas desde el primer día.

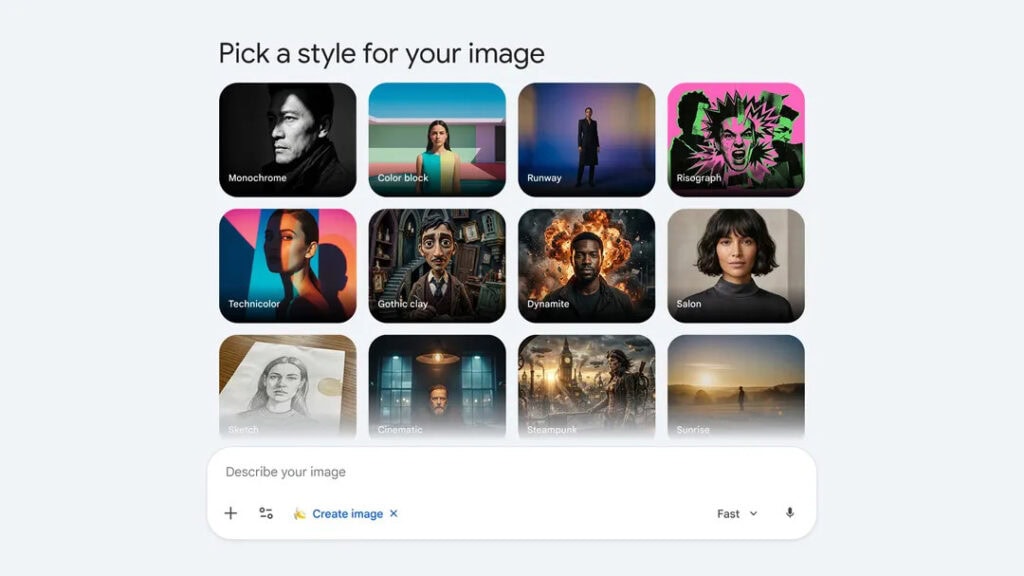

Nano Banana 2 se apoya en la filosofía de Gemini Flash: generación rápida, baja latencia y una experiencia que no obliga a esperar. Según Google, mantiene esa velocidad, pero mejora la fidelidad y ofrece resultados más precisos que sus versiones anteriores. En otras palabras, el clásico dilema entre “rápido” y “bonito” intenta dejar de ser un dilema.

También te puede interesar:Primeras Imágenes Generadas por Nano Banana 2: Análisis y Resultados

Sin embargo, la clave no es únicamente estética. El verdadero salto está en la consistencia y el control, dos puntos donde muchos modelos fallan cuando se les exige algo más complejo que un prompt sencillo. Generar una imagen llamativa es relativamente fácil; sostener coherencia cuando hay múltiples elementos en juego es otra historia.

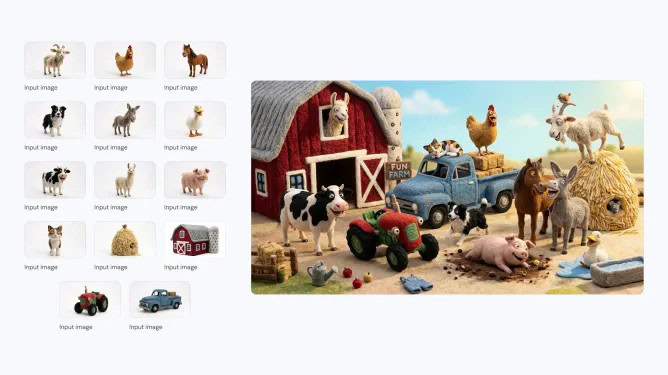

Una de las mejoras técnicas más llamativas es el mantenimiento de la consistencia del sujeto para hasta cinco personajes y 14 objetos en una misma escena. Esto permite construir imágenes complejas —o incluso series de variaciones— sin que el protagonista cambie de rostro, peinado o vestimenta en cada iteración.

Para sectores como marketing, educación o producción creativa, este punto marca la diferencia entre un experimento atractivo y una herramienta verdaderamente utilizable. Ya no se trata solo de generar algo impactante, sino de poder trabajar sobre ello con continuidad.

Además, Google habla de una adhesión más estricta a instrucciones complejas. Esto se vuelve especialmente relevante cuando el prompt incluye condiciones específicas, excepciones o composiciones detalladas. En la práctica, significa menos “licencias artísticas inesperadas” y más resultados alineados con lo que realmente se pidió.

Quienes han probado generadores de imagen conocen bien uno de sus puntos débiles: el texto incrustado suele aparecer distorsionado o ilegible. Nano Banana 2 promete un renderizado de texto más preciso, algo clave para carteles, anuncios, presentaciones o materiales educativos.

Este avance encaja especialmente con plataformas como Google Ads, donde un error tipográfico puede afectar la percepción de marca o el rendimiento de una campaña. La capacidad de generar piezas visuales con texto correcto deja de ser un detalle estético para convertirse en un requisito funcional.

También te puede interesar:Google Nano Banana 2 Flash Está Llegando a Gemini 3 Pro: Novedades y Características

A esto se suma la traducción integrada, pensada para facilitar la localización global de contenidos. En la práctica, una misma creatividad puede adaptarse a distintos idiomas y mercados sin rediseñar desde cero ni depender de ajustes manuales que alteren la composición original.

En términos técnicos, el modelo produce visuales listos para producción con resoluciones que van desde 512 px hasta 4K y admite diferentes relaciones de aspecto. Más allá del impacto del “4K” como etiqueta, esto significa mayor flexibilidad para recortar, reencuadrar o reutilizar piezas sin que aparezcan artefactos o pérdida notable de calidad.

Uno de los puntos más ambiciosos del modelo es su capacidad de apoyarse en información e imágenes en tiempo real desde la web para representar con mayor precisión temas complejos. No se limita únicamente a lo aprendido durante el entrenamiento, sino que puede incorporar contexto actualizado cuando la tarea lo exige.

Esta posibilidad abre escenarios interesantes para visualizaciones informativas, educativas o incluso comerciales que requieren datos recientes. Sin embargo, también plantea preguntas necesarias sobre sesgos, derechos y trazabilidad de las referencias utilizadas. La actualización constante puede mejorar la precisión, pero exige mecanismos claros de transparencia.

En ese contexto, Google ha reforzado las funciones de procedencia mediante SynthID y estándares como C2PA Content Credentials. El objetivo es aumentar la transparencia sobre los contenidos generados por IA, algo que deja de ser opcional en un entorno donde el realismo alcanza niveles cada vez más altos.

Estas medidas buscan que el usuario pueda identificar cuándo un contenido es sintético y comprender su origen dentro de flujos creativos o profesionales. No obstante, la eficacia de la procedencia depende de su adopción consistente y de que no quede reducida a una etiqueta que pase desapercibida.

El lanzamiento no se limita a unos pocos mercados. La expansión incorpora 141 países nuevos y añade soporte para ocho idiomas adicionales, lo que refuerza la intención de posicionar el modelo como una herramienta de uso cotidiano y no como una beta restringida.

Al integrarse directamente en Search, Lens y la app de Gemini, el hábito puede formarse casi sin esfuerzo. Esa es la jugada estratégica: cuando la generación de imágenes está incrustada en las herramientas que ya utilizas a diario, la adopción se vuelve orgánica.

Ahora bien, lo que queda por observar es si esta combinación de rapidez, consistencia y precisión textual se sostiene en escenarios reales y no solo en demostraciones cuidadosamente seleccionadas. Si Nano Banana 2 cumple lo que promete, el estándar de lo que consideramos “imagen generativa útil” podría elevarse de forma significativa, obligando a la competencia a responder no solo en benchmarks técnicos, sino también en distribución y accesibilidad.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.