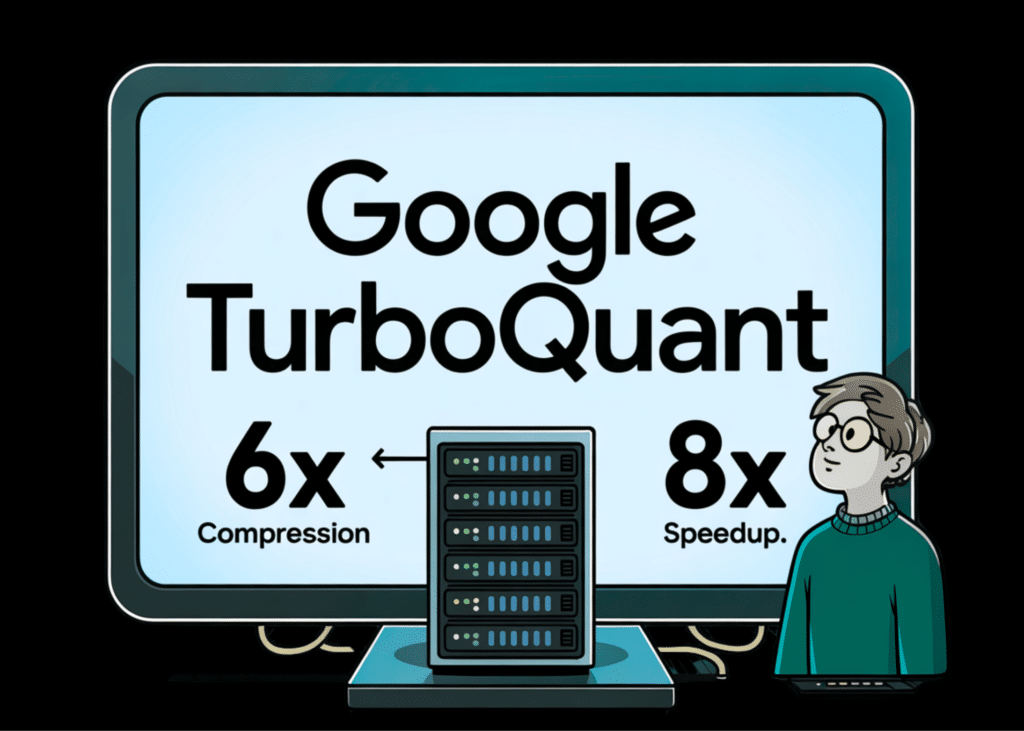

Google acaba de sacudir el avispero de la inteligencia artificial con un anuncio que parece sacado directamente del guion de una serie de televisión. Literalmente. Y es que la compañía describió la tecnología detrás de su nuevo invento como algo casi mágico para el procesamiento de datos. Hablamos de TurboQuant, un algoritmo de compresión de memoria que ataca uno de los mayores dolores de cabeza del hardware actual.

Así de simple. Su objetivo principal es reducir radicalmente el espacio que necesitan los modelos masivos para funcionar sin que su rendimiento caiga en picado. La dependencia excesiva de memoria física está ahogando a las start-ups del sector, por lo que todo el mundo tecnológico está intentando entender cómo han logrado exprimir tanto la arquitectura interna de la red neuronal.

Si llevas tiempo siguiendo la actualidad del hardware, sabrás que el gran problema ahora mismo no es solo entrenar a los LLM. El auténtico pozo de dinero es mantenerlos encendidos 24/7 respondiendo peticiones. Lo que propone el gigante buscador podría ser la tirita perfecta para frenar esta tremenda hemorragia de costes operativos.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidosQuizás la terminología técnica se haga algo bola de primeras, pero para que te hagas una idea, muchos ya están comparando esto con la famosa compresión de la ficticia empresa «Pied Piper«, de la serie de HBO Silicon Valley. Así lo piensa una buena parte de la comunidad de desarrolladores. Comprimir al máximo sin perder calidad aparente en las respuestas.

El truco detrás de la magia: vaciando la caché de la IA

En concreto, el foco de la nueva investigación de TurboQuant está puesto de lleno en optimizar la famosa KV cache. Esta es la memoria de trabajo temporal que utilizan los sistemas generativos durante la fase de inferencia. Es decir, el momento exacto en el que tú escribes un prompt y el modelo empieza a escupir texto, código o imágenes. A medida que las ventanas de contexto son más grandes, esta caché crece descontroladamente.

Si miramos los números fríos, la promesa es verdaderamente gigantesca. Según los ingenieros del proyecto, este nuevo enfoque algorítmico es capaz de reducir esa memoria de ejecución en al menos seis veces. Una auténtica barbaridad. Significa básicamente que el mismo hardware de servidor podría atender a un volumen brutalmente mayor de usuarios a la vez sin toser ni ralentizarse.

El motivo de este hito técnico es brillante: utilizan una forma muy agresiva de cuantización vectorial. En lugar de guardar cada minúsculo dato matemático con su peso original ocupando megabytes, el sistema agrupa y comprime la información esquivando los clásicos atascos en la RAM. Todo eso es viable manteniendo la precisión del modelo intacta a nivel práctico.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidosPor si fuera poco, los cimientos de este proyecto se apoyan firmemente en dos métodos experimentales desarrollados en paralelo por sus propios investigadores. Por un lado, nos topamos con PolarQuant, que es la herramienta directa encargada de ejecutar esa cuantización extrema. Por otro lado se utiliza QJL, un mecanismo diseñado para el entrenamiento y la adaptación de la arquitectura neuronal.

¿Un golpe sobre la mesa al estilo DeepSeek?

Evidentemente, cualquier salto técnico de esta magnitud dispara las expectativas de un mercado obsesionado con ahorrar preciada VRAM. Algunos expertos de la industria ya incluso lo llaman el «momento DeepSeek» de Google, haciendo alusión a la revolución de la eficiencia.

Recordemos que el reciente modelo chino dejó a la competencia descolocada al lograr un rendimiento altísimo con unos costes de procesamiento ridículos. Ahora, parece que todo internet asume que este anuncio es la respuesta occidental para demostrar que las tecnológicas tradicionales también saben apretarse el cinturón algorítmico.

La letra pequeña del anuncio de Google

Pero claro, aquí es donde toca rebajar un poco la euforia inicial. Aunque las cifras de compresión de memoria suenen a pura ciencia ficción, todavía estamos analizando un avance en fase de laboratorio. El algoritmo no ha sido desplegado a nivel comercial en los chatbots que usas cada mañana.

De hecho, el calendario es bastante conservador. Para ver las entrañas del proyecto en su máximo esplendor tendremos que esperar a que el paper se defienda oficialmente en la conferencia académica ICLR 2026. Paciencia y buenos alimentos.

A ello se le suma un detalle de contexto nada menor que conviene recordar. Esta optimización ataca única y exclusivamente la fase de inferencia. El proceso de entrenamiento inicial de los gigantescos modelos de lenguaje seguirá exigiendo granjas de procesadores de NVIDIA trabajando al máximo rendimiento. No soluciona el problema de hardware global.

Veremos si la competencia reacciona rápido a este órdago a la eficiencia o si se quedan rezagados en el consumo masivo de memoria. Si logran implementar esta arquitectura a corto plazo, la caída de precios en los servicios de IA podría ser inminente. La pelota está ahora en el tejado de OpenAI.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.