Microsoft ha presentado Correction, una nueva herramienta diseñada para corregir errores factuales en los textos generados por inteligencia artificial (IA). Aunque esta innovación busca mejorar la precisión de las respuestas generadas por IA, muchos expertos advierten que no es la solución definitiva a las problemáticas de alucinaciones en los modelos de lenguaje.

¿Cómo funciona la herramienta de corrección de Microsoft?

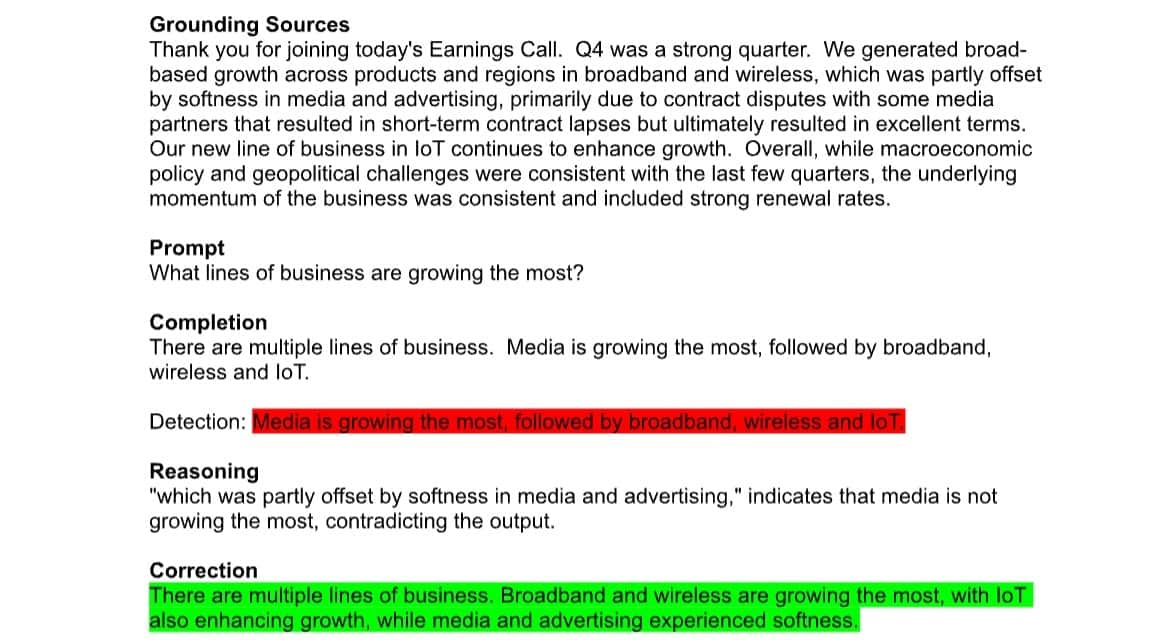

La herramienta Correction identifica y corrige textos generados por IA que podrían contener errores. El proceso comienza cuando el sistema detecta contenido potencialmente incorrecto, como una cita mal atribuida en un resumen de una reunión. Una vez señalado, Correction compara el texto con una fuente de verdad, como transcripciones subidas por el usuario, para asegurarse de que la información sea correcta.

Esta herramienta está integrada en la Azure AI Content Safety API, que actualmente se encuentra en vista previa. Lo interesante es que puede ser utilizada con cualquier modelo de generación de texto, como Llama de Meta o GPT-4o de OpenAI, lo que la convierte en una solución versátil para diferentes plataformas.

Uso de modelos de lenguaje grandes y pequeños

Correction utiliza tanto modelos de lenguaje grandes como pequeños para asegurar que las salidas de texto generadas estén alineadas con los documentos de referencia o de soporte. Esto es particularmente útil en sectores donde la precisión es clave, como en el campo de la medicina, donde los desarrolladores de aplicaciones dependen de respuestas confiables.

Sin embargo, esta herramienta no se limita solo a corregir errores en un sector. Microsoft ha diseñado Correction pensando en una amplia gama de aplicaciones, desde negocios hasta el ámbito educativo.

¿Es posible eliminar las alucinaciones en los modelos de IA?

A pesar del optimismo de Microsoft, los expertos en inteligencia artificial creen que las alucinaciones en los modelos de IA son una parte intrínseca de su funcionamiento. Según Os Keyes, un candidato a doctorado en la Universidad de Washington que estudia el impacto ético de las tecnologías emergentes, eliminar por completo las alucinaciones en IA es como intentar quitar el hidrógeno del agua; es decir, una tarea casi imposible.

Los modelos generadores de texto no «conocen» hechos reales. En su lugar, generan respuestas basadas en patrones estadísticos, utilizando ejemplos de entrenamiento previos para predecir la mejor palabra o frase siguiente. Esto lleva a que los modelos puedan generar respuestas que «parecen» correctas, pero en realidad carecen de precisión factual.

Las alucinaciones como un reto constante

Uno de los grandes problemas que enfrentan los modelos de lenguaje es su capacidad para producir información errónea, conocida como «alucinaciones». En lugar de generar respuestas basadas en hechos concretos, los modelos de IA a menudo predicen respuestas basadas en lo que podría haber sido la respuesta correcta. En sectores críticos como el médico o el legal, esto plantea serios problemas de confianza y confiabilidad.

Microsoft ha abordado este desafío con un sistema doble: un modelo clasificador que busca fragmentos de texto posiblemente incorrectos y un modelo de lenguaje que corrige estos fragmentos en función de documentos de referencia. Sin embargo, los críticos creen que estas soluciones podrían no ser suficientes para resolver el problema de raíz.

¿Una falsa sensación de seguridad?

Mike Cook, investigador especializado en inteligencia artificial en la Universidad Queen Mary, ha expresado sus preocupaciones respecto a esta nueva herramienta. Aunque la corrección puede mejorar algunos aspectos de las respuestas de IA, Cook advierte que también puede generar una falsa sensación de seguridad entre los usuarios. Según él, aunque la herramienta pueda llevarnos de un 90% de seguridad a un 99%, el problema no reside en ese 1% de errores que aún no detectamos.

Este sentimiento es compartido por otros expertos, quienes creen que confiar demasiado en estas correcciones automáticas podría hacer que los usuarios de IA se sientan más confiados de lo que deberían.

¿Un enfoque de negocios detrás de la herramienta?

Otra crítica que ha surgido con respecto a Correction es la estructura de costos que Microsoft ha implementado. Aunque la herramienta es gratuita hasta un límite de 5,000 registros de texto por mes, cualquier uso adicional tendrá un costo de 38 centavos por cada 1,000 textos procesados. Esto ha generado suspicacias sobre las verdaderas intenciones detrás de la herramienta, con algunos sugiriendo que podría ser una estrategia comercial para aumentar los ingresos de la empresa.

Además, Microsoft ha invertido casi 19 mil millones de dólares en IA durante el segundo trimestre del año, lo que ha generado una gran presión para demostrar que esta inversión está dando resultados. Sin embargo, los retornos significativos aún no han llegado, lo que ha llevado a algunos analistas a cuestionar la viabilidad de la estrategia de inteligencia artificial a largo plazo.

¿Estamos avanzando lo suficientemente rápido?

La IA generativa sigue siendo una tecnología en desarrollo, y muchos especialistas creen que estamos acelerando su despliegue más de lo debido. Según Mike Cook, en un escenario de desarrollo normal, la IA generativa aún estaría en investigación y desarrollo en un entorno académico. Sin embargo, las empresas como Microsoft ya han implementado estos modelos en diversas industrias, sin haber solucionado completamente los problemas inherentes, como las alucinaciones.

La herramienta de Correction es solo un paso más en el camino hacia una IA más confiable, pero está claro que aún queda mucho por hacer antes de que podamos confiar plenamente en estas tecnologías en escenarios críticos.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.