Aardvark de OpenAI es un investigador de seguridad autónomo con GPT-5 pensado para equipos que quieren ir un paso por delante de los fallos. Este enfoque permite detectar vulnerabilidades de forma continua y recibir parches listos para revisar sin salir de tu flujo de trabajo.

¿Te interesa saber cómo trabaja por dentro y qué resultados reales ha logrado? Te contamos su canalización, su integración con GitHub, sus cifras en repositorios de referencia y cómo probarlo.

Aardvark de OpenAI: te interesa para descubrir vulnerabilidades

Aardvark de OpenAI es una herramienta de seguridad, en beta privada, que actúa como “un miembro más” del equipo con el foco puesto en tu código. Su misión es clara: mantener un escaneo continuo de grandes bases de código, sugerir parches y reducir ruido para que tú tomes decisiones rápidas.

La versión actual funciona con GPT-5 y se apoya en Codex para proponer correcciones. Tú mantienes el control: revisas, aceptas y fusionas con un clic lo que realmente encaja con tu estándar interno.

Cómo funciona Aardvark de OpenAI: canalización multietapa pensada para tu repositorio

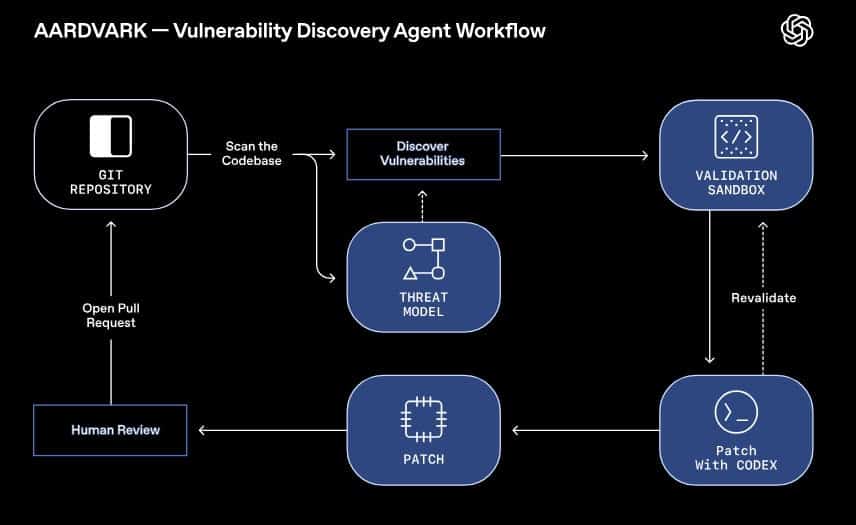

La clave está en una cadena de pasos que no se limita a buscar patrones, sino que razona sobre el contexto del sistema. Con todo, la idea es sencilla: analizar, modelar, vigilar y proponer cambios verificables.

Pasos de la canalización: del análisis inicial al reporte con razonamiento

- Ingiere el repositorio completo: Abre tu monorepo o servicio y deja que analice todo el historial, la estructura y las dependencias.

- Construye un modelo de amenazas: Genera un mapa de superficies atacables y de flujos de datos críticos para entender dónde puede romperse algo.

- Monitoriza commits nuevos: Observa cada cambio y recalcula riesgos para señalar regresiones o puntos débiles recientes.

- Señala problemas con pasos claros: Reporta vulnerabilidades con un razonamiento paso a paso que explica la causa y la posible explotación.

Con este enfoque, Aardvark de OpenAI no dispara alertas genéricas. Al contrario, te muestra el camino lógico que ha seguido para que puedas verificarlo sin perder tiempo en conjeturas.

Validación en sandbox y reducción de falsos positivos en Aardvark de OpenAI

¿Cuántas veces te has peleado con avisos que luego eran ruido? Aquí la diferencia es que cada hallazgo pasa por un entorno aislado. La herramienta valida si un error es realmente explotable antes de molestarte con notificaciones.

Esta verificación en sandbox ayuda a bajar falsos positivos y te ahorra revisiones innecesarias. Nada se fusiona solo: tú haces la revisión final con contexto y tranquilidad.

Integración con GitHub y flujos de trabajo: parches con un clic usando Codex

Aardvark de OpenAI se integra con GitHub para no obligarte a cambiar tus hábitos. Podrás recibir un parche generado por Codex junto al informe, verlo en un PR y decidir sin dar rodeos.

Cómo aplicar los parches propuestos por Aardvark sin romper tu proceso

- Abre el PR sugerido: Revisa el diff y el razonamiento que explica la raíz del fallo y la solución concreta.

- Ejecuta tus pruebas: Valida que las suites internas y los checks de calidad pasan sin sorpresas.

- Fusiona con un clic: Acepta el parche y deja que se integre en tu rama siguiendo tus propias políticas.

¿Usas ramas protegidas o revisiones obligatorias? En cualquier caso, la integración respeta tus reglas. Tú decides el ritmo y el nivel de exigencia en cada merge.

Resultados medibles: 92 % de vulnerabilidades identificadas y CVE reales en open source

Para medir rendimiento, el equipo probó la herramienta en repositorios “golden”, donde se conoce el conjunto de fallos. En ese escenario, Aardvark de OpenAI identificó el 92 % de vulnerabilidades conocidas y sintéticas, una cifra ambiciosa para una beta privada.

Más allá de laboratorios, también ha señalado problemas en proyectos de código abierto. Diez hallazgos ya han recibido identificadores CVE, lo que indica impacto real y validado por terceros.

| Métrica | Dato |

|---|---|

| Tasa de detección en repos “golden” | 92 % de vulnerabilidades conocidas y sintéticas |

| Hallazgos con CVE asignado | 10 vulnerabilidades en proyectos open source |

| Estado actual | Beta privada para socios seleccionados |

Para quién es Aardvark de OpenAI: equipos con grandes bases de código y necesidades continuas

Si llevas un monorepo, un backend con servicios distribuidos o varios SDK, te interesa un investigador autónomo que no se canse. Con Aardvark de OpenAI, puedes mantener comprobaciones constantes sin bloquear a tu equipo de desarrollo.

Su foco está en organizaciones que buscan descubrimiento continuo y parches automáticos revisables. Un equipo pequeño también puede sacarle partido si quiere reforzar su seguridad sin montar un proceso nuevo desde cero.

Uso interno, socios alfa y la hoja de ruta de acceso a la herramienta

La compañía lleva meses usándolo en su propio código y con socios en fase alfa. Este despliegue interno sostenido ayuda a encontrar límites, pulir la canalización y ajustar el balance entre cobertura y ruido.

El plan es ampliar el acceso después de la beta privada cuando demuestren fiabilidad a gran escala. Ya puedes ir preparando tus repositorios y tus pruebas automáticas para aprovecharlo desde el primer día.

Política de divulgación actualizada y escaneos gratuitos para open source no comercial

OpenAI ha actualizado su política de divulgación externa para alinear reportes y tiempos con la comunidad. El objetivo es responder de forma responsable cuando se reportan fallos que afectan a terceros.

Además, la compañía planea ofrecer escaneos gratuitos a proyectos de software de código abierto no comerciales seleccionados. Si mantienes un repositorio comunitario, podrías beneficiarte de análisis periódicos sin coste y con parches propuestos.

Estrategia defensiva: GPT-5 y Codex juntos para reforzar tu seguridad

Aardvark de OpenAI forma parte de una estrategia orientada a defensores, donde GPT-5 aporta comprensión profunda del contexto y Codex sugiere cambios concretos. La combinación apunta a acelerar la respuesta sin sacrificar calidad técnica.

El objetivo no es reemplazar tu criterio, sino darte una base sólida para decidir más rápido. El papel de la revisión humana sigue siendo clave para ajustar cada parche a tu entorno real.

Buenas prácticas para adoptar Aardvark sin fricciones en tu equipo

- Define propietarios de seguridad: Asigna responsables para triage y aprobación de parches.

- Estandariza pruebas: Asegura suites rápidas que verifiquen regresiones al aplicar cambios.

- Documenta criterios: Explica qué se acepta de forma automática y qué requiere revisión ampliada.

Cómo empezar con Aardvark de OpenAI cuando la beta se abra

¿Quieres llegar listo al lanzamiento público? Prepara un piloto. Empieza con uno o dos repositorios críticos, mide tiempos de respuesta y compara tasas de falsos positivos frente a tu sistema actual.

- Selecciona repos con impacto: Prioriza servicios expuestos y librerías que tocan datos sensibles.

- Configura integración con GitHub: Activa PRs automáticos y etiquetas para triage rápido.

- Calibra alertas: Ajusta umbrales y frecuencia hasta equilibrar cobertura y foco.

Así puedes estimar el valor real de Aardvark de OpenAI en tu contexto antes de un despliegue total.

Aardvark de OpenAI pone a tu alcance un investigador de seguridad con GPT-5 que analiza repositorios completos, valida hallazgos en sandbox y propone parches con Codex listos para fusionar. Los resultados en repositorios “golden” y los CVE reales en open source apuntan a impacto tangible, y la integración con GitHub facilita adoptarlo sin cambiar tu forma de trabajar.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.