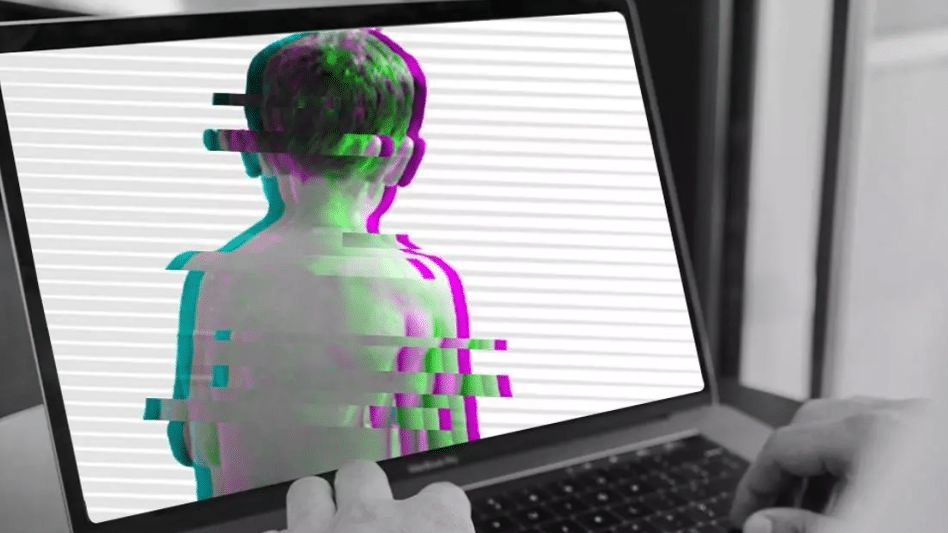

Una foto de uniforme, una imagen en redes o una selfie cualquiera pueden parecer inofensivas. Pero hoy también pueden convertirse en la materia prima de un montaje sexual falso, hecho en segundos y sin que la persona retratada toque un solo botón.

Eso es lo que investiga la Fiscalía de Almería. Según se expuso en unas jornadas sobre inteligencia artificial y derechos fundamentales organizadas por la Guardia Civil y la Universidad de Almería, un posible caso habría afectado a 18 menores de un instituto mediante una aplicación capaz de “desvestir” digitalmente a partir de fotos comunes.

El hallazgo que preocupa a jueces, investigadores y expertos no es solo la existencia de estas herramientas. La pieza clave es su facilidad de uso. Una de estas aplicaciones, según los datos difundidos en el encuentro, puede generar unos 3.900 desnudos de mujeres al día, y el 90% de sus usuarios también crea escenas sexuales completas.

David Calvo, fiscal delegado de Criminalidad Informática, advirtió que si las imágenes de menores son realistas, el uso de esta tecnología puede encajar en un delito de pornografía infantil virtual. En adultos, señaló, también puede haber delito si esas imágenes vulneran bienes jurídicos protegidos como la intimidad, el honor o la propia imagen.

“Vulneran derechos fundamentales de la misma forma que si fueran escenas reales”, fue la idea central trasladada durante las jornadas.

El punto más delicado es que no hace falta una agresión física ni una cámara oculta para causar daño. La IA permite actuar a distancia, sin presencia física y desde cualquier lugar del mundo, algo que la Guardia Civil subrayó como uno de los grandes cambios de este nuevo escenario.

Cuando la imagen falsa activa un daño real

La legislación ya contempla que estas creaciones pueden lesionar derechos fundamentales igual que una escena verdadera. No se trata solo de una broma pesada o de un retoque. Si la imagen tiene apariencia realista, el impacto sobre la víctima y la respuesta penal pueden ser muy serios.

Además, el problema no termina en el montaje inicial. Estas piezas suelen circular con velocidad en redes, chats y foros. Y ahí aparece otro engranaje del problema: la escala. Lo que antes exigía conocimientos técnicos, ahora puede resolverse con una app sencilla y una fotografía pública.

En las mismas jornadas, la vicedecana María José Cazorla puso el foco en la gestión del riesgo y el consentimiento en el tratamiento de datos personales. Es decir, en quién controla la imagen, quién autoriza su uso y qué límites deben existir cuando una máquina puede rehacer la identidad visual de cualquiera.

También se abordaron otros usos malintencionados, como la clonación de voz (imitación artificial de una voz real) y las identidades sintéticas (perfiles ficticios con apariencia humana). Junto a eso, el Gobierno impulsa “Hodio”, una herramienta pensada para medir la huella del odio en redes y detectar cómo contamina el debate público, a menudo con ayuda de bots (cuentas automatizadas).

Sin embargo, los expertos reunidos en Almería insistieron en que la IA no es solo amenaza. También puede ayudar a prevenir delitos, analizar datos y detectar patrones de riesgo, siempre con límites legales claros.

La oportunidad, entonces, no está en apagar la central de la IA, sino en poner fusibles nuevos. Porque cuando una foto cotidiana puede convertirse en un arma, proteger la intimidad de los menores deja de ser una discusión técnica y pasa a ser una tarea urgente de toda la sociedad.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.