Google no sabe estarse quieto con los nombres de sus inteligencias artificiales. Cuando ya nos habíamos acostumbrado a la actual sopa de letras de sus modelos, una nueva filtración acaba de poner el tablero técnico patas arriba. Hablamos de Omni, la que apunta a ser la próxima gran bestia de generación de vídeo integrada directamente en el corazón de Gemini. Y tiene todo el sentido del mundo. La carrera por dominar la creación audiovisual mediante inteligencia artificial está al rojo vivo.

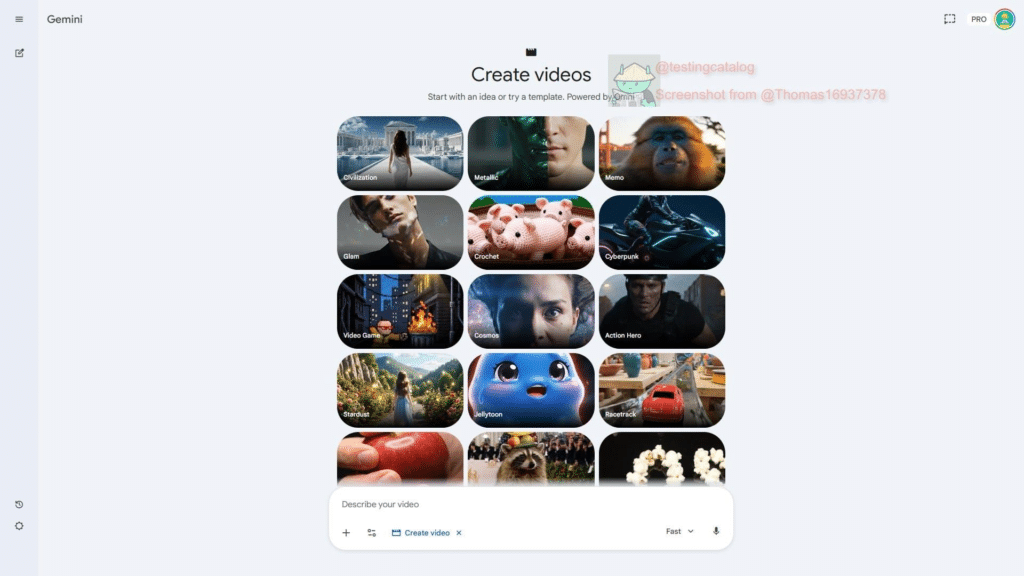

Una filtración reciente ha sacado a la luz una captura de pantalla de la interfaz de Gemini que no deja lugar a demasiadas interpretaciones. En la propia pestaña de creación de vídeo, se puede leer claramente la frase «Start with an idea or try a template. Powered by Omni». Un mensaje directo al consumidor final. Según la fuente que ha destapado esta imagen, no estamos ante un simple nombre en clave interno que quedará enterrado en los repositorios de código. Tiene toda la pinta de ser una marca comercial lista para su inminente salida a la luz.

Y es que, si analizamos al detalle la interfaz filtrada, Omni aparece situado sospechosamente cerca de «Toucan». Quizás este término no te suene absolutamente de nada, pero los desarrolladores saben que Toucan es una herramienta activa basada en la arquitectura de vídeo Veo. Fue detectada en los servidores poco antes del esperado Google I/O 2025. Una auténtica locura de ritmo de desarrollo.

El rompecabezas actual de Google: entre Veo y los modelos Nano Banana

Para entender por qué este nuevo nombre es tan relevante, hay que echar un vistazo rápido a la actual cadena de montaje en los servidores de Google. Ahora mismo, si le pides a Gemini que te genere un clip de vídeo, el motor que ruge en la sombra es Veo 3.1. Es un modelo robusto, nadie en el sector lo niega. Pero la realidad técnica es que funciona de forma completamente independiente al motor que procesa las imágenes estáticas. Son dos mundos distintos.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidos

En concreto, la parte fotográfica de Gemini se apoya actualmente en modelos con nomenclaturas tan peculiares como Nano Banana 2 y su variante más pesada, el Nano Banana Pro. Estos sistemas de inferencia beben directamente de la arquitectura fundacional de Gemini 3 y de Gemini 3.1 Flash Image. Básicamente, Google mantiene a día de hoy una estrategia dividida de libro: una familia de modelos entrenada para el movimiento y otra muy diferente para los píxeles estáticos. Así de simple.

Pero claro, mantener estas arquitecturas separadas es extremadamente costoso a nivel computacional y entorpece el despliegue ágil de nuevas funciones en la nube. Aquí es donde la inminente aparición de Omni cobra todo su significado. El gran debate en foros técnicos es si estamos ante un simple wrapper, es decir, una interfaz bonita para seguir usando Veo, o si realmente es algo mucho más grande y ambicioso. Muchos apuestan por una unificación masiva de la arquitectura multimodal.

Desde el punto de vista del hardware, un modelo verdaderamente unificado es el santo grial de la eficiencia. En lugar de tener granjas de servidores cargando distintos pesos en la memoria dependiendo de si el usuario pide una ilustración o un clip corto, un solo sistema lo gestionaría todo en un único pipeline. Menos cuellos de botella. Más rendimiento por vatio consumido.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidosLa presión asiática y todas las miradas puestas en mayo

Evidentemente, en Mountain View no están reestructurando su inteligencia artificial por amor al arte. El ecosistema del vídeo generativo está sufriendo una sacudida brutal por parte de la competencia directa. ByteDance, la matriz detrás del fenómeno TikTok, está liderando los benchmarks de rendimiento con su reciente modelo Seedance 2.0. Han roto el mercado. Su asombrosa capacidad para mantener la consistencia de los objetos en los vídeos largos está dejando en evidencia a modelos occidentales más veteranos.

A ello se le suma la imperiosa necesidad de Google de rentabilizar las mareantes cifras invertidas en sus centros de datos. Si quieren que las productoras, las agencias de marketing y los creadores paguen suscripciones recurrentes, necesitan un producto que fulmine a la competencia de un plumazo. Omni parece estar diseñado específicamente para ser esa munición pesada.

Si miramos los tiempos de desarrollo de la compañía, el escenario perfecto para soltar esta bomba técnica ya está fijado en el calendario. Todas las quinielas de la industria señalan al Google I/O 2026, programado oficialmente para los días 19 y 20 de mayo. Es en esta conferencia anual para desarrolladores donde Sundar Pichai suele sacar pecho con las verdaderas capacidades de la familia Gemini.

Todavía tocará tener paciencia para comprobar si esta supuesta herramienta unificada cumple con el excesivo hype que rodea a la IA o si se queda en una demo técnica de escenario. Lo innegable es que la barrera entre crear una foto y dirigir un vídeo con un simple prompt está a punto de desaparecer. La pelota ahora mismo está en el tejado de Google.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.