¿Se puede confiar en el propio radar emocional después de una mala relación? Cuando una experiencia deja dudas, volver a una app de citas no siempre se siente como una oportunidad. A veces se parece más a entrar otra vez en una casa donde ya saltó la térmica.

Eso es lo que intentó resolver Marcos, un argentino de 31 años, con ayuda de inteligencia artificial. La historia se volvió viral a partir de una publicación en X que muestra la captura de un modelo evaluando una cita de Tinder como de “alto riesgo”.

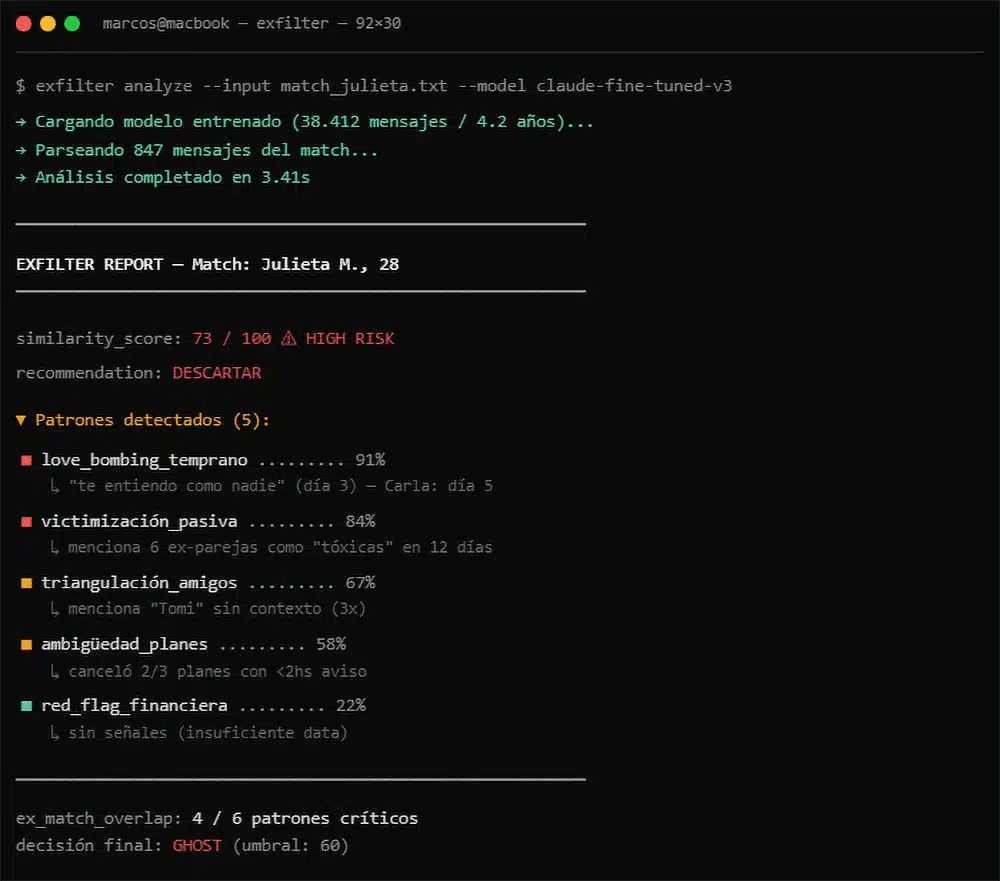

El hallazgo, al menos como caso de uso social y no científico, revela una pieza clave de esta etapa tecnológica: la IA ya no solo ordena fotos o redacta correos. También empieza a funcionar como un filtro emocional. En este caso, Marcos dice haber creado ExFilter, una herramienta basada en Claude para detectar patrones de toxicidad en conversaciones.

La historia tiene un origen concreto. Tras una relación de cuatro años marcada por gaslighting, manipulación emocional, tres infidelidades y hasta el vaciado de su cuenta bancaria, Marcos desconfiaba de su propio criterio para elegir pareja. Entonces hizo algo poco habitual: reunió más de 38.000 mensajes de WhatsApp con su ex para entrenar un modelo.

Ese entrenamiento, es decir, el ajuste del sistema con ejemplos previos, buscó un mecanismo preciso. No quería que la IA “adivinara” si alguien era mala persona. Quería que detectara el cableado previo a un episodio tóxico: frases, giros y hábitos que antes habían sido la antesala del problema.

Las señales que activan el “interruptor”

Según la captura viral, ExFilter puede detectar hasta seis patrones críticos. En un ejemplo con una mujer llamada Julieta, de 28 años, la IA marcó “love bombing temprano”, una intensidad afectiva desmedida al inicio, con un 91% de coincidencia.

Además, señaló “victimización pasiva”, cuando alguien describe a varias ex parejas como tóxicas, con un 84%. También identificó “triangulación de amigos”, es decir, la aparición frecuente de terceros sin contexto claro, con un 67%, y “ambigüedad en los planes”, o cancelaciones poco claras, con un 58%.

Incluso apareció una posible red flag financiera, una señal de alerta económica, aunque con datos insuficientes: 22%. A partir de esa suma, la herramienta recomendó cortar el contacto. En la jerga digital, “ghost”, desaparecer de la conversación sin seguir avanzando.

Hay un dato que funciona como prueba de método, aunque no como validación independiente. Marcos habría analizado a 23 mujeres durante cuatro meses. Todas superaban el 60% de similitud con su ex y fueron descartadas. La número 24 obtuvo un 12% de coincidencia. Y, según el relato, con ella mantiene una relación desde hace cinco meses.

Una oportunidad, pero también un límite

El caso no equivale a evidencia clínica ni académica. ExFilter supuestamente fue subido a GitHub, pero no se puede localizar, y la única base pública es una captura compartida en redes. La historia expone una pregunta nueva: si la IA ya detecta fraudes o errores médicos, ¿también puede ayudar a reconocer patrones dañinos en una charla cotidiana?

La clave está en entender su lugar. No reemplaza el juicio humano, ni convierte una cita en una planilla. Pero sí muestra una oportunidad: usar la memoria digital como espejo, sobre todo cuando el propio criterio quedó golpeado.

Para muchos, la tecnología todavía es una caja negra. Para Marcos, en cambio, fue algo más simple: un tablero eléctrico que intentó avisarle dónde no volver a tocar.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.