¿Te imaginas apuntar los secretos financieros de tu empresa en una libreta y dejarla olvidada en la mesa de una cafetería? Pues a efectos prácticos, algo muy parecido está ocurriendo con una de las aplicaciones de moda en el ecosistema productivo. Hablamos de Granola, la popular herramienta de IA que transcribe tus reuniones, la cual se encuentra en medio de un huracán por su laxa definición de lo que significa la privacidad. Una auténtica locura.

En el papel, Granola afirma que todas tus notas de voz son «privadas por defecto». Sin embargo, la realidad técnica cuenta una historia radicalmente opuesta cuando rascas un poco en sus tripas. Y es que resulta que cualquier persona que logre hacerse con el enlace de tu documento puede leer su contenido sin necesidad de tener cuenta ni autenticarse. Así de simple.

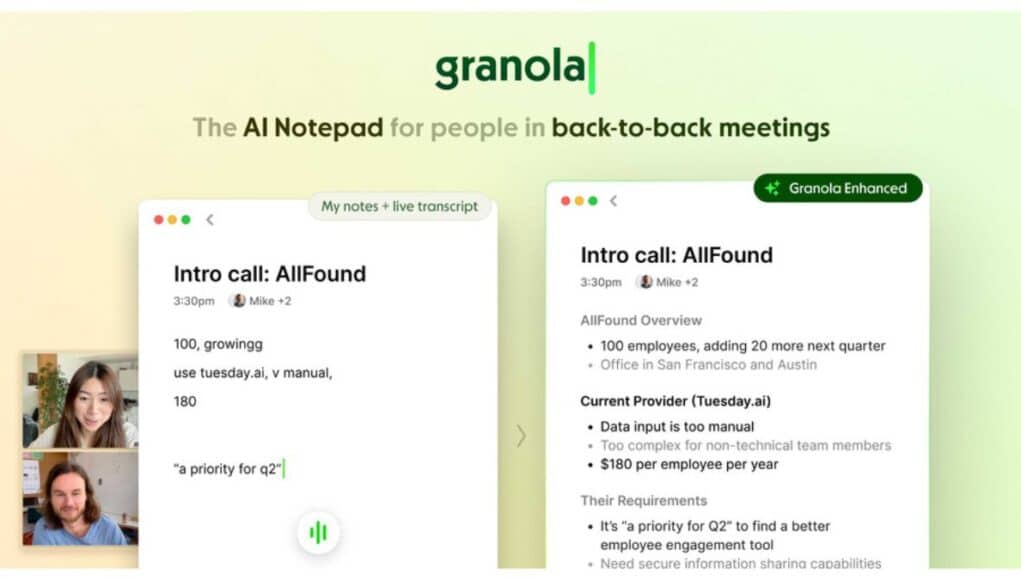

A nivel comercial, la plataforma se presenta como el bloc de notas inteligente definitivo para esas jornadas maratonianas de reuniones por videollamada. Se conecta, escucha el audio de tu calendario y, usando IA generativa, te devuelve un resumen impecable en formato de lista. Todo suena idílico hasta que descubres cómo gestionan el sistema de compartición.

La vulnerabilidad de Granola expone transcripciones mediante enlaces abiertos

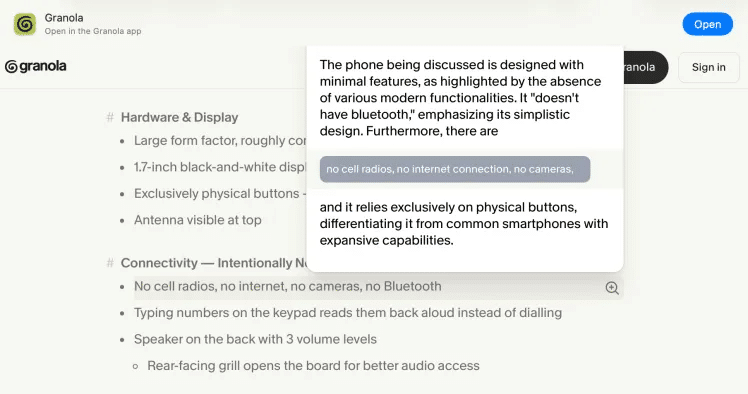

Si miramos los detalles operativos, la brecha asusta bastante. Hemos comprobado de primera mano que puedes abrir una nota compartida desde una ventana de incógnito en tu navegador y acceder al documento sin iniciar sesión. Evidentemente, esta fuga de datos incluye información clave como quién es el creador de la nota y la fecha exacta de la reunión.

En su sitio web intentan justificar este sistema argumentando que elimina fricciones para una colaboración rápida. Pero claro, el desastre está servido si manejas informes confidenciales y ese enlace acaba pegado en el canal de Slack equivocado. Aunque afirmen que estos enlaces no se indexan en buscadores públicos, el acceso directo queda totalmente desprotegido. Un riesgo evidente.

Por otro lado, existe una zona gris bastante preocupante con los textos en crudo. Aunque la empresa dice que no puedes ver el volcado completo de la reunión sin permisos especiales, en la práctica sí se visualizan fragmentos literales asociados a los resúmenes de la IA. Es decir, si tu jefe mencionó una cifra de despidos y el algoritmo la destacó, cualquiera con la URL podrá leer esa frase. Para leer la transcripción íntegra sí que obligan a que los colaboradores abran el archivo dentro de la aplicación de escritorio.

Granola utiliza tus notas para entrenar a su IA si no modificas los ajustes

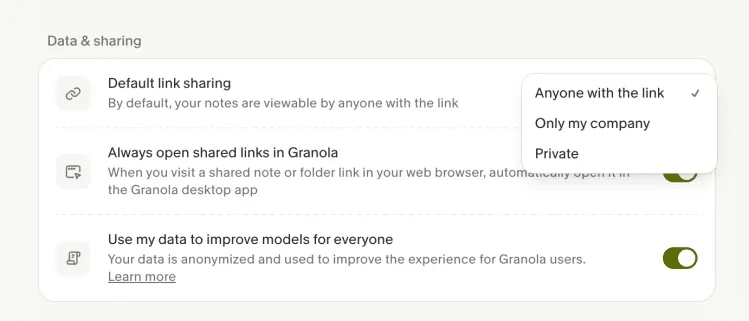

A ello se le suma que el tratamiento interno de tus datos tiene demasiada letra pequeña. De forma predeterminada, la app utiliza la información generada por los usuarios para el entrenamiento y mejora de sus propios modelos de inteligencia artificial. Básicamente, tus reuniones estratégicas alimentan su maquinaria algorítmica, a no ser que bucees en los menús y lo desactives de forma manual.

La única gran excepción a esta norma afecta a los clientes empresariales, quienes quedan excluidos de esta recolección masiva por defecto. Según indica la página de soporte de la aplicación, estos datos se anonimizan y tienen terminantemente prohibido cederlos a gigantes del sector como OpenAI o Anthropic. Prometen que todo el entrenamiento se queda en casa. Pero el daño reputacional ya está hecho.

Como era de esperar, la comunidad tecnológica no ha tardado en reaccionar. Hace poco, un usuario en LinkedIn hizo saltar las alarmas sobre estas prácticas, provocando una avalancha de críticas. Tanto es así que varias corporaciones de gran tamaño han prohibido fulminantemente el uso de esta herramienta a sus directivos por miedo a un fallo de seguridad crítico. Lógico y normal.

La empresa defiende su arquitectura basada en AWS y el cifrado de datos

Para intentar contener la hemorragia de desconfianza, la start-up ha tenido que salir a dar explicaciones sobre su backend. Si repasas la página de seguridad de Granola, insisten en que toda la información se guarda en una nube privada alojada en Amazon Web Services (AWS) en territorio estadounidense. Prometen que los datos viajan y se almacenan bajo estrictos estándares de cifrado.

Dentro de este escenario caótico, al menos nos queda un consuelo: no guardan las grabaciones. El sistema de Granola procesa tu voz en tiempo real, genera el texto en la nube y destruye el archivo de audio original al instante. Es decir, si mañana sufren un ciberataque masivo, los hackers se llevarían mucho texto sensible, pero no tendrían material sonoro para crear deepfakes de voz de tu plantilla. Menos mal.

Si ya has caído en las redes de esta herramienta y te está entrando el sudor frío, te aconsejamos actuar rápido. Ve directo al menú de configuración y cambia la visibilidad de tus enlaces a «solo mi empresa» o «privado». Además, ten en cuenta que si borras una nota, el enlace público original deja de funcionar al momento. Cortas el problema de raíz.

La fiebre descontrolada por meter IA generativa en cada segundo de nuestro día a día está provocando que muchas empresas prefieran la inmediatez por encima de la protección de datos. Aplicaciones que te resumen la vida son un avance espectacular, desde luego, pero la factura no puede ser dejar nuestras conversaciones profesionales a la intemperie. La pelota está ahora en el tejado de Granola para ver si recapacitan y cierran ese agujero antes de que se convierta en una pesadilla legal.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.