¿Cuántas veces has tenido que explicarle a una IA exactamente el mismo contexto que le diste ayer? Es frustrante. Hasta ahora, la inmensa mayoría de los modelos de lenguaje parecían sufrir de amnesia a corto plazo en cuanto cerrabas la pestaña. Pero la gente de Anthropic acaba de dar un golpe en la mesa. Acaban de lanzar en beta pública la función Memory para sus Claude Managed Agents. Y esto cambia por completo las reglas del juego para los desarrolladores. Una auténtica locura.

Básicamente, los agentes de Claude ya no empiezan desde cero cada lunes por la mañana. Tienen la capacidad nativa de recordar y reutilizar información de sesiones anteriores. Esto significa que pueden ir acumulando conocimiento específico sobre tu empresa con el paso del tiempo. Se acabaron los días de perder horas actualizando manualmente los prompts del sistema con biblias de contexto. El sistema aprende, retiene y actúa en consecuencia. Así de simple.

Un sistema de archivos en lugar de una caja negra

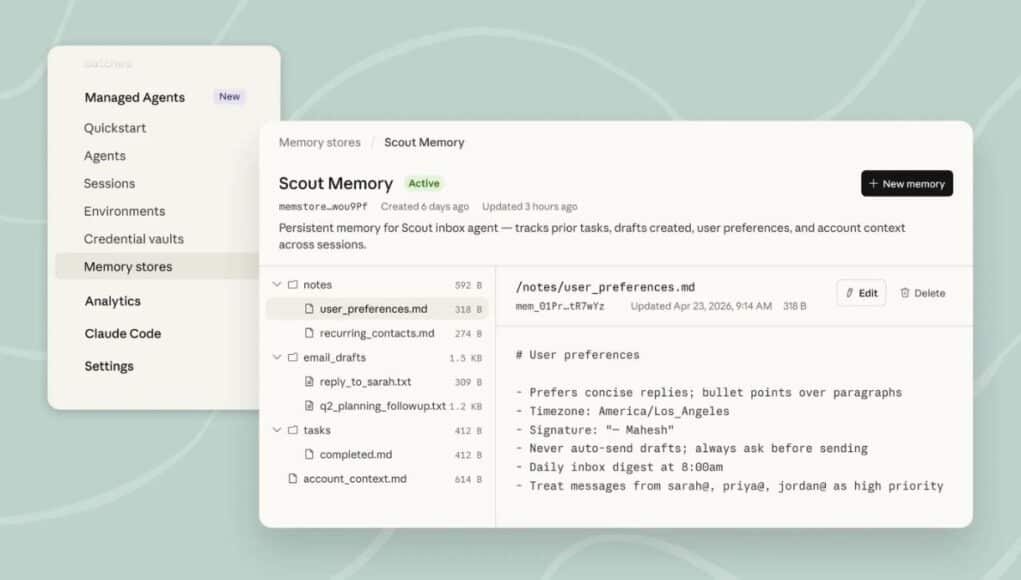

Si miramos los números y la arquitectura técnica, el enfoque que han tomado es tremendamente inteligente. No estamos hablando de un simple historial de chat glorificado ni de un parche rápido. Memory está diseñada desde sus cimientos como una capa basada en un sistema de archivos. Es decir, los datos que la IA memoriza se almacenan literalmente como ficheros estructurados. Y eso abre un abanico de posibilidades gigantesco para cualquier equipo técnico que trabaje con flujos complejos.

Por si fuera poco, esta información no se queda secuestrada dentro de los servidores de Anthropic. Los desarrolladores pueden exportar esos datos libremente y gestionarlos a su antojo mediante potentes APIs. A ello se le suma la posibilidad de configurar niveles de permisos muy granulares. Puedes decidir qué departamento, usuario o agente específico tiene acceso a qué fichero de memoria. El control es absoluto.

También te puede interesar:Anthropic Estrena Claude Managed Agents para Crear Agentes de IA Empresariales en la NubePero claro, cuando metes a una Inteligencia Artificial en el corazón de los procesos de una gran compañía, el pánico a las filtraciones o a los errores se dispara. Y aquí es donde la compañía de Claude ha querido distanciarse radicalmente de sus rivales. Han priorizado la transparencia por encima del simple rendimiento bruto. Cada pequeño cambio o adición en la memoria genera automáticamente trazas de auditoría por sesión y por agente. Un registro impecable de todo lo que ocurre bajo el capó. Nada se mueve sin que quede registrado.

Evidentemente, las organizaciones rara vez confían a ciegas en un software, y menos en un LLM. Si un agente autónomo aprende un dato incorrecto o almacena información confidencial por error, el desastre puede ser mayúsculo. Para evitarlo, este sistema te permite intervenir directamente. Las empresas pueden revertir estados, redactar partes del texto o borrar datos almacenados con precisión quirúrgica. Cero opacidad. Todo es editable y auditable.

Las grandes corporaciones ya lo están usando

Y es que el mercado corporativo estaba pidiendo a gritos algo así. Empresas del tamaño de Netflix y Rakuten, junto a start-ups tecnológicas como Wisedocs y Ando, ya están utilizando esta funcionalidad en su día a día. No nos venden humo con promesas a cinco años vista. Es una herramienta real que ya está optimizando flujos de trabajo pesados hoy mismo. El uso de esta memoria persistente reduce los errores operativos de forma drástica y acelera procesos que antes requerían constante supervisión humana.

En concreto, para los desarrolladores y equipos técnicos interesados, la función ya está disponible de manera inmediata para todos los usuarios de Managed Agents. El acceso y la configuración se realizan cómodamente a través de la Claude Console, así como desde sus interfaces programáticas. Todo se integra sin fricciones con la infraestructura existente, siendo compatible con múltiples plataformas desde el minuto uno. Si quieres revisar la documentación completa y el anuncio oficial, merece la pena leer directamente la Fuente de Anthropic. Te haces una idea del potencial técnico al instante.

A fin de cuentas, este lanzamiento consolida la estrategia de Anthropic. Se postulan claramente como el proveedor de herramientas de IA empresarial que realmente entiende las exigencias de seguridad de las grandes compañías. Analistas del sector ya apuntan a que esta evolución va a transformar cómo automatizamos la gestión del conocimiento. Veremos cómo responde la competencia ante este nivel de trazabilidad o si siguen apostando por ecosistemas más cerrados. La pelota está ahora en el tejado del resto de la industria.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.