Estados Unidos intentó ahogar el desarrollo tecnológico de China cerrando el grifo de los chips avanzados y la maquinaria, pero la estrategia ha provocado exactamente el efecto contrario. Así de simple.

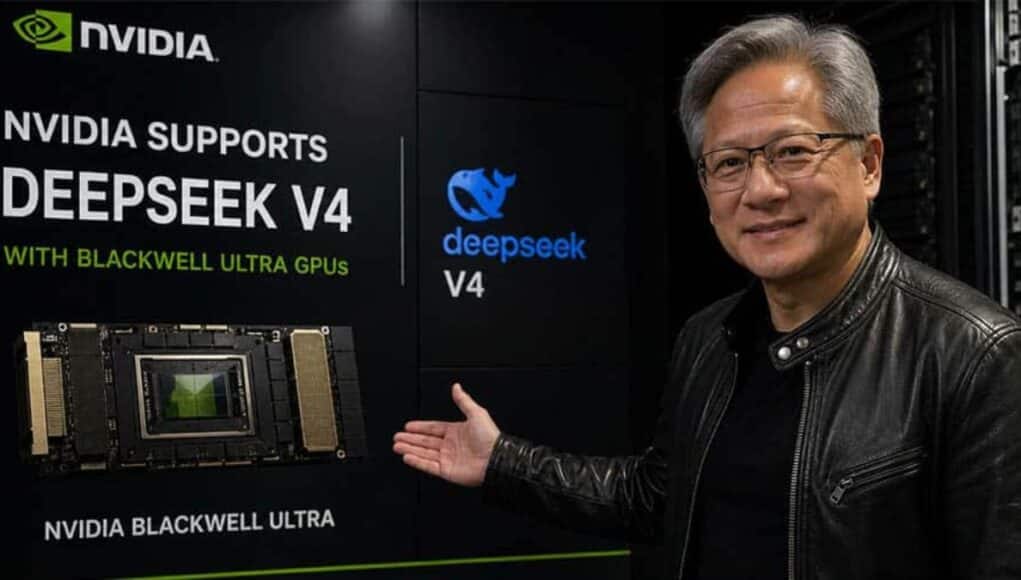

Tras meses de secretismo y movimientos en la sombra, ya tenemos sobre la mesa a DeepSeek V4, un modelo colosal que consolida a la firma asiática como la creadora de la mejor IA open-source del planeta. Y claro, no ha llegado sola al terreno de juego. NVIDIA ha movido ficha con una velocidad inaudita para que sus procesadores sigan siendo imprescindibles.

El motivo es evidente: nadie en la industria quiere perder el tren de una tecnología que está rompiendo el mercado. Ya vimos a principios de año cómo la versión R1 conseguía mirar de tú a tú al mismísimo ChatGPT, usando muchas menos GPUs y reventando los tiempos de entrenamiento. Ahora, el salto es aún mayor. Una auténtica locura.

NVIDIA entra en pánico: compatibilidad inmediata y fuerza bruta

Si nos fijamos en los datos técnicos recién publicados, la jugada del gigante de Santa Clara es fascinante. La compañía de Jensen Huang se ha apresurado a anunciar soporte para sus GPU Blackwell en la IA más avanzada desde el minuto uno de su lanzamiento, lo que en la industria se conoce como el sagrado Day 0.

También te puede interesar:G-Assist de Nvidia: Ahora con Plugins para Spotify, Twitch y GeminiEn concreto, las flamantes tarjetas Blackwell Ultra son capaces de procesar unos mareantes 3.500 tokens por segundo cuando trabajan bajo la variante DeepSeek V4-Pro. Es un caudal de datos salvaje que demuestra el potencial real del hardware cuando los ingenieros afinan el software al milímetro.

Pero claro, siempre hay que rascar un poco en la letra pequeña de los benchmarks. Ese rendimiento descomunal tiene sus matices prácticos. La tasa real de procesamiento se estabiliza en unos 15 tokens por segundo por usuario a medida que la carga de trabajo y la interactividad en el servidor se disparan. El rendimiento decae en entornos compartidos, como era de esperar.

1,6 billones de parámetros y una optimización que asusta

Para que te hagas una idea de la monstruosidad de este hito, estamos hablando de un sistema vertebrado por 1,6 billones de parámetros. Mover semejante cantidad de información normalmente requeriría granjas de servidores devorando energía sin compasión.

La genialidad de los desarrolladores chinos radica en una optimización extrema del pipeline. Este nuevo modelo consume únicamente el 27% de los FLOPs de inferencia por token si lo ponemos frente a frente con otros pesos pesados de Silicon Valley.

También te puede interesar:G-Assist de Nvidia: Ahora con Plugins para Spotify, Twitch y GeminiBásicamente, esto significa que operar esta inteligencia artificial es escandalosamente barato. A ello se le suma otro truco de magia técnica: han hundido el uso de la memoria caché KV hasta dejarlo en un ridículo 10%. Esto les permite manejar contextos masivos de hasta 1 millón de tokens sin que la máquina empiece a sudar. Ni se inmuta.

El comodín del MXFP4 y la sombra de Huawei

Gran parte de estas cifras mareantes se explican por la adopción del formato de datos MXFP4. Quizás este nombre técnico te suene a chino, nunca mejor dicho, pero es la llave maestra para reducir radicalmente la latencia y evitar cuellos de botella en el tráfico de memoria. Comprimir los datos de esta forma es lo que marca la diferencia en 2025.

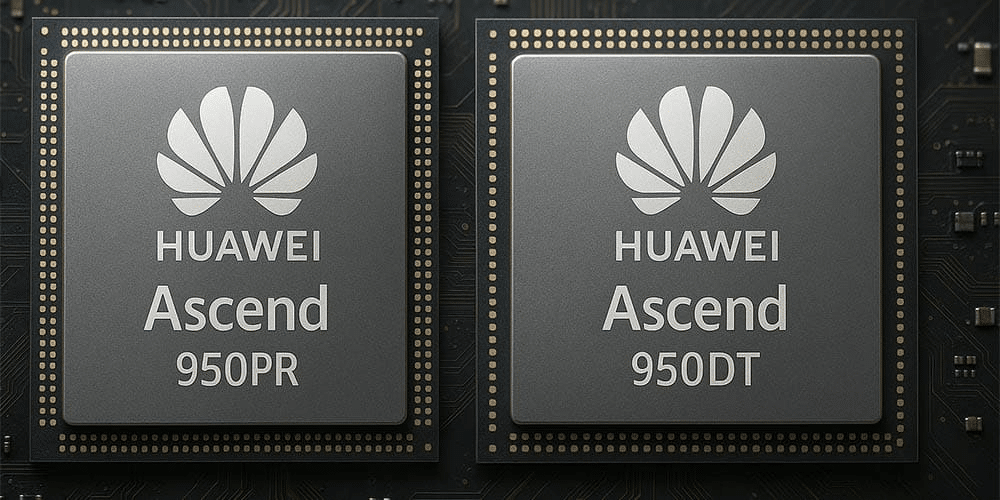

Lógicamente, Pekín no se va a conformar con depender de las carísimas tarjetas gráficas occidentales compradas a través de intermediarios en terceros países. Aquí es donde entra en escena el as en la manga del hardware nacional.

Los futuros chips de Huawei, en concreto los procesadores Ascend 950PR y 950DT que verán la luz en 2026, ya están diseñados para devorar instrucciones MXFP4 de forma nativa. Es una declaración de guerra comercial en toda regla.

Dicho de otro modo, la industria local se está armando hasta los dientes. Las restricciones de exportación han creado un caldo de cultivo perfecto para que fabricantes como Huawei dominen su propio mercado doméstico, impulsados por la necesidad de esquivar los costes prohibitivos del hardware de importación.

Lo que estamos viviendo es la creación de dos ecosistemas tecnológicos paralelos y altamente competitivos. NVIDIA puede colgarse hoy la medalla de la velocidad con su soporte inmediato, pero la independencia tecnológica de China avanza a un ritmo que nadie previó hace dos años. Tocará esperar para ver quién ríe el último en esta guerra de silicio y algoritmos.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.