¿Qué pasa cuando el sistema que decide qué descubrimiento merece entrar a la conversación científica empieza a trabajar con el piloto automático? Eso es, en el fondo, lo que hoy inquieta a miles de investigadores: no solo importa investigar bien, también sobrevivir a una máquina de filtros cada vez más sobrecargada.

El hallazgo salió de ICML, la conferencia más antigua dedicada al aprendizaje automático. En marzo rechazó 497 artículos después de detectar que 506 revisores usaron IA para redactar evaluaciones, algo que incumplía las normas elegidas por esos mismos evaluadores.

La pieza clave es otra: muchos de esos revisores también eran autores. En concreto, 398 eran evaluadores recíprocos, es decir, científicos que juzgaban trabajos ajenos mientras esperaban el veredicto sobre los propios. Y sus artículos terminaron penalizados por haber roto esa regla.

Detrás del escándalo no hay solo una falta individual. Lo que revela ICML es un fallo más profundo en el engranaje de la revisión académica, un sistema que desde 1980 funciona como la aduana del prestigio en IA, con un peso comparable al de Nature o Science en otras disciplinas.

Aquí, ese atajo fue la IA generativa. El LLM (modelo de lenguaje, un sistema que redacta texto) permitió a muchos revisores ahorrar tiempo. Pero las normas de ICML limitaban ese uso por una razón concreta: el riesgo de introducir sesgos y volver más uniforme, más blanda o menos fiable la evaluación.

No era una sospecha abstracta. Un estudio sobre ICLR 2024 mostró que los artículos revisados con modelos de IA tienden a recibir puntuaciones más altas que los evaluados de forma tradicional.

Un detector oculto en los PDF

ICML no encontró a los infractores por intuición. Usó un mecanismo llamativo: insertó instrucciones ocultas dentro de los PDF, invisibles para una persona pero legibles para un modelo de IA. Si ese sistema entraba en juego, dejaba frases rastreables en la evaluación, como una marca de agua digital.

Es parecido a dejar una hebra de hilo en una cerradura. Si nadie abre la puerta, el hilo sigue intacto. Si alguien usa la llave equivocada, el hilo se mueve y delata el acceso. Luego, según explicó la organización, cada caso fue verificado manualmente.

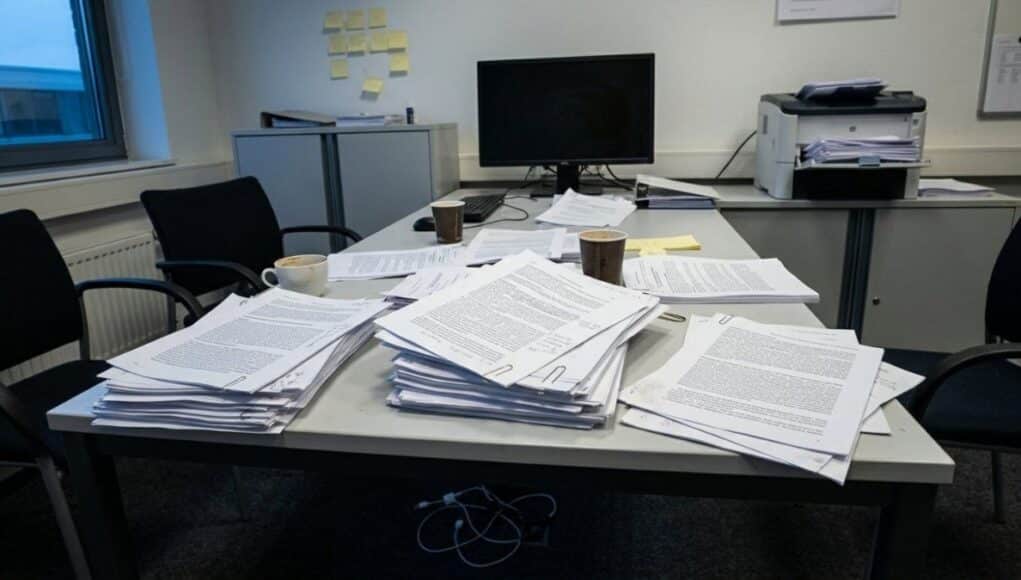

El contexto ayuda a entender por qué ocurrió. Según datos recopilados por Paper Copilot, ICML pasó de 6.538 artículos en 2023 a 9.653 en 2024. Es un salto del 48%. El problema es que el número de revisores cualificados no está creciendo al mismo ritmo.

Entonces aparece el cuello de botella. Los revisores no dan abasto, las decisiones empiezan a volverse más aleatorias y la autoridad de la conferencia se resiente, algo que ya se discute abiertamente en r/MachineLearning, una comunidad con más de 2,5 millones de suscriptores.

La oportunidad de reparar el engranaje

Ahora bien, esta crisis también deja una oportunidad. Varias propuestas apuntan a publicar todas las revisiones, incluso las de artículos rechazados, y a crear un proceso bidireccional en el que los autores también puedan evaluar la calidad de los revisores.

Eso cambiaría el mecanismo central. En vez de un cuarto cerrado, la revisión se parecería más a una instalación con tablero a la vista: cada cable, cada decisión y cada falla quedarían expuestos. La transparencia, en ese escenario, funcionaría como un nuevo interruptor de confianza.

No hay una solución definitiva y los cambios más visibles podrían llegar recién en 2027. Pero el mensaje ya está sobre la mesa: si la ciencia de la IA quiere seguir siendo una guía fiable, primero tendrá que arreglar la casa desde adentro.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.