El Departamento de Educación de la ciudad de Nueva York publicó directrices para el uso de IA en sus escuelas públicas. El hallazgo de fondo no es solo normativo: el sistema intenta ordenar una tecnología veloz para casi un millón de estudiantes sin desplazar a docentes ni vínculos humanos.

Además, el marco no salió de un escritorio cerrado. Fue elaborado con la participación de más de 1.000 miembros de la comunidad educativa y ahora abrió una consulta pública de 45 días para ajustar una política que toca privacidad, aprendizaje y equidad.

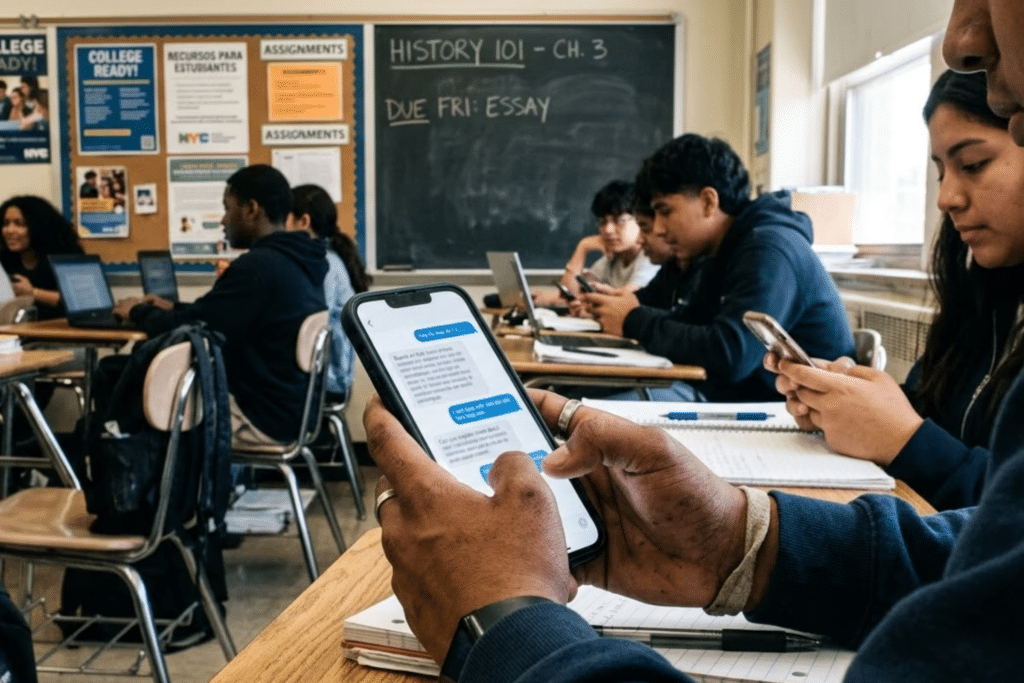

La clave del mecanismo es simple de entender. Nueva York organizó el uso de IA con un sistema de semáforo: rojo, amarillo y verde según el riesgo.

Las autoridades educativas subrayan que la IA debe apoyar a los docentes, no reemplazar su juicio profesional.

También te puede interesar:El CEO de Klarna usa un avatar de IA para presentar resultados financierosEl nivel rojo cumple el papel de corte total. Prohíbe usar IA en decisiones sobre estudiantes, como calificaciones o disciplina, porque ahí entran riesgos de sesgo algorítmico (errores automáticos con trato desigual), privacidad y falta de contexto humano.

El amarillo actúa como una luz de precaución. Permite usar estas herramientas en investigaciones o proyectos, pero bajo supervisión. Es decir, la IA puede sugerir, ordenar o resumir, pero el engranaje decisivo sigue en manos del docente.

El verde, en cambio, habilita tareas administrativas o de apoyo. Por ejemplo, organizar horarios, hacer traducciones no críticas o asistir en la formación docente. Ahí la tecnología funciona más como una calculadora robusta que como un reemplazo del aula.

El filtro antes de entrar al aula

No cualquier herramienta puede conectarse a ese cableado. Todas deben pasar por ERMA, un proceso de revisión interna que controla privacidad, seguridad y cumplimiento de normas. Solo las aplicaciones aprobadas pueden usar datos de alumnos o del personal educativo.

También te puede interesar:El CEO de Klarna usa un avatar de IA para presentar resultados financierosEse punto es central. Los proveedores deben comprometerse a no usar datos de estudiantes para entrenar modelos y a ser transparentes sobre cómo funcionan sus sistemas. También se están desarrollando mecanismos para evaluar equidad, sesgo y adecuación pedagógica.

Sin embargo, la oportunidad convive con dudas reales. Algunos padres temen una implementación demasiado rápida y advierten sobre la falta de alfabetización digital crítica, es decir, la capacidad de entender cuándo una respuesta automática ayuda y cuándo empobrece el pensamiento.

Algunos alumnos incluso prefieren entornos sin IA. Les preocupa que la herramienta les quite participación activa o les resuelva demasiado pronto el problema, como si una bicicleta eléctrica hiciera el trayecto, pero dejara sin ejercicio a las piernas.

Qué cambia para docentes, familias y alumnos

Las autoridades defienden que la IA puede aliviar tareas pesadas, como la planificación o ciertas correcciones, y liberar tiempo para lo más humano: explicar, escuchar, detectar dificultades y acompañar. Los profesores, a su vez, mantienen la responsabilidad final sobre cada decisión pedagógica.

Ese es el interruptor más importante de toda la política. La ciudad reconoce que la IA ya es parte del mundo laboral y social de los estudiantes, pero intenta evitar que esa entrada ocurra sin barandas ni reglas claras.

No hay todavía una opción uniforme para que todas las familias eviten estas herramientas, y eso abre una discusión pendiente. Pero el mecanismo que diseñó Nueva York deja una señal clara: si la IA va a entrar a la escuela, no puede hacerlo como dueño de casa, sino como un asistente bajo supervisión.

En tiempos de automatización acelerada, ese semáforo busca algo bastante concreto: que la tecnología encienda apoyo donde hace falta, sin apagar la pieza central del aprendizaje, que sigue siendo humana.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.