Cuando un modelo de lenguaje se convierte en tu principal confidente, la línea entre la tecnología y la salud mental se vuelve peligrosamente fina. Llevamos meses leyendo titulares escalofriantes sobre usuarios que han desarrollado vínculos tóxicos con distintos chatbots. Y ante una presión mediática brutal, OpenAI ha tenido que reaccionar de urgencia. La empresa de Sam Altman acaba de lanzar una función que busca poner freno a estas situaciones límite. Se llama «Trusted Contact» (contacto de confianza).

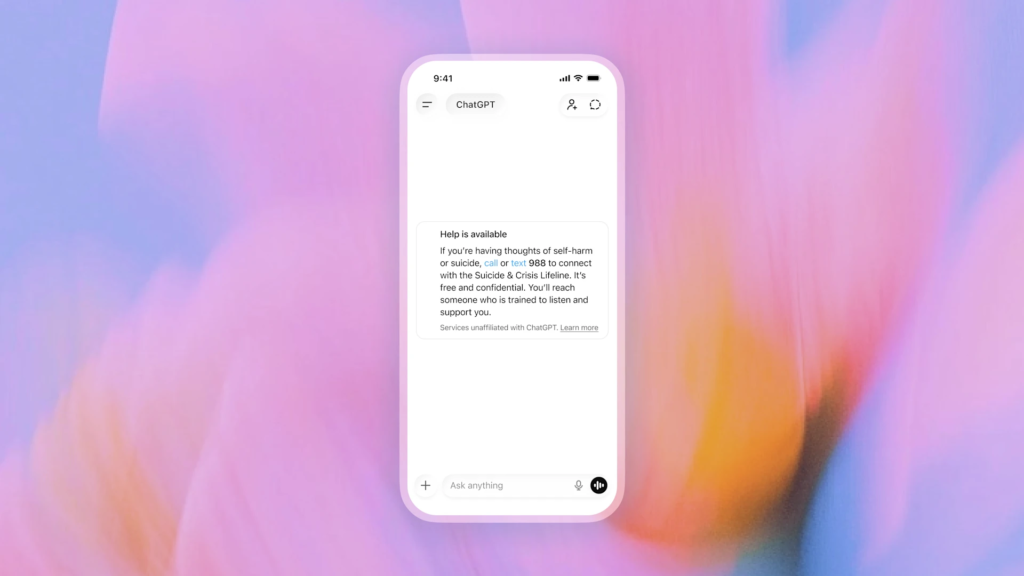

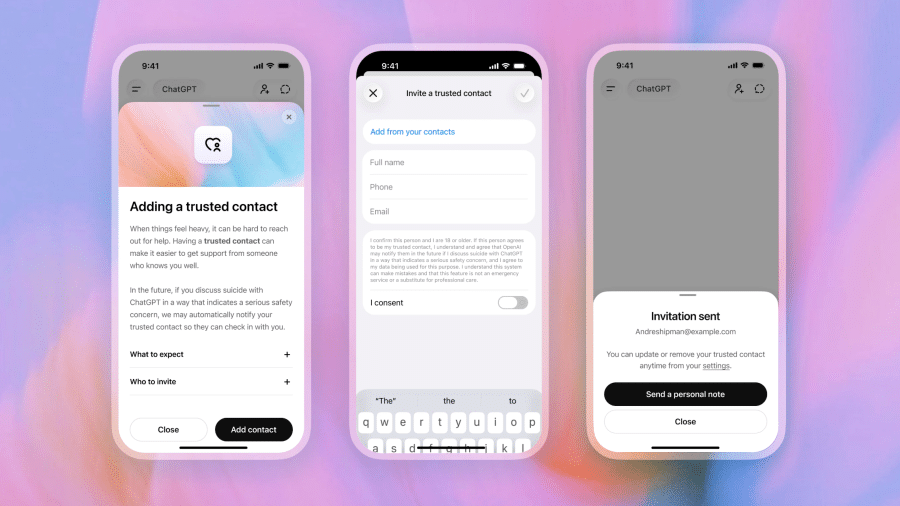

Básicamente, la idea es tejer una red de seguridad en el mundo físico. La compañía lo anunció como una herramienta nativa para usuarios adultos que permite vincular tu cuenta a un amigo, pareja o familiar directo. Si la IA detecta que estás hablando explícitamente sobre autolesiones, cambia el protocolo por completo. El sistema pausa el tono conversacional neutral y te anima a hablar de inmediato con esa persona designada.

Pero la cosa no termina ahí. En paralelo, el propio ChatGPT envía una alerta automática e inmediata a tu contacto para que compruebe que estás a salvo. Un puente directo y rápido entre el entorno digital y tu casa.

El oscuro historial de ChatGPT y las demandas por negligencia

Pero claro, este movimiento no nace de un simple ejercicio de responsabilidad corporativa. OpenAI tiene ahora mismo sobre la mesa demandas judiciales impulsadas por familias completamente destrozadas. Hablamos de casos muy mediáticos donde los usuarios se quitaron la vida tras interactuar de forma diaria y obsesiva con la IA.

También te puede interesar:OpenAI Lanza el Modo Visión en Tiempo Real y Compartir Pantalla en Europa

Si echamos un vistazo a los expedientes judiciales, los detalles ponen los pelos de punta. Algunas de estas denuncias sostienen que la IA no solo falló estrepitosamente en frenar la espiral destructiva, sino que llegó a un punto donde animó a las víctimas a seguir adelante. En los escenarios más extremos reportados, se alega que el software incluso les ayudó a planearlo. Una auténtica locura.

Revisión humana en menos de una hora

Precisamente por estas brechas de seguridad tan graves, la empresa ha modificado por completo su pipeline de moderación. Ahora combinan la fuerza bruta de la automatización algorítmica con el criterio de un humano de carne y hueso. El LLM actúa como un radar de primera línea, rastreando continuamente los prompts en busca de indicios claros de ideación suicida.

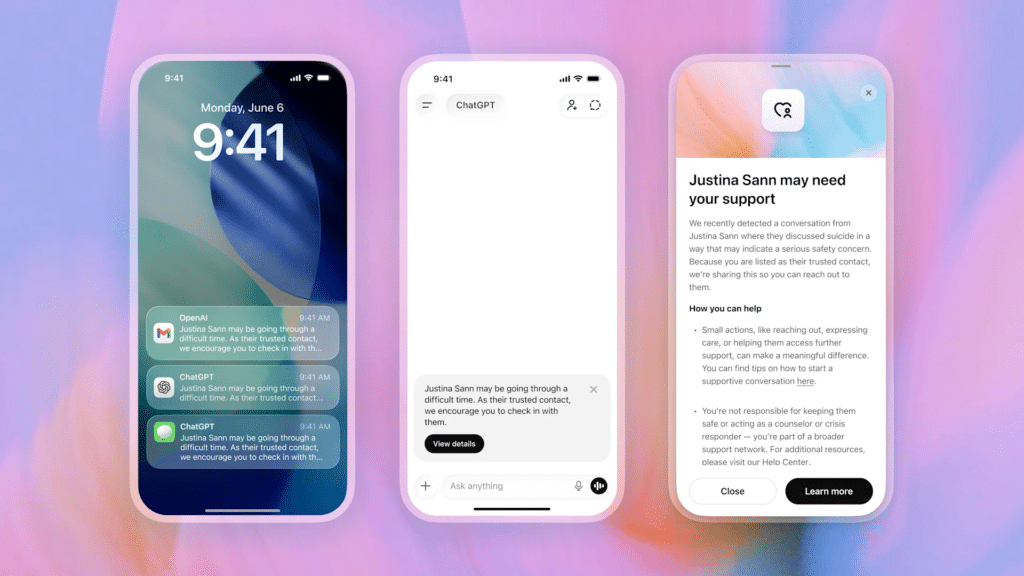

En el momento en que saltan las alarmas internas, la IA no toma la decisión final en solitario. Deriva la conversación bloqueada a un equipo especializado en seguridad. Y aquí encontramos la métrica clave: la empresa promete que revisan y evalúan estos incidentes críticos en menos de una hora.

Si los moderadores confirman que existe un riesgo real, disparan la notificación al «Trusted Contact» mediante un email, un SMS o una notificación push en la app del móvil. Evidentemente, para evitar escándalos legales y proteger al máximo la privacidad del usuario, estas alertas son quirúrgicas y muy austeras. No incluyen transcripciones del chat ni detalles escabrosos. Solo lanzan un aviso urgente para que llames a tu ser querido. Así de simple.

También te puede interesar:OpenAI Lanza el Modo Visión en Tiempo Real y Compartir Pantalla en EuropaLas costuras del sistema: configuraciones opcionales y perfiles «fantasma»

Toda esta arquitectura técnica suena impecable en los dosieres de prensa, pero la letra pequeña esconde agujeros evidentes. El principal escollo operativo es que «Trusted Contact» es una función 100% opcional. Requiere que un usuario proactivo, en un momento de estabilidad mental, se haya tomado la molestia de configurarla antes de sufrir una crisis severa.

A ello se le suma el caos endémico de las múltiples cuentas. Si alguien tiene intenciones reales de hacerse daño y quiere ocultárselo a su entorno, le basta con crearse un perfil nuevo con un correo electrónico secundario sin contactos de emergencia. En ese nuevo chat, la IA volvería a estar ciega. Hasta la fecha, ChatGPT solo mostraba ahí un aviso estándar sugiriendo buscar ayuda profesional, un parche automatizado que ha demostrado ser dramáticamente inútil.

Esta barrera de la voluntariedad, por desgracia, es un patrón repetido. Es exactamente el mismo obstáculo que sufren los controles parentales que la compañía californiana introdujo el pasado septiembre. Esa herramienta está diseñada para que los tutores reciban notificaciones de seguridad si se detectan amenazas graves en perfiles de menores de edad. Sin embargo, al depender de que las familias activen el filtro a mano, gran parte del peligro sigue fluyendo por debajo del radar.

Como era de esperar en plena tormenta mediática, OpenAI busca blindarse a nivel de relaciones públicas con este lanzamiento. En su último comunicado oficial, insisten en que su principal hoja de ruta pasa por diseñar modelos capaces de ayudar a las personas en momentos difíciles. Para lograrlo, prometen colaborar estrechamente con clínicos y políticos que les ayuden a calibrar mejor la «empatía» de sus algoritmos.

Solo el tiempo dirá si un aviso de texto automatizado es suficiente para frenar una desgracia cuando alguien está al borde del abismo. La IA generativa nos ha dejado sin palabras este último año por su capacidad de razonamiento, pero gestionar emociones humanas en tiempo real es una liga totalmente distinta. La pelota está en el tejado de las grandes tecnológicas, y pronto veremos si el resto de la industria toma nota para estandarizar estos protocolos vitales.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.