¿Dejarías a un software inteligente campar a sus anchas por los archivos de tu servidor corporativo sin ningún tipo de correa? Exacto, yo tampoco. Tras meses de promesas y demostraciones espectaculares, OpenAI sabe que la próxima gran fiebre tecnológica no va solo de chatear, sino de ejecutar tareas reales. Por eso, la compañía ha actualizado su kit de desarrollo de software para agentes (SDK) con un enfoque clarísimo: darnos el control absoluto. Y falta nos hacía para no acabar en un caos informático.

El motivo es simple: la industria tecnológica entera está obsesionada ahora mismo con la llamada «IA agentiva». Hablamos de sistemas avanzados que no esperan pacientemente a que les pidas las cosas una a una. Encadenan acciones, planifican y ejecutan de forma casi autónoma. Empresas como Anthropic y OpenAI llevan meses dándose codazos por liderar este nuevo mercado corporativo. Pero tener a un asistente de IA tomando decisiones por su cuenta en la infraestructura crítica de una empresa da bastante vértigo. Así de claro.

La jaula de cristal: por qué el «sandboxing» es innegociable

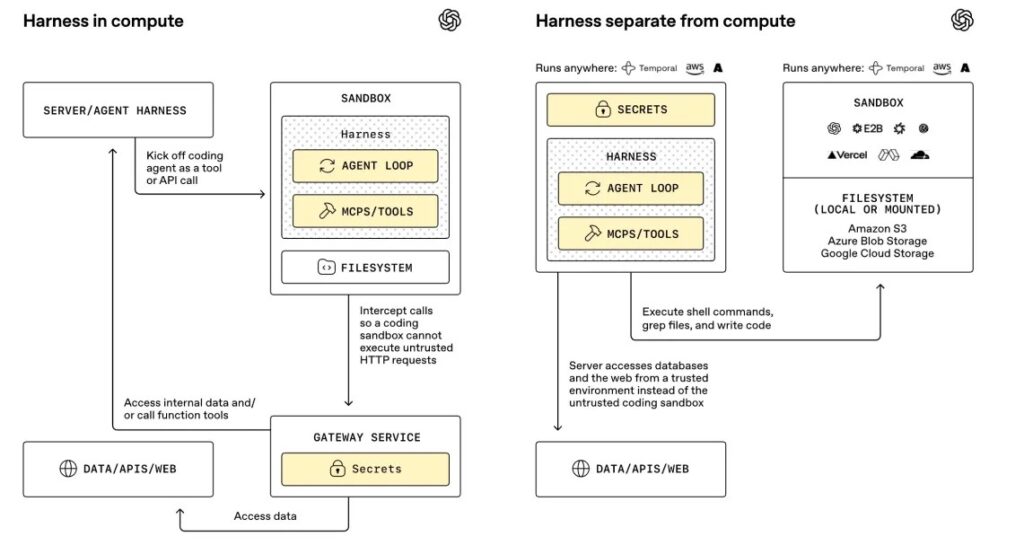

Aquí es donde entra en juego la principal novedad técnica de esta actualización. El nuevo SDK introduce por fin una capacidad nativa de sandboxing. Básicamente, permite a estos agentes operar dentro de entornos ultra controlados y vigilados al milímetro. La idea es meter al modelo de lenguaje en un espacio de trabajo aislado, donde solo tenga acceso a los archivos y el código estrictamente necesarios para cumplir su tarea actual. Ni un documento más de la cuenta.

Evidentemente, dejar que un agente ejecute código de forma autónoma y no supervisada es un movimiento arriesgado. Su comportamiento puede volverse tremendamente impredecible si el modelo alucina, malinterpreta un prompt o entra en un bucle lógico infinito. Al encerrarlo en este cajón de arena virtual, proteges la integridad de todo el sistema. Si el agente se equivoca, borra lo que no debe o intenta tocar bases de datos sensibles, el daño se queda contenido en ese espacio hermético. Un cortafuegos de manual.

También te puede interesar:OpenAI Lanza el Modo Visión en Tiempo Real y Compartir Pantalla en Europa

Lo verdaderamente interesante es la estrategia comercial que hay detrás de esta arquitectura. Los creadores de ChatGPT no quieren encerrarte a la fuerza en su propia infraestructura. Han diseñado esta actualización para que el SDK sea compatible con distintos proveedores de sandbox de terceros. Esto otorga una flexibilidad enorme a los ingenieros de software. De esta forma, pueden adaptar las nuevas herramientas a la arquitectura de seguridad que ya tengan montada y aprobada en sus empresas, sin tener que migrarlo todo de golpe.

Domando a las bestias: el «harness» para modelos de frontera

A ello se le suma otra pieza de ingeniería fundamental: un «in-distribution harness» pensado de forma específica para lidiar con los modelos más avanzados. En el argot del desarrollo tecnológico, este harness no es más que el conjunto de componentes y tuberías que rodean al modelo puro y duro. Es el puente vital entre el «cerebro» de la inteligencia artificial y las herramientas externas que necesita usar para hacer su trabajo. Sin él, la IA es solo una calculadora muy lista pero totalmente paralizada.

Si escudriñamos las especificaciones, este arnés facilita enormemente el trabajo con archivos aprobados y comandos de terminal en entornos controlados. Está diseñado de raíz para probar y desplegar sin miedo agentes impulsados por modelos frontier, que se consideran los motores de IA más potentes, pesados y de propósito general que existen hoy en día. Y claro, manejar ese nivel de capacidad de inferencia bruta sin las riendas adecuadas es como intentar conducir un bólido de carreras sobre hielo. Una auténtica locura.

Agentes de «largo horizonte»: delegando el trabajo duro

Pero claro, la verdadera disrupción ocurre cuando juntas ambas piezas del rompecabezas en un mismo entorno. La combinación simbiótica de sandboxing y harness persigue un objetivo de lo más ambicioso: permitir de una vez por todas la creación de agentes capaces de ejecutar tareas de «largo horizonte». Es decir, flujos de trabajo muy complejos que requieren decenas de pasos, comprobaciones intermedias y rectificaciones a lo largo de horas o días. Ya no hablamos de redactar un simple correo de ventas, sino de auditar repositorios de código enormes de forma autónoma.

También te puede interesar:OpenAI Lanza el Modo Visión en Tiempo Real y Compartir Pantalla en EuropaEn cuanto a la hoja de ruta de implementación, estas nuevas capacidades del SDK se lanzan inicialmente en Python. Tiene todo el sentido del mundo, siendo este lenguaje el estándar absoluto en cualquier pipeline de inteligencia artificial. Aunque si tu equipo de desarrollo prefiere TypeScript, no hay motivo para el pánico. OpenAI ya ha confirmado oficialmente que le darán soporte nativo en el futuro. Y no vienen solos: a este despliegue le seguirán funciones extra como un misterioso «code mode» y la posibilidad de orquestar múltiples subagentes trabajando en equipo.

La letra pequeña de este anuncio, que paradójicamente es excelente, tiene que ver con la facturación. Todo este nuevo arsenal de desarrollo ya está disponible para cualquier cliente a través de su API y utiliza los precios estándar de la plataforma. No hay peajes ocultos ni recargos por usar estas vitales capas de seguridad. Una decisión que seguramente acelere muchísimo su adopción tanto en pequeñas start-ups hambrientas de automatización como en grandes gigantes del sector.

Al final del día, estamos asistiendo en primera fila a cómo la IA deja de ser una simple herramienta de consulta para convertirse en un trabajador proactivo de pleno derecho. Darle autonomía real a los grandes modelos era el paso más lógico, pero hacerlo sin una red de seguridad potente era jugar con fuego corporativo.

Con este movimiento, OpenAI pone unos cimientos muy sólidos para que los CTOs confíen por fin en soltarle la correa a sus agentes virtuales. La pelota está ahora en el tejado de sus competidores, que tendrán que reaccionar rápido si no quieren perder el tren de la automatización segura.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.