Las IA actuales escriben código a la velocidad del rayo y te redactan correos corporativos impecables, pero dales un cuerpo físico y se chocan contra la primera pared que encuentran. Hasta hoy. Google DeepMind acaba de dar un golpe sobre la mesa anunciando Gemini Robotics-ER 1.6, un modelo diseñado para que los robots dejen de ser máquinas torpes. Su objetivo es que empiecen a entender y razonar sobre el espacio tridimensional que pisan. Y eso cambia las reglas de la robótica por completo.

El motivo es simple: el hardware siempre ha sufrido un cuello de botella brutal a la hora de percibir su entorno. Este nuevo modelo de Google DeepMind dota a los agentes autónomos de una capacidad de razonamiento físico y espacial inaudita. Básicamente, les instala un cerebro capaz de planificar tareas complejas, ser conscientes de la profundidad y no perderse por el camino cuando el entorno cambia.

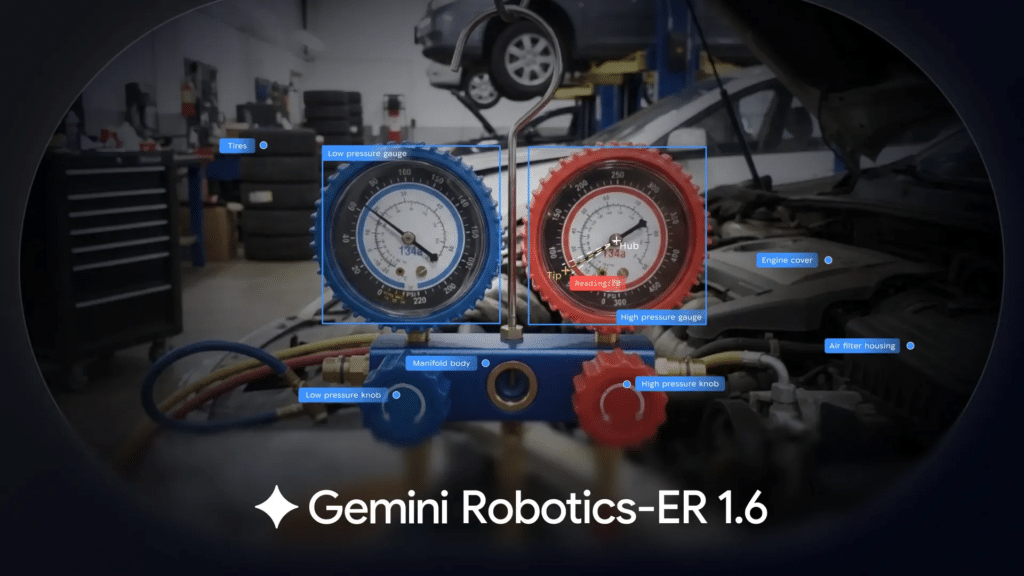

En concreto, si analizamos sus nuevas habilidades, hay una característica que rompe los esquemas de la industria. Y viene respaldada por los maestros de la robótica ágil: Boston Dynamics. Gracias a una colaboración directa entre ambos gigantes, los robots equipados con la capa de razonamiento de Gemini ahora pueden interpretar instrumentos puramente analógicos.

¿Qué significa esto en el mundo real? Pues que un cuadrúpedo puede pasearse por una refinería construida en los años ochenta y leer manómetros de presión mecánicos o visores de nivel en tanques. No hace falta gastar decenas de millones en digitalizar la planta entera con sensores IoT de última generación. El agente llega, mira la aguja, procesa la información y toma decisiones al instante. Una auténtica locura técnica.

A ello se le suma una capa de conectividad que le otorga una ventaja táctica evidente sobre sus competidores cerrados. Gemini Robotics-ER 1.6 no vive aislado dentro de su chasis de metal. Puede ejecutar su pipeline de tareas conectándose a herramientas externas de la red, integrándose con el mismísimo Google Search, o llamando a funciones de terceros. Le pides algo, busca contexto online si le falta información, y actúa en consecuencia.

Gemini Robotics-ER 1.6 destroza las métricas de sus predecesores

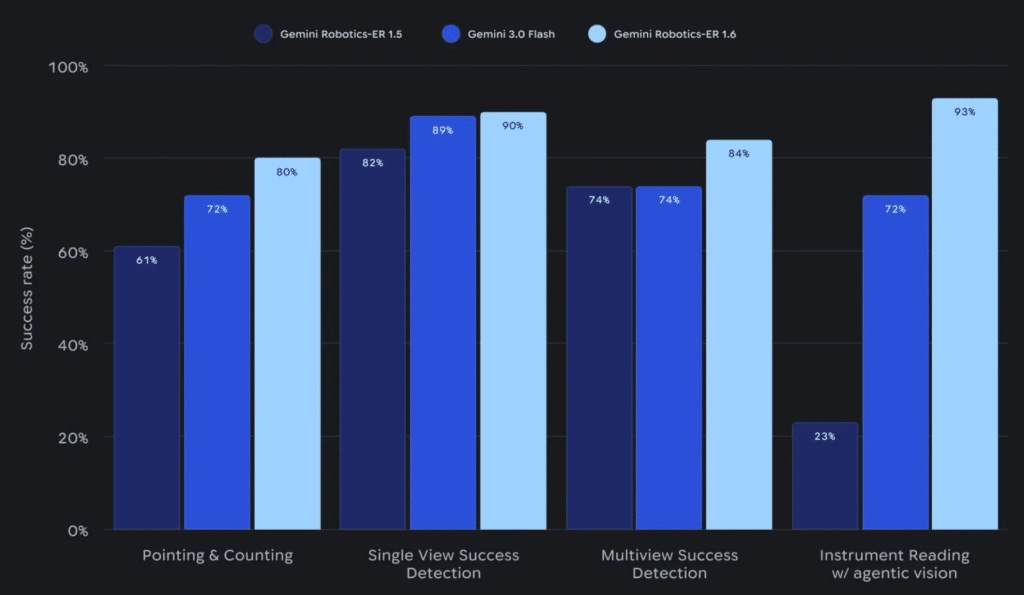

Si miramos los números y los benchmarks, el salto evolutivo es innegable. No estamos ante el clásico anuncio vende humo de Silicon Valley diseñado solo para inflar las acciones. Esta versión soluciona de forma drástica las carencias operativas que habíamos detectado tanto en Gemini Robotics-ER 1.5 como en el reciente Gemini 3.0 Flash.

Evidentemente, no hablo de simples mejoras teóricas en un laboratorio cerrado y súper controlado. Los datos demuestran que el nuevo modelo goza ahora de una precisión casi quirúrgica a la hora de señalar objetos específicos en entornos desordenados. También mejora radicalmente su capacidad de conteo espacial, algo en lo que los LLMs tradicionales suelen fallar estrepitosamente.

Pero claro, la verdadera revolución operativa viene con su sistema de detección de éxito en tareas físicas. Es decir, el robot sabe perfectamente si ha logrado apretar una tuerca con la presión correcta o si ha fallado en el último paso del empaquetado. Cierra el bucle de retroalimentación por sí mismo. Ya no se quedan bloqueados esperando a que un humano con un ordenador valide la operación. Tienen autonomía real para corregir errores al vuelo.

Por si fuera poco, la comunidad científica ya le ha echado el guante para probar sus límites en situaciones imprevistas. Los primeros equipos de investigación que lo han integrado coinciden en que este modelo amplía drásticamente las fronteras de lo que una máquina puede resolver por su cuenta. Según los detalles técnicos y los casos de uso presentados en la fuente original de la compañía, estamos ante la pieza clave para democratizar la verdadera automatización.

Un despliegue inmediato para dominar el estándar industrial

Como era de esperar, de nada sirve tener un modelo prodigioso si lo mantienes oculto en un servidor privado. Google ha sido extremadamente astuto y ha liberado la herramienta de forma inmediata. Si eres desarrollador o parte de una start-up de robótica, ya puedes acceder a sus capacidades a través de la API de Gemini y testearlo dentro de Google AI Studio.

Lo mejor de este movimiento es que no entregan la tecnología en bruto. Han incluido una potente batería de código de ejemplo para que la integración inicial sea rápida y no un quebradero de cabeza. Su foco es que los creadores de brazos industriales, robots comerciales de reparto o unidades de investigación científica inyecten esta IA hoy mismo en su hardware.

Y es que aquí subyace la verdadera guerra tecnológica del futuro a corto plazo. La empresa de Mountain View no se conforma con dominar los chatbots de tu móvil; busca liderar de forma absoluta el razonamiento encarnado. Su visión es establecer los nuevos cimientos de la autonomía robótica, fusionando su apabullante músculo de inteligencia artificial con las dinámicas impredecibles del mundo físico.

La pelota está ahora sobre el tejado de empresas como OpenAI, Tesla o la emergente Figure. Alojar una IA ultrapotente en la nube es un hito monumental, pero lograr que una máquina de 100 kilos entienda la gravedad, la fricción y el espacio para operar con fluidez es pisar un territorio completamente distinto. El software ya ha acelerado sin frenos; tocará esperar para ver si los fabricantes de hardware consiguen aguantar este ritmo.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.