¿Cuántas veces has visto una demo de inteligencia artificial que parece auténtica magia y, cuando llega a una empresa real, se cae a pedazos? Pasa constantemente. Los prototipos aguantan casi todo, pero llevar esos pipelines a producción suele ser un infierno técnico. Para solucionar esto, Mistral AI acaba de lanzar la vista previa pública de Workflows. Una nueva capa de orquestación diseñada precisamente para aportar durabilidad, tolerancia a fallos y observabilidad a los procesos corporativos. Así de directo.

Y es que el problema de la industria ahora mismo no es que los modelos no sean listos, es que fallan en silencio. Imagina un proceso crítico automatizado que se cuelga a la mitad y nadie se da cuenta hasta que un cliente se queja. Es un drama. La start-up europea busca erradicar los famosos fallos silenciosos y las tareas de larga duración que acaban convirtiendo la infraestructura en un cuello de botella infinito.

Básicamente, lo que han construido es una red de seguridad de alto nivel. Cada paso dentro de un flujo de trabajo queda registrado al milímetro y es completamente auditable. Si una tarea requiere que un humano intervenga para aprobar un documento legal, el sistema se pausa sin romperse, guarda el estado y espera pacientemente. Una bendición para los desarrolladores.

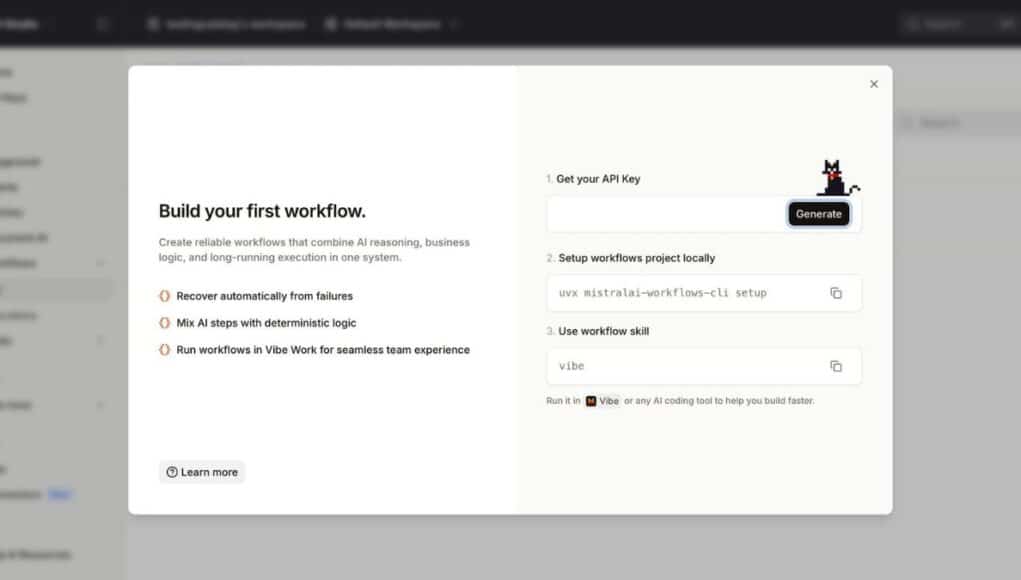

Workflows integra el motor de Temporal para blindar el código en Python

Si miramos las tripas técnicas, vemos que la base de esta herramienta no parte de cero. Se apoya directamente en el motor de ejecución de Temporal. Quizás este nombre no te suene de nada, pero en el mundo del software es una de las plataformas de código abierto más respetadas para garantizar que el código se ejecuta de forma fiable sin caídas catastróficas. Una elección brutal.

También te puede interesar:Mistral Saba: Un Modelo de Lenguaje para la Cultura ÁrabeEn concreto, Mistral AI ha cogido esa base robusta y le ha inyectado esteroides para cargas de trabajo de IA. Han añadido capacidades de streaming ultrarrápido, gestión avanzada de payloads muy pesados y una observabilidad muchísimo más granular. Todo esto forma parte del ecosistema de Mistral AI Studio, donde los programadores pueden empezar a picar sus automatizaciones directamente usando Python.

A ello se le suma la facilidad de distribución interna que propone la compañía. Una vez que el equipo de ingeniería ha terminado de montar y probar un pipeline complejo, no se queda guardado en un repositorio oscuro. Estas automatizaciones pueden publicarse y compartirse a nivel organizativo mediante Le Chat. El empleado medio solo interactúa con un chat amigable, mientras que por detrás corre una arquitectura a prueba de bombas.

La privacidad de los datos sigue siendo una línea roja innegociable

Pero claro, si vas a automatizar procesos clave de tu negocio, no puedes estar enviando datos financieros o de clientes a servidores de terceros sin control. La letra pequeña suele esconder sorpresas desagradables en el sector de la IA. Sin embargo, el modelo de despliegue que han ideado aquí separa claramente las responsabilidades operativas.

También te puede interesar:Mistral Saba: Un Modelo de Lenguaje para la Cultura ÁrabeEs decir, la infraestructura de orquestación pura y dura es gestionada por Mistral AI. Ellos se encargan de que los engranajes giren sin parar en sus propios servidores. Pero los datos reales y la lógica de aplicación nunca salen de tu casa. Permanecen bajo llave en el entorno del cliente. Esta arquitectura híbrida funciona igual de bien si usas la nube pública, servidores on-premise o una mezcla de ambos. Te haces una idea de por qué los bancos están encantados con esta separación.

Evidentemente, las grandes corporaciones no han tardado en subirse al carro. Firmas gigantes como ASML, ABANCA, CMA-CGM o La Banque Postale ya están exprimiendo esta herramienta en el mundo real. También la corporación energética Moeve o France Travail están automatizando operaciones de negocio críticas que antes requerían una supervisión manual constante. No estamos hablando de pruebas de concepto en un laboratorio aislado, sino de producción dura.

Como era de esperar, este lanzamiento viene acompañado del nuevo SDK v3.0 para que la comunidad empiece a integrarlo hoy mismo. La compañía francesa ha entendido perfectamente que la guerra de la IA corporativa ya no va solo de sacar el modelo con más parámetros o el benchmark más alto. Va de quién ofrece la fontanería más fiable para que las empresas no pierdan miles de euros cuando un algoritmo falla. Veremos si la competencia norteamericana responde a este movimiento táctico o si Mistral se queda con el monopolio de la fiabilidad empresarial.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.