¿Qué pasa cuando una herramienta pensada para responder dudas cotidianas termina apareciendo en la antesala de una tragedia? Esa pregunta, que parece de ciencia ficción, hoy ya golpea de lleno a una de las empresas centrales de la inteligencia artificial.

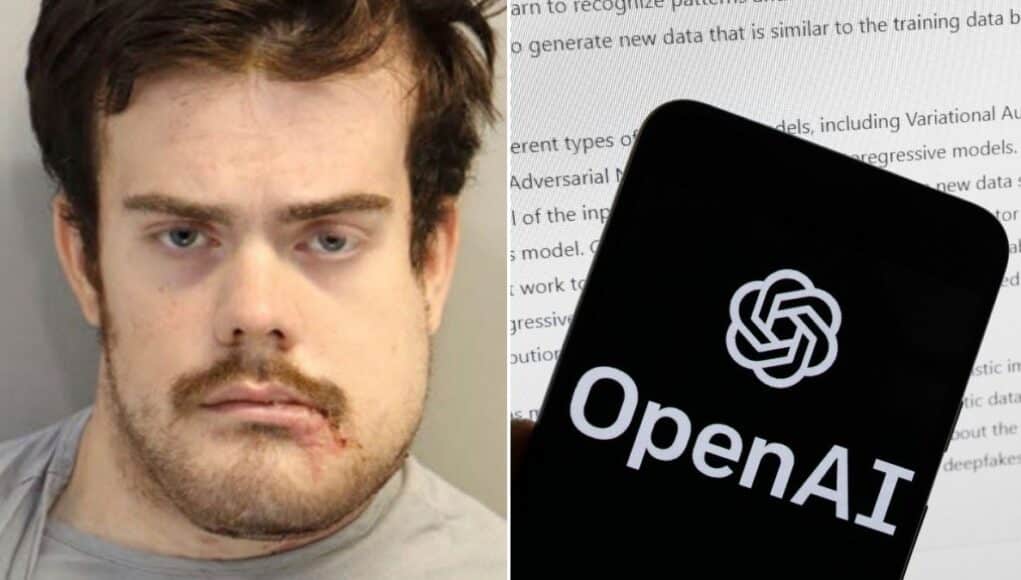

OpenAI enfrenta una nueva demanda por el supuesto uso de ChatGPT antes del tiroteo en la Universidad Estatal de Florida, ocurrido en abril de 2025. El ataque dejó dos muertos y siete heridos, y el hallazgo clave de la acusación es que el agresor habría usado el chatbot durante meses para explorar escenarios, pedir recomendaciones sobre armas y afinar su plan.

La demanda fue impulsada por Vandana Joshi, viuda de Tiru Chabba, una de las víctimas fatales. Además, el caso se suma a una investigación criminal abierta por el fiscal general de Florida, James Uthmeier, en un frente que ya no discute solo una falla técnica, sino el mecanismo de responsabilidad cuando un sistema conversa sobre violencia.

Según la presentación judicial, esas conversaciones incluyeron información sobre armamento, métodos para ejecutar el ataque y formas de amplificar su repercusión. OpenAI rechaza que ChatGPT haya fomentado actividades ilegales o perjudiciales, aunque la empresa ya reconoció fallos en sus sistemas internos de detección de usos problemáticos.

También te puede interesar:¿Por Qué ChatGPT Repite Frases Raras en Chino? Wired Tiene la RespuestaSam Altman incluso pidió disculpas públicamente por un incidente previo en Tumbler Ridge, donde también quedaron expuestas grietas en esos controles.

La pieza clave del debate está en el “interruptor” de seguridad. Un chatbot no funciona como una biblioteca cerrada, donde un libro peligroso está quieto en un estante. Se parece más a una central telefónica que nunca duerme: recibe una consulta, la enruta, arma una respuesta y, si el cableado de control falla, puede seguir conversando cuando debería cortar la línea.

Ahí aparece el punto más sensible. En inteligencia artificial, la detección (identificación de riesgo en tiempo real) debería actuar como el disyuntor de una casa: si hay una sobrecarga, baja la llave antes del incendio. El problema, según revelan estas investigaciones, es que en varios casos ese interruptor salta tarde, cuando el daño ya está en marcha.

Por eso la discusión dejó de ser abstracta. No se trata solo de si una IA “sabe” algo, sino de si su engranaje de alerta reconoce patrones de violencia a tiempo, bloquea la conversación y activa revisión humana cuando hace falta.

También te puede interesar:¿Por Qué ChatGPT Repite Frases Raras en Chino? Wired Tiene la RespuestaEl cableado legal detrás del caso

La demanda acusa a OpenAI de negligencia, agresión y homicidio culposo, y pide un juicio con jurado popular. Los abogados de la familia sostienen que el asistente actuó como un “cómplice necesario”, una expresión fuerte que busca mover la discusión desde el error técnico hacia la asistencia directa.

Ese planteo marca una oportunidad y también un riesgo para toda la industria. Si los tribunales empiezan a considerar que un chatbot puede tener un papel activo en la preparación de actos violentos, las empresas de IA deberán revisar de inmediato sus estándares de seguridad, sus filtros y su respuesta ante conversaciones sensibles.

En términos prácticos, esto implica reforzar barreras sobre consultas de armas, planificación de daños y simulación de ataques. También exige auditorías externas, registros más claros y sistemas capaces de detectar escaladas, es decir, cuando una charla aparentemente dispersa empieza a formar un patrón peligroso.

Una señal para el usuario común

Para el lector, el caso deja una enseñanza incómoda pero útil: los chatbots ya no son solo asistentes para resumir textos o escribir correos. Son una interfaz masiva, inmediata y persuasiva. Y cuando esa interfaz falla, el problema no queda dentro de una pantalla.

La clave, entonces, no pasa por apagar la tecnología, sino por revisar su cableado interno antes de que una conversación equivocada encuentre la puerta abierta. En una casa digital cada vez más poblada, el valor real de la IA no estará solo en lo que puede decir, sino en saber cuándo debe callarse.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.