Un equipo de la Universidad de Aalto y la Universidad de Leipzig presentó Log2Motion, un modelo de inteligencia artificial publicado en las actas científicas de la CHI Conference on Human Factors in Computing Systems 2026. El hallazgo aporta por primera vez parámetros objetivos sobre el esfuerzo muscular que exige cada gesto en una pantalla táctil.

No es un detalle menor. Hasta ahora, muchos métodos solo registraban dónde tocaba una persona la pantalla, pero no cuánto le costaba hacerlo. Log2Motion añade esa pieza clave: revela el gasto físico detrás de un simple desplazamiento, un toque o un error repetido.

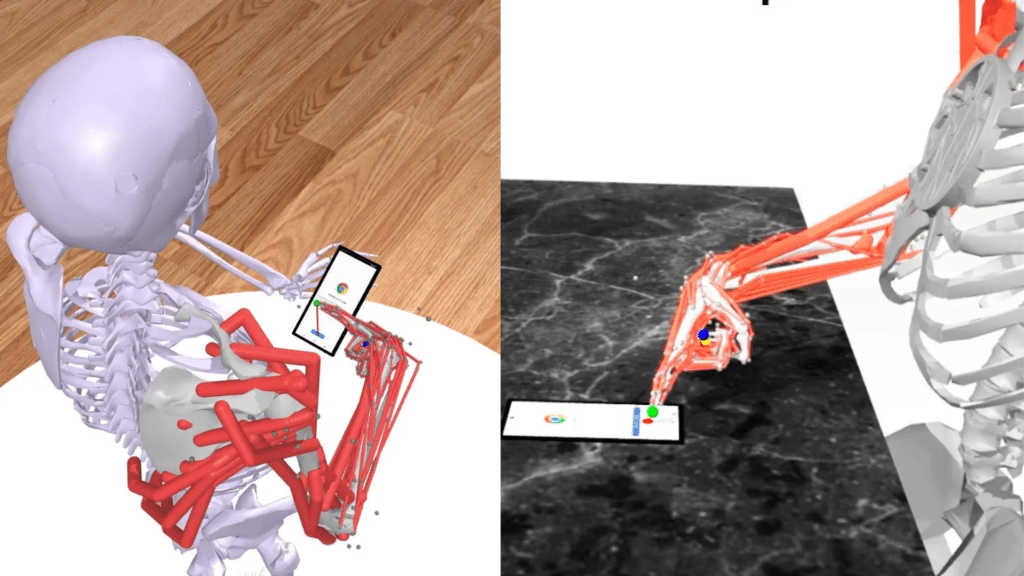

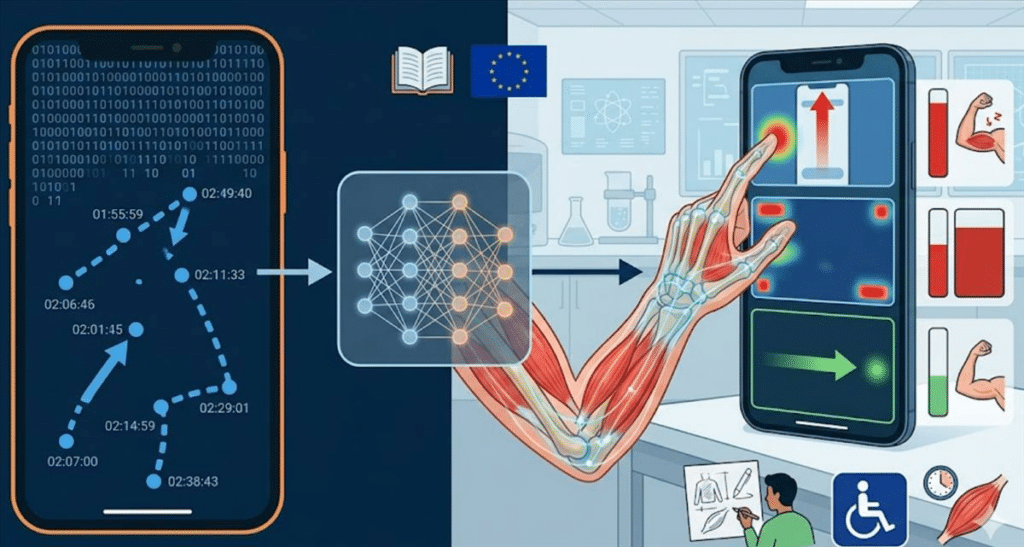

El mecanismo convierte registros táctiles en una simulación del movimiento humano. En otras palabras, toma las huellas digitales del uso del teléfono y las transforma en una mano virtual con huesos y músculos, capaz de recrear cómo se mueve, cuánto se esfuerza y dónde falla.

El sistema con la interfaz móvil. No mira solo si un botón funciona. Mira el “costo oculto” de alcanzarlo, pulsarlo y repetir el gesto decenas de veces, algo central para entender la ergonomía real de una app.

Qué revela la mano digital

La simulación calcula variables como velocidad, precisión y esfuerzo biomecánico (carga física del movimiento). Además, su validez se comprobó al compararla con movimientos humanos reales registrados en laboratorio. Las trayectorias y dinámicas generadas por el modelo resultaron prácticamente indistinguibles de las de una persona.

Los datos dejan un mensaje concreto para diseñadores y fabricantes. Los desplazamientos verticales exigen más esfuerzo muscular que otros gestos habituales. Y los iconos pequeños o colocados en las esquinas aumentan la dificultad de interacción.

Ahí aparece otra clave muy visible. En botones de 4 milímetros, la tasa de error llegó al 42% en gestos rápidos. En modo preciso bajó a menos del 9%. En botones de 10 milímetros, en cambio, el error fue igual o inferior al 2%.

También hay un hallazgo que ayuda a entender la fatiga cotidiana. Los movimientos rápidos generan picos de fuerza más altos, pero consumen menos energía total. Los gestos lentos y precisos, en cambio, acumulan más esfuerzo, algo que coincide con esa sensación de cansancio después de repetir tareas pequeñas.

Una oportunidad para interfaces más humanas

Además, Log2Motion puede usarse desde las primeras fases del diseño. Eso significa que una app podría evaluarse antes de llegar al usuario final, como quien prueba una escalera antes de construir toda la casa. Si un botón está en una esquina difícil o si un menú obliga a forzar el pulgar, el problema aparece antes.

La utilidad práctica va más allá de la comodidad. El sistema puede adaptarse a personas con temblores, menor fuerza en la mano o uso de prótesis. También puede recrear escenarios cotidianos, como manejar el celular desde el sofá con una mano, donde la dificultad cambia aunque la pantalla sea la misma.

Los investigadores buscan que este tipo de simulaciones se convierta en una herramienta estándar. Y, a futuro, podría integrarse con otras técnicas de IA para personalizar la experiencia según las capacidades físicas de cada usuario.

La idea es simple y potente: si el celular ya sabe qué tocás, el próximo paso es que también entienda cuánto te cuesta hacerlo. Ahí puede estar el interruptor de una tecnología más amable.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.