Las cifras de hardware en la actual carrera tecnológica han perdido por completo el sentido común. Te gastas miles de millones en tarjetas gráficas y luego descubres que enchufarlas a la corriente no es suficiente. Eso es exactamente lo que le está pasando a xAI, que pese a amasar montañas de silicio de NVIDIA, está viendo cómo sus rivales Google y Meta le pasan por la derecha en eficiencia técnica. Tener la chequera más grande ya no garantiza ganar la partida.

Si miramos los números fríos, el panorama actual asusta bastante. Según los últimos informes del sector, la empresa de Elon Musk tiene ahora mismo unas 550.000 GPUs NVIDIA disponibles, incluyendo las carísimas y codiciadas H100 y H200. Y sin embargo, tal y como apunta un reciente boletín de The Information, su nivel de utilización efectivo ronda un triste 11%. Básicamente, es como tener un Ferrari en el garaje para ir a comprar el pan a la esquina. Una auténtica locura.

El motivo de este desfase es simple: comprar el hardware no te otorga por arte de magia el software necesario para aprovecharlo. Mientras que la compañía de Musk exprime el equivalente a solo unas 60.000 GPUs reales en funcionamiento continuo, Mark Zuckerberg y Sundar Pichai juegan en otra liga. Las infraestructuras de Meta y Google presumen de niveles de uso en torno al 43% y el 46% respectivamente. Saben perfectamente lo que hacen.

El «milagro» logístico en Memphis y la letra pequeña del software

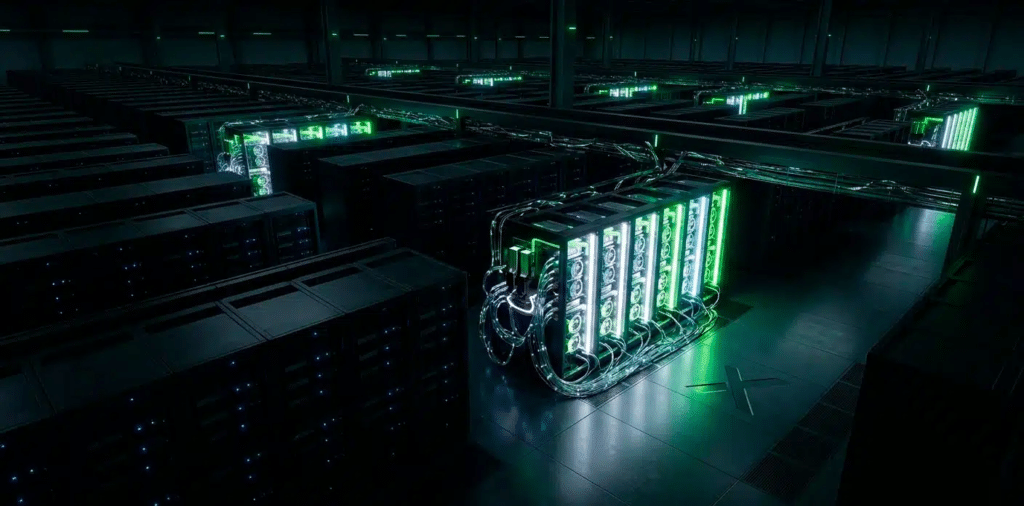

Evidentemente, no podemos negar el mérito salvaje que ha tenido el equipo de Musk a la hora de desplegar todo esto. Lograron instalar nada menos que 100.000 GPUs H200 en solo 19 días, algo que en la industria tradicional habría tardado años en diseñarse y aprobarse. Hasta el mismísimo Jensen Huang, CEO de NVIDIA, calificó esta hazaña logística como algo completamente «sobrehumano». Y tenía toda la razón. Han roto el mercado físico.

También te puede interesar:xAI Recibe Permiso para 15 Generadores de Gas Natural en Centro de Datos de MemphisPero claro, la fuerza bruta no lo es todo cuando hablamos de modelos masivos. El gigantesco clúster de supercomputación Colossus, que se levantó en apenas 122 días y duplicó su tamaño en otros 92 días, es un monstruo que necesita una dieta muy específica. La firma presume de haber cerrado 2025 con más de un millón de «GPU equivalentes a H100». Es decir, una métrica de marketing que agrupa su potencia de cálculo total sumando hardware de distintas generaciones. Suena genial para atraer a los inversores.

A ello se le suma la inyección de capital brutal que acaban de conseguir para mantener la maquinaria rodando. En enero de 2026, la start-up anunció una salvaje ronda de financiación Serie E de 20.000 millones de dólares, con la propia NVIDIA y gigantes como Cisco metiendo dinero fresco. Hay efectivo de sobra para seguir comprando juguetes. El problema real está en las operaciones del día a día, que aún están a años luz de competidores más experimentados.

La IA ya no va de acumular silicio, va de que no salte por los aires

En concreto, el cuello de botella actual de la industria ha mutado por completo. Ya no hay bofetadas por conseguir stock de gráficas. El verdadero dolor de cabeza es gestionar redes ultrarrápidas, el almacenamiento colosal de datos, optimizar el pipeline y, sobre todo, garantizar la tolerancia a fallos. Cuando pones a trabajar a decenas de miles de máquinas juntas, si una sola falla en el momento inoportuno, puede arruinar semanas de entrenamiento. Así de simple.

Por si fuera poco, tenemos el gran problema de la adopción real por parte de los usuarios. La bajísima utilización de hardware en los centros de datos de xAI también se explica porque su modelo Grok tiene mucha menos adopción si lo comparamos con titanes como Meta AI o el omnipresente Gemini de Google. Menos gente haciendo consultas significa que tienes miles de servidores rascándose la barriga. Mantener esos equipos encendidos e inactivos supone quemar montañas de billetes sin retorno. Un riesgo financiero letal.

También te puede interesar:xAI Recibe Permiso para 15 Generadores de Gas Natural en Centro de Datos de Memphis

Y es que la competencia lleva años haciendo los deberes en silencio y puliendo su infraestructura base. Google, por ejemplo, exprime su red propietaria Virgo y sus propios chips TPU persiguiendo un utópico 97% de rendimiento efectivo. Meta tampoco se queda atrás, montando clústeres bestiales de 24.576 GPUs para Llama 3 y proyectando alcanzar unas 350.000 GPUs H100 físicas altamente optimizadas. Ellos ya sufrieron estos dolores de crecimiento en su momento.

La burbuja de acaparar chips a lo bruto ha pinchado para dejar paso a la era de la eficiencia operativa extrema. No dudo que Musk acabará ajustando las tuercas y optimizando su monstruoso hardware, porque talento y dinero les sobra a raudales. Veremos cuánto tiempo tardan en rentabilizar Memphis antes de que la factura energética les pase un recibo inasumible.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.