Seguramente te haya pasado hace poco. Le pides algo a ChatGPT o a Gemini usando la voz y, de repente, notas que hace una pequeña pausa, duda un milisegundo o suelta una leve carcajada. Te quedas frío pensando en lo mucho que ha avanzado el modelo y crees que la IA ya tiene hasta alma. La realidad es bastante más cruda y analógica.

Resulta que detrás de esa naturalidad que nos deja con la boca abierta no hay solo una arquitectura de software brillante o miles de GPUs trabajando a pleno rendimiento en un servidor lejano. Lo que hay es un ejército en la sombra. Miles de personas trabajando a destajo para enseñar a las máquinas a imitar nuestros tics más humanos.

Y es que, para que un modelo aprenda a hablar de tú a tú, no basta con inyectarle millones de textos extraídos de internet. Necesita saber cómo decirlos. Necesita el tono, la respiración, las pequeñas vacilaciones al pensar. Y eso solo se consigue grabando a humanos de carne y hueso.

La extraña rutina de interpretar emociones para el algoritmo

A día de hoy, el entrenamiento de la voz artificial exige horas y horas de material sonoro puro. Los trabajadores de este sector se dedican a charlar con desconocidos sobre temas mundanos o, lo que es bastante más retorcido, a interpretar roles concretos siguiendo guiones muy específicos dictados por las empresas.

También te puede interesar:Gemini Presenta Nuevos ‘Notebooks’ para Organizar Chats y Archivos con NotebookLMEn concreto, algunas de las tareas les exigen recrear situaciones emocionales francamente complejas. Tienen que relatar experiencias personales dolorosas, fingir llantos o mostrar euforia. Todo dentro de un entorno simulado para que los micrófonos capten hasta el último matiz acústico de su garganta.

A esto se le suma el agotador trabajo de etiquetado del que nadie habla. Otros peones digitales se dedican a escuchar estos audios masivos y marcan manualmente dónde hay una risa, un sollozo o un simple cambio de tono. Así de simple.

Tal y como Bloomberg cuenta en un reciente informe, el objetivo final de estas grabaciones es crear una base de datos brutal que capture las imperfecciones del habla real. Esos pequeños defectos que nos hacen humanos son exactamente lo que los modelos necesitan para dejar de sonar como robots enlatados de los años noventa.

17 dólares por hora y el algoritmo como único jefe

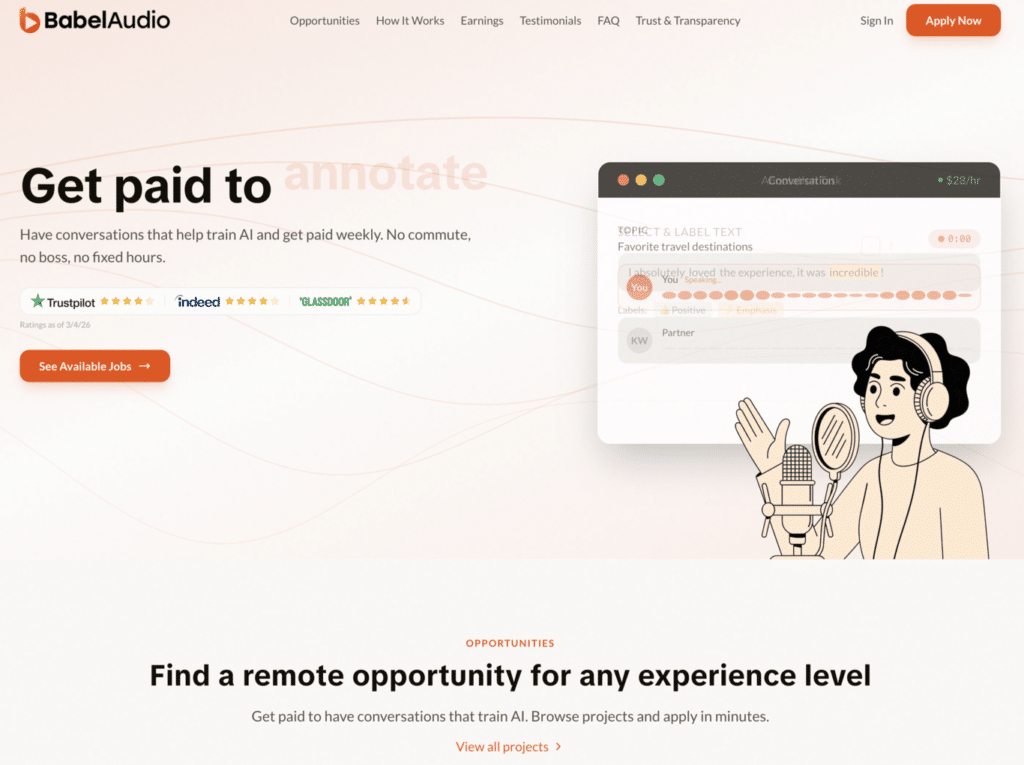

Evidentemente, toda esta maquinaria de recolección de datos necesita una infraestructura que conecte la oferta con la demanda. Y aquí es donde entran en juego las plataformas intermediarias que reclutan a estos «donantes de voz» a lo largo y ancho del planeta.

También te puede interesar:Gemini Presenta Nuevos ‘Notebooks’ para Organizar Chats y Archivos con NotebookLMUna de las más conocidas en este opaco mercado es Babel Audio. Actúa como el puente perfecto entre el trabajador freelance que busca un sobresueldo desde su ordenador y las grandes corporaciones de Silicon Valley que necesitan devorar datos de audio para mejorar sus productos.

Si miramos los números, las tarifas de entrada en estas plataformas suelen rondar los 17 dólares por hora grabada. Algunos trabajadores muy dedicados y con buenas métricas afirman que pueden llegar a embolsarse alrededor de 600 dólares semanales.

Pero claro, la letra pequeña es que este trabajo es la máxima expresión de la precariedad digital. Los ingresos reales varían salvajemente dependiendo de una disponibilidad fluctuante y de evaluaciones de calidad implacables que nadie te explica del todo.

Las plataformas miden en tiempo real absolutamente todo. Evalúan tu expresividad, la duración exacta de tus pausas y la fluidez general del intercambio. Si te sales un milímetro del parámetro que la red neuronal necesita, la IA te penaliza y tu pago mengua.

Por si fuera poco, la inestabilidad es absoluta. Hoy tienes un proyecto asignado y mañana la plataforma te restringe las tareas, interrumpe el proyecto de golpe o suspende tu cuenta sin darte una sola explicación. Estás a merced de un sistema automatizado que decide si tu forma de ser humano le resulta útil o no.

Un mercado fragmentado que comercializa nuestra intimidad acústica

Lo que verdaderamente debería hacernos reflexionar sobre esta industria no es solo el modelo laboral, sino la cesión masiva de privacidad. El peaje a pagar por estos trabajadores es ceder su forma de comunicarse, su huella vocal e incluso sus emociones a empresas de las que no saben absolutamente nada.

Como era de esperar, todo este sector del entrenamiento de IA funciona bajo un secretismo casi paranoico. El ecosistema es una red fragmentada donde los intermediarios bloquean la información.

Los trabajadores firman estrictos acuerdos de confidencialidad y casi nunca saben para qué sistema final están grabando su voz. Ese llanto fingido o esa risa natural podría acabar entrenando el próximo asistente premium de OpenAI, el GPS de un coche inteligente o un agresivo sistema de telemarketing.

La investigación que El Pulitzer Center describe deja claro cómo esta enorme falta de transparencia es el verdadero motor del ecosistema. Las gigantes tecnológicas prefieren que los usuarios finales no sepamos cuánta saliva, sudor y frustración humana hay detrás de la supuesta magia de sus modelos generativos.

Cada vez que nos maravillamos porque nuestro móvil nos responde con una naturalidad pasmosa y casi empática, deberíamos recordar que esa voz no salió de la nada. Es el eco ensamblado de miles de trabajadores anónimos vendiendo sus suspiros por unos pocos dólares.

Veremos si, a medida que los reguladores empiezan a auditar seriamente de dónde sacan las tecnológicas sus datos de entrenamiento, este modelo de negocio se sostiene o si las empresas se ven obligadas a pagar por las voces de una forma mucho más justa y transparente.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.